基于级联卷积神经网络的大场景遥感图像舰船目标快速检测方法

陈慧元 刘泽宇 郭炜炜 张增辉 郁文贤(上海交通大学电子信息与电气工程学院 上海 200240)(同济大学同济–MIT城市科学国际联合实验室 上海 200243)

1 引言

遥感图像目标检测是遥感技术领域研究的重要课题之一,基于遥感图像的舰船检测在民用和军事领域得到广泛关注。传统的遥感图像目标检测方法主要采用从粗到细的多步骤策略,一般包括预处理、海陆分割、感兴趣区域提取、目标鉴别等[1,2]。这种多步骤策略各步骤之间相互独立,每一步骤需要针对具体问题,设计相应的解决方案,存在流程固化、自动化、智能化程度不足等问题。目前,深度学习技术由于其强大的特征表示和端到端的学习能力使得目标检测性能有了极大地提升[3]。通常,基于深度学习的目标检测方法首先也是从图像中提取候选区域,然后采用卷积神经网络(Convolution Neural Network, CNN)等深度神经网络对候选区域进行鉴别和边界框回归,例如,文献[4,5]提出的区域卷积神经网络(Region-based Convolutional Neural network method, RCN)、快速区域卷积神经网络(Fast Region-based Convolutional Neural network method, Fast-RCN),使用selective search的方法产生候选区域,然后用CNN网络对候选区域进行分类。但是selective search方法中候选区域重叠,产生冗余,且无法在GPU上训练,检测效率低[6]。随后,文献[7,8]提出Faster-RCNN检测网络,其首先通过一个区域生成网络 (Region Propsal Network, RPN)来产生候选区域,然后再采用一个分类网络对候选区域进行分类和边界框回归,并且RPN网络和分类网络共享底层的特征提取层,极大地提升了训练速率。文献[9]中提出的YOLO网络,将物体检测作为回归问题求解,完成从原始图像的输入到物体位置和类别的输出,提高了目标检测速度,但是对于小目标的检测效果较差。CNN的计算瓶颈主要在于高维全连接层,其不仅参数多,计算复杂度高,容易导致过拟合,而且需要同样大小的图像输入,因此文献[10,11]提出了基于全卷积网络结构(Fully Convolutional Neural network, FCN)的目标检测方法,其主要特点是去除了CNN中的全连接层并对末层特征进行多层的反卷积,生成与输入图像分辨率一致的输出层,实现了图像的像素级分类,可以达到更好的检测效果。

针对大尺寸遥感图像的舰船检测,由于遥感图像尺寸较大(一般包含百万以上的像素点),而舰船目标在遥感图像中稀疏分布且相对尺寸较小,如果直接将图像输入到上述神经网络中进行处理,往往是不可行的。因此,目前针对大场景遥感图像下的舰船检测,主要使用滑窗的方法将大图分割为切片后送入到深度网络中检测。但是滑窗法存在大量的冗余计算,且对于滑窗参数(窗口大小、滑动间隔步长)的选择依赖性太高,影响目标的检测效率和检测精度[12,13]。因此,本文提出一种级联型的全卷积网络模型,将两个全卷积网络级联,第1个网络是一个简单的全卷积分类网络,实现大尺寸图像中船/非船区域的筛选;第2个网络是一个改进的UNet 结构,通过在传统U-Net结构中加入目标掩膜和舰船朝向估计层以进行多任务的学习, 实现任意朝向舰船目标的精细定位。

2 方法

深度学习的方法在处理大尺寸遥感图像时,为了降低计算量、提高检测精度,首先采用滑窗的方法将大图分割为切片,然后将切片送入到Faster-RCNN, YOLO等神经网络模型中进行检测。但是滑窗法的使用出现大量冗余信息,严重影响检测效率,且对滑窗参数依赖性比较大,可能出现漏船、船体截断的现象。

基于以上考虑,对于大场景遥感图像检测,本文设计了一种级联型的全卷积网络结构,图1为网络总体的框架图。目标预筛选全卷积网络(FCN for Prescreening, P-FCN)和目标精确检测全卷积网络(FCN for Detection, D-FCN)是两个级联的全卷积网络,P-FCN利用深度学习的方法实现了传统检测方法中的预筛选功能。将一张大尺寸的遥感图像输入P-FCN中后,得到包含舰船位置信息的热点图(heatmap),根据热点图得到疑似有船的候选区域,将候选区域送入到D-FCN网络中进行精确的舰船检测,最终通过两个级联的网络实现了对于大尺寸遥感图像下的目标快速检测。

2.1 P-FCN

2.1.1 P-FCN网络结构

P-FCN主要完成传统目标检测步骤中的预筛选功能,是一个简单的图像分类网络。与传统FCN网络不同,P-FCN不需要像素级分类即可实现目标预筛选,因此P-FCN不包含反卷积过程。为了满足检测速度的要求,将P-FCN设计为一个简单的4层全卷积结构,包含3个卷积层和1个池化层。如图1所示,P-FCN结构图中,Conv1卷积核大小为5×5,步长为4, Padding模式为“SAME”;Conv2卷积核大小为5×5,步长为4, Padding模式为“SAME”; Conv3卷积核大小为4×4,步长为1,Padding模式为“VALID”; Pooling1中卷积核大小为2×2,步长为2, Padding模式为“SAME”。

图2为P-FCN整体实验过程,主要分为测试和训练两个部分。训练时,将分为船和背景两类、尺寸为128×128的遥感图像输入到P-FCN网络中,得到包含船和背景特征的预训练模型。测试时,将尺寸为[W,H] (W为图像宽、H为图像长)图像,输入

到预训练模型中,得到包含舰船位置信息的热点图。由于P-FCN中Conv1, Conv2, Pooling1中的Padding模式均为“SAME”,其输出特征图大小仅与步长有关。图像经过Conv2后,输出特征图尺寸见式(1)。Conv3中Padding模式为“VALID”,其输出尺寸与步长、卷积核尺寸均有关,图像经过Conv3后,最终输出热点图尺寸见式(2)。其中[W,H]为原图尺寸,[WConv2,HConv2]为经过Conv2后特征图尺寸, [WConv3,HConv3]为经过Conv3后特征图尺寸, [Wf3,Hf3]为Conv3卷积核尺寸,Sf3为Conv3卷积步长,为向上取整符号。

为了得到原始图像中的舰船疑似位置,本文使用双线性插值方法将热点图变换到原图尺寸。最后对热点图进行连通域分析、候选框筛选等图像处理,得到疑似包含船的候选区域,实现快速预筛选功能。

图1 级联型网络总体架构图Fig.1 The overall frame structure of cascading network

图2 P-FCN实验过程Fig.2 The experimental process of P-FCN

由于P-FCN网络测试过程中,输入图像尺寸较大(均包含百万像素点),因此,本文在测试前通过对不同分辨率的图像设置不同的resize参数值(S),使得在保证一定准确率的情况下提高检测速度。图像resize公式为

其中,S为resize参数,W,H为原图尺寸,Wnew,Hnew为resize后图像尺寸。

2.1.2 P-FCN损失函数

由于网络是一个级联型的结构,两个网络结构单独训练,因此需要分别计算损失函数。P-FCN不是一个传统的FCN网络,不包含反卷积过程。训练时,输入图像尺寸为128×128,经过P-FCN后,输出尺寸为1×2,即实现舰船、背景的二分类。P-FCN使用交叉熵计算损失,式(4)为P-FCN中损失函数的计算公式,需要优化的目标函数是整个数据集中所有数据loss求和。其中N表示训练集中样本个数,表示图像真实的标签,表示预测标签。

2.2 D-FCN

2.2.1 D-FCN网络结构

D-FCN是一个改进的U-Net结构,图3为D-FCN结构图。D-FCN主要分为3个部分:特征提取、特征融合以及结果输出。在特征提取中为了避免训练过程中可能出现的过拟合以及梯度爆炸等问题,采用迁移学习的方法,通过借鉴ResNet50模型,完成对特征提取网络的初始化。特征融合部分借鉴了U-Net思想,在FCN的基础上,融合了卷积网络中高维和低维的特征,实现图像像素级分类的同时,提高了检测精度。结果输出部分,通过3个1×1的卷积层,分别得到1通道的置信分数图、4通道的矩形框边界信息图以及1通道的舰船旋转角度图。

传统U-Net模型在训练中将网络中的底层特征与原图对比构建损失函数,再利用反向传播算法对模型参数进行迭代更新。但是根据反向传播算法原理,模型中最靠近损失约束的参数将优先得到更新,其他参数的更新幅度会随着传播距离的拉长而逐渐衰减,这就导致了传统的U-Net 模型在训练时偏重底层参数的更新,对顶层的参数优化程度相对较差[11]。据此,本文通过在模型顶层引入额外的损失约束,使不同层级的参数都能得到较好的优化,从而进一步提升检测精度。

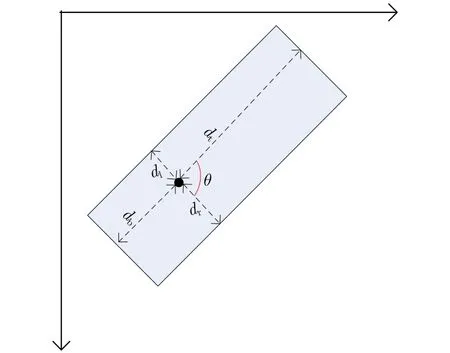

2.2.2 旋转矩形框定位

舰船目标旋转矩形框定位需要两个参数:舰船朝向角度和矩形框边界信息。在D-FCN网络中,首先对训练数据中的舰船目标按照顺时针方向,使用旋转矩形框对顶点坐标进行标注,然后根据标注信息生成目标掩膜,见图4,其中图4(a)为原始图像,图4(b)为根据真值坐标生成的目标掩膜,图4(c)为训练中得到的预测掩膜。最后对目标掩膜中的每个像素点定义为

图3 D-FCN结构图Fig.3 The frame structure of D-FCN

图4 SAR图像与光学图像中真值目标掩膜与预测目标掩膜生成Fig.4 The true target masks and the predictive target masks of SAR images and optical images

图5 旋转矩形框定位Fig.5 Rotating rectangle positioning

2.2.3 D-FCN损失函数

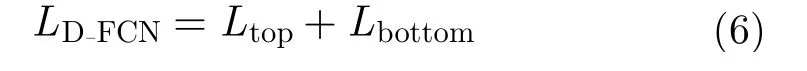

D-FCN是一个改进的U-Net结构,实现任意旋转方向的舰船检测,除了原有的底层损失外,加入了顶层损失,因此,D-FCN中总的损失函数为

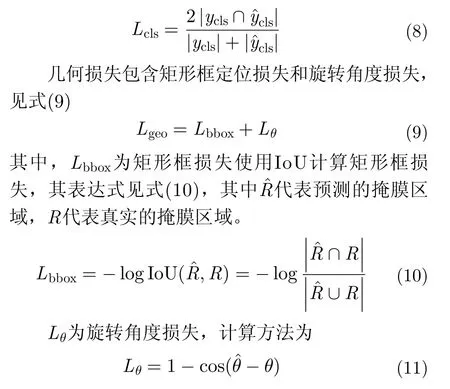

其中,Lbottom为底层输出结果与真值图的损失值,Ltop为顶层输出结果与相应低分辨率真值图的损失值。顶层损失与底层损失的计算过程相同,以底层约束为例,其损失约束分为分类损失和几何损失

其中,Lcls表示分类损失,在U-Net的预测图中,每个像素点的值代表舰船的置信分数,本文将大于0.5的值设置为255,得到预测掩模。使用Diss Loss方法通过将预测掩模与真实掩模作比较,构建分类损失函数见式(8),其中ycls代表真实掩模,y^cls代表预测掩模

3 实验过程与分析

本文主要针对大尺寸遥感图像舰船检测设计一种级联型网络结构,实现舰船位置快速预筛选与舰船精确检测。本文分别使用SAR图像和高分辨率光学遥感图像对网络结构进行测试。在SAR舰船检测实验中,将级联型网络分别与滑窗法以及YOLO3网络进行比较,验证网络性能。在高分辨率光学遥感图像舰船检测中,由于YOLO3只能获得目标的正置边界框,无法估计有朝向的舰船目标,因此只将级联型网络与传统滑窗方法做对比,验证网络性能。

3.1 SAR图像舰船检测

3.1.1 数据集构建与分析

(1) 数据集构建

在SAR图像目标检测实验中,主要包括从TerraSAR-X中获取的8景数据(包括上海港、横滨港、汕港等数据),具体图像信息见表1。

表1 TerraSAR-X数据基本信息Tab.1 The basic information of TerraSAR-X

实验过程主要分为训练和测试两个部分,训练时,P-FCN使用包含船与背景的128×128尺寸图像,包括7773张舰船图片,11780张背景图片。D-FCN使用512×512尺寸共4731张SAR图像进行训练。测试时,使用TerraSAR-X中截取的10张大尺寸遥感图像(3000×3000以上)对网络结构进行测试分析。

(2) P-FCN训练数据集分析

P-FCN网络主要针对大尺寸遥感图像进行舰船位置预筛选,实现图像分类功能。P-FCN训练数据分为背景(负样本)与舰船(正样本)两类,其中背景数据包括陆地、海岸、海面等类型,舰船数据包括简单海洋背景目标、复杂海洋背景目标(包含海浪、浮标等)、靠岸目标、包含单个目标以及包含多个目标等类型。

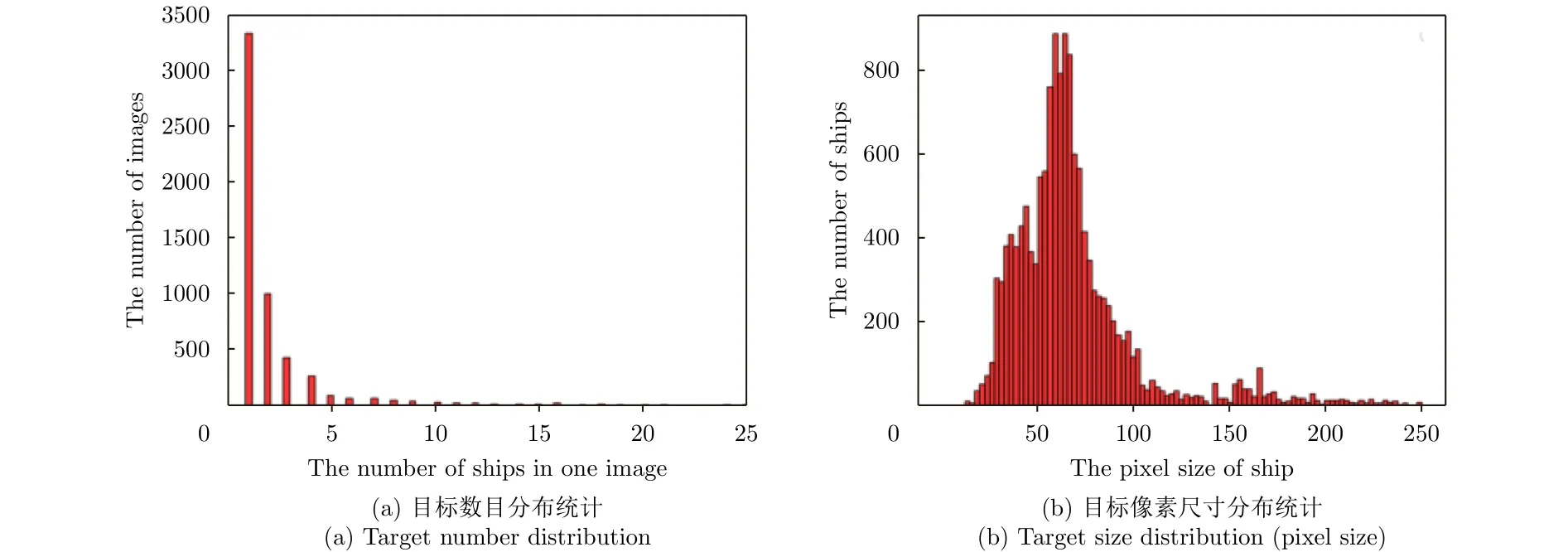

图6为P-FCN训练数据集统计,包括TerraSAR-X图像中单张图像包含目标数目统计以及目标像素尺寸统计。其中图6(a)表示TerraSAR-X目标数目统计,图6(b)表示TerraSAR-X目标像素尺寸统计。图6表明P-FCN训练数据集基本包含了所有舰船目标类型:包括不同目标数目、不同目标像素尺寸,满足训练要求。图6(b)显示训练样本中目标像素尺寸集中在128以内,对于尺寸大于128的目标类型,由于训练样本的作用是提取舰船特征,最终提取出的heatmap面积大于128,因此可以实现预筛选的功能。

3.1.2 实验结果分析

(1) P-FCN测试图像resize参数分析

本文针对大尺寸遥感图像舰船检测设计了一种全卷积网络级联结构,见图1。其中P-FCN实现舰船位置快速预筛选,D-FCN实现舰船精确检测。由于输入图像尺寸较大,严重影响检测速度,因此,在P-FCN网络测试前加入了图像缩放过程,见图2,通过设置resize参数值,在保证一定检测精度的情况下,提高检测速度。

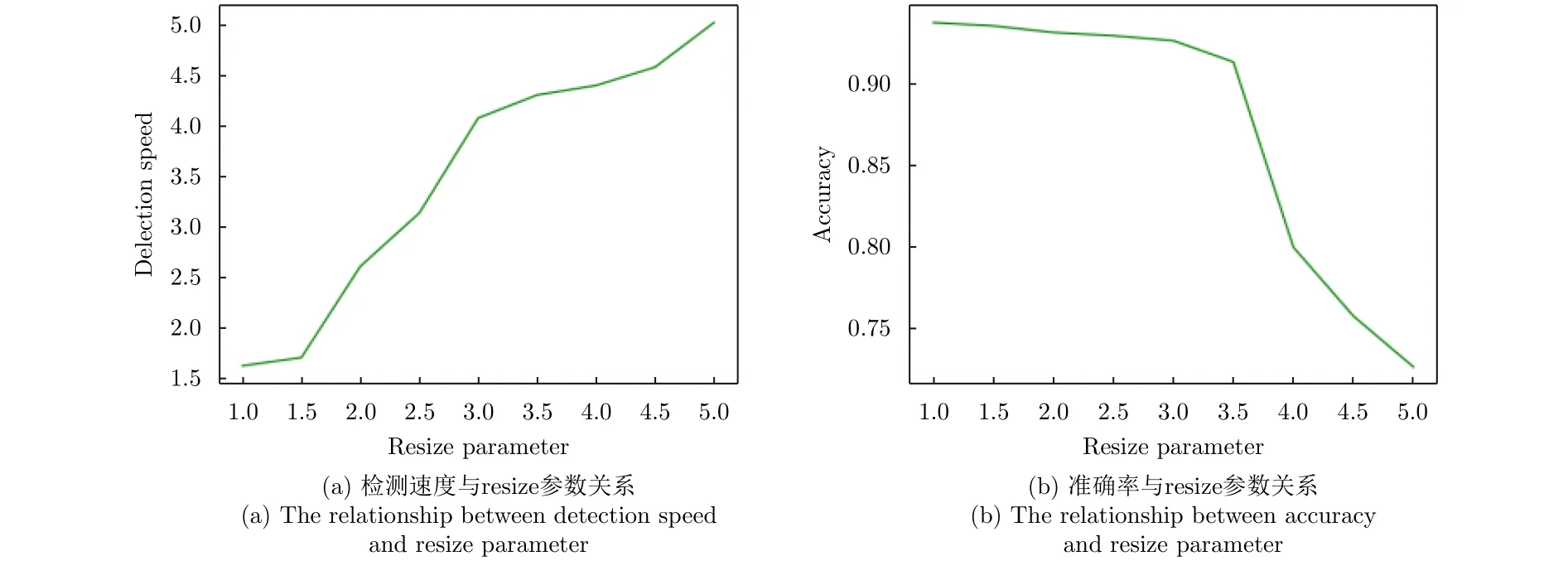

为了得到最优的resize参数,选取10张不同尺寸的SAR图像进行测试。分别比较resize参数与检测速度和准确率的关系,见图7。其中图7(a)表示resize参数与检测速度的关系(检测速度用检测时间的倒数表示)。由于图片尺寸不同,单张图片测试速度差异较大,因此将检测时间的单位设为s/1000×1000,即平均每1000×1000尺寸图像所用时间。图7(b)表示resize参数与准确率(召回率)的关系。

图6 P-FCN训练TerraSAR-X数据集统计Fig.6 The training TerraSAR-X dataset statistics of P-FCN

图7 resize参数与检测速度和准确率的关系Fig.7 The relationship of resize parameter between detection speed and accuracy

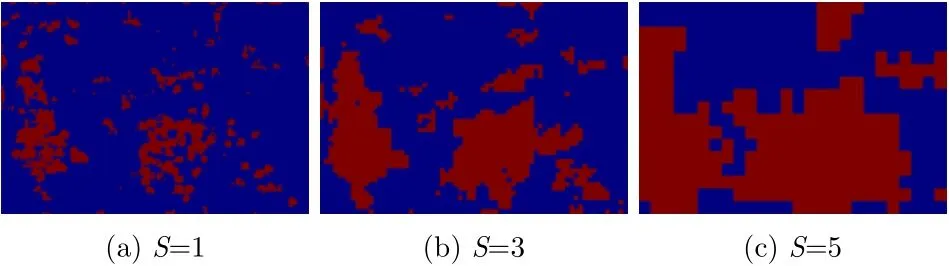

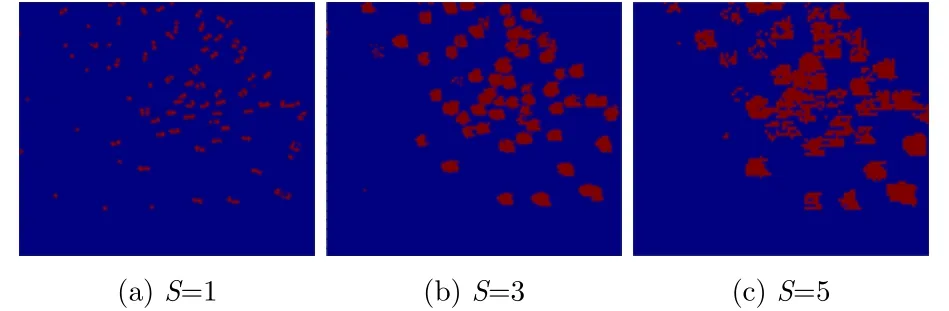

图8、图9分别展示了resize参数(S)为1, 3, 5时对应的热点图以及候选区域。根据图7—图9,对resize参数做如下分析:

图8 S=1, 3, 5时对应的热点图Fig.8 The heat maps corresponding to S=1, 3, 5

图9 S=1, 3, 5时对应的候选区域Fig.9 The probably proposals corresponding to S=1, 3, 5

(a) 图8、图9显示,S=1时,P-FCN网络能够较精确的估计舰船所在位置,但是候选区域较多,且存在大量虚警,影响D-FCN中的检测速度。S增大时,候选区域数量逐渐减少,且候选框面积增大。S=3时,候选区域相对较少,且能够筛选出图像中的所有船只,且虚警率较小,基本达到预筛选的要求。S=5时,候选框数量进一步减少,但是部分候选区域面积过大,影响D-FCN检测速度,且由于图像分辨率较低,预筛选时出现漏检现象,影响检测精度。

(b) 从图7(a)中可以看出,在S=3之前,由于输入图像尺寸较大,影响检测速度的主要是P-FCN网络。进行图像缩放后,由于计算量大量减少,因此,检测速度加快。在S=3之后,P-FCN网络对检测速度的影响逐渐减小,D-FCN网络对检测速度的影响增大,根据(a)中的分析,随着S增大,候选框面积增大(可以达到3000×5000左右),D-FCN中计算量较大,因此检测速度增加相对平缓。从图6(b)中可以看到,检测准确率随着S增大而降低。

根据以上分析,由于S=3时检测速度相对较高,且准确率为0.928,基本满足舰船检测要求,因此,在P-FCN网络中将resize参数值设为3。由于resize的目的是在保证一定检测精度的前提下降低分辨率,提高检测速度。从目前实验结果中可以得到的结论为,分辨率降低为3 m时,不会影响检测效果,因此对于其他分辨率图像可按比例设置resize系数。

(2) 预筛选结果分析

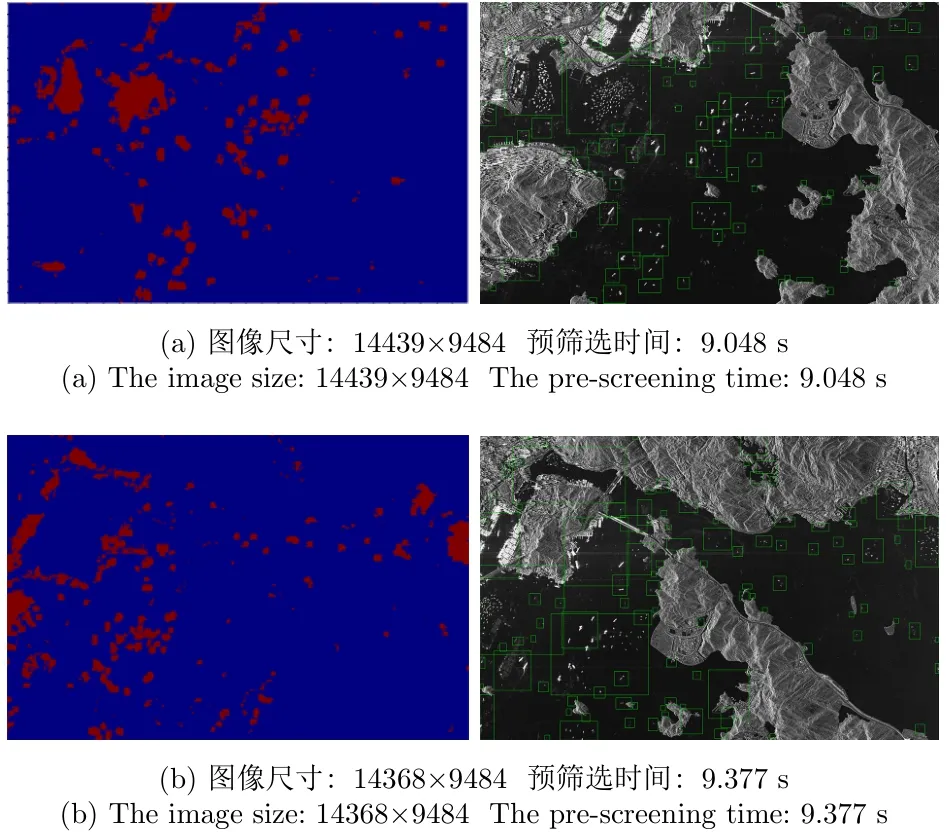

本文用到的级联型网络结构中,P-FCN网络预筛选是针对大场景遥感图像目标检测的重要步骤,能够实现对大场景遥感图像中舰船位置快速预筛选功能,使得在保证检测精度的情况下提升检测速度。预筛选实验主要对TerrSAR-X中截取的10张大尺寸图片进行测试,实验结果展示了具有代表性的两张TerraSAR-X图像(包含简单环境与复杂环境下的目标),见图10。图10(a)图片尺寸为14439×9484,预筛选时间为9.048 s(类型图1),图10(b)图片尺寸为14368×9484,预筛选时间为9.377 s(类型图2)。实验结果显示,P-FCN网络能够进行舰船位置的粗略预筛选,对海岸以及部分亮且细的海上建筑存在一定虚警,但是基本不存在漏检情况,满足检测需求。

图10 TerraSAR数据P-FCN测试结果Fig.10 The test result of TerraSAR in P-FCN

(3) 检测结果分析

在舰船检测实验中,将级联型网络结构与滑窗法、YOLO3做对比。用召回率(Recall)、精确率(Precision)衡量检测精度,用检测时间衡量检测效率。表2为对比实验结果,由于测试图片尺寸不一致,因此检测时间单位设为s/1000×1000。其中级联网络检测时间包括预筛选时间与D-FCN精确检测时间之和;滑窗法检测时间包括滑窗时间与D-FCN精确检测时间之和;YOLO3检测时间为YOLO3网络目标精确检测时间。表2结果显示,级联法由于使用P-FCN网络进行预筛选,与滑窗法、YOLO3网络相比,虚警较少,精确率较高。而相比滑窗法由于检测冗余较少,检测速度是滑窗法的2.35倍,相比YOLO3网络,检测召回率为0.928,检测精度更高。

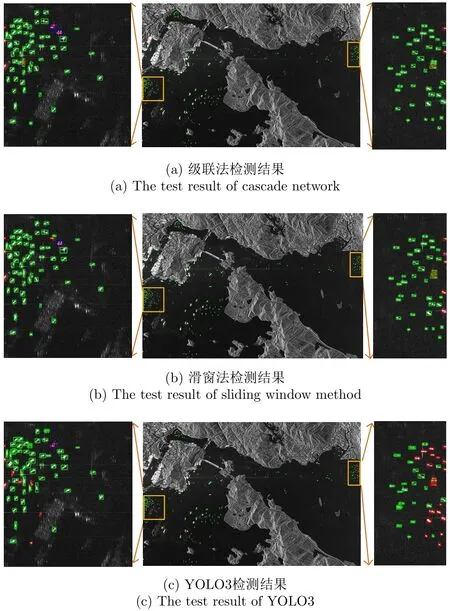

图11、图12为类型图1、类型图2检测结果,图11(a)(b)(c)、图12(a)(b)(c)分别表示级联法、滑窗法、YOLO3检测结果,为了分析检测结果,将部分检测区域放大。其中绿色表示正确检测、红色表示漏警、蓝色表示虚警。表3、表4为检测结果统计,使用TP(正确检测)、FN(漏警)、FP(虚警)、精确率、召回率、检测时间分别对级联法、滑窗法、YOLO3进行评价分析。根据检测结果可以看到,级联法相比滑窗法,召回率相似,但虚警较低,且检测速度具有明显的提升;相比YOLO3网络,YOLO3具有很高的检测速度,但图11(c)、图12(c)显示,YOLO3对于复杂场景(并排、密集分布、小目标舰船)检测效果较差,召回率较低。

3.2 光学遥感图像舰船检测

3.2.1 数据集构建与分析

(1) 数据集构建

在光学图像目标检测实验中,主要包括从91卫图和DOTA数据集中获取的数据,分辨率均为1 m左右[14,15]。

表2 级联型网络结构、滑窗法、YOLO3检测结果Tab.2 The test results of cascade network, sliding window method and YOLO3

图11 类型图1检测结果Fig.11 The test results of type 1 image

实验过程主要分为训练和测试两个部分,训练时,P-FCN均使用包含船与背景的128×128尺寸图像,包括4454张舰船图片,14524张背景图片。D-FCN使用512×512尺寸共3126张光学遥感图像进行训练,由于光学遥感图像目标特征相对SAR图像更加明显,因此,对光学遥感图像增加舰船旋转角度信息。测试时,使用大尺寸遥感图像(3000×3000以上)共50张光学遥感数据(包含10张DOTA数据和40张91卫图数据)。

图12 类型图2检测结果Fig.12 The test results of type 2 image

表3 类型图1检测结果统计Tab.3 The test results of type 1 image

表4 类型图2检测结果统计Tab.4 The test results of type 2 image

(2) P-FCN训练数据集分析

针对光学图像P-FCN数据集构建时,与SAR图像相同,分为舰船与背景两类,并且对于正负样本的选择同样包括不同类型。

图13为P-FCN训练数据集统计,包括光学遥感图像中单张图像包含目标数目统计、目标像素尺寸统计以及目标朝向统计。其中图13(a)表示光学图像中单个样本中目标数目统计,图13(b)表示光学图像中目标像素尺寸统计, 图13(c)表示光学图像中目标旋转角度统计。图13表明P-FCN训练数据集基本包含了所有舰船目标类型:不同目标数目、不同目标像素尺寸以及不同目标旋转方向,满足训练要求。

3.2.2 P-FCN测试图像resize参数分析

针对大尺寸高分辨率光学遥感图像舰船检测,在P-FCN网络预筛选过程中,本文选取10张不同尺寸的光学遥感图像对resize参数的选取进行测试分析,分别比较了resize参数与检测速度、准确率的关系,见图14,图14(a)表示resize参数与检测速度关系,检测速度用检测时间倒数表示,同样将检测时间单位设为s/1000×1000,图14(b)表示resize参数与准确率(召回率)的关系。图15、图16分别表示不同resize参数对应的热点图与候选区域。图14—图16显示,S=3时,对于光学遥感图像舰船检测,检测速度较高,且准确率为0.926,满足舰船检测要求。因此,在光学遥感图像舰船检测实验中将resize参数设为3。

3.2.3 检测结果分析

实验过程中,使用50张尺寸不同的高分辨率光学遥感图像对网络性能进行验证。由于YOLO3只能获得目标的正置边界框,对于有朝向的舰船目标不能估计有方向的边界框,因此在光学图像实验中,只将级联型网络与传统滑窗方法做对比。其中滑窗尺寸设置为512×512,步长设置为256,在结果分析中使用召回率衡量检测精度,使用检测时间(s/1000×1000)衡量检测速度。检测结果见表5。结果显示,在大尺寸高分辨率光学遥感图像舰船检测中,级联法与滑窗法检测精度相似,但级联法的检测速度是滑窗法的3.34倍。

实验结果中展示了具有代表性的3张大尺寸光学遥感图像(包括密集、并排、靠岸舰船),包括PFCN网络生成的热点图、候选区域预筛选结果,以及D-FCN精确检测结果。由于光学图像训练时加入舰船旋转角度信息,因此,检测结果中包含舰船旋转角预测,见图17。图17显示针对大场景光学遥感图像,级联型网络结构能够对舰船位置进行快速预筛选,并且实现任意朝向舰船的精确定位,检测速度较快,检测精度较高,基本满足目标检测要求。

图13 P-FCN 光学图像训练数据集统计Fig.13 The training dataset statistics of P-FCN

图14 resize参数与检测速度和准确率的关系Fig.14 The relationship of resize parameter between detection speed and accuracy

图15 S=1, 3, 5时对应的热点图Fig.15 The heat maps corresponding to S=1, 3, 5

图16 S=1, 3, 5时对应的候选区域Fig.16 The probably proposals corresponding to S=1, 3, 5

表5 滑窗法与级联法检测结果对比Tab.5 Comparison of sliding window and cascade method

4 结论

本文针对大场景遥感图像下的舰船快速检测,设计了一种级联型的网络结构。整体框架包括两个全卷积网络,第1个全卷积网络(P-FCN)是一个简单的二分类网络,实现对于舰船位置的快速筛选功能;第2个网络(D-FCN)是一个改进的U-Net结构,在传统U-Net网络中加入了顶层损失约束,使不同层级的模型参数均能得到较好地优化,提高检测精度。为了降低大尺寸图像在网络中的计算量,测试时,在P-FCN网络中加入了图像缩放(resize)步骤,并且通过比较resize参数与检测速度和检测精度(召回率)的关系,找到最优参数,使得在满足一定检测精度的前提下,提高检测速度。

图17 级联型网络结构检测结果Fig.17 The test results of the cascade network

实验过程中,对级联型网络结构同时在TerraSAR图像和光学图像中进行了测试。在SAR舰船检测实验中,使用10张TerraSAR图像,将级联法与滑窗法、YOLO3进行对比分析,实验结果表明:(1)级联型网络结构中P-FCN能够进行舰船位置的快速预筛选,排除大量背景冗余信息,虚警率较低;(2)TerraSAR数据测试结果表明,相对于滑窗法,在检测精度相当的情况下,本文的级联网络将检测耗时缩短为原来的1/3左右;(3)YOLO3本质上属于“one-step”的检测方法,在检测速度上有先天的优势,但对于复杂场景的适应性差。在舰船密集排布、舰船尺寸多样等场景中,检测精度低,无法达到级联网络和滑窗法相同的精度水平。在光学遥感图像舰船检测实验中,使用50张光学图像将级联法与滑窗法进行对比分析,结果显示,在光学图像中,级联法在与滑窗法检测精度相当的情况下,检测耗时同样缩短为原来的1/3左右。因此,本文所提级联型网络结构能够在保证一定检测精度的前提下,提升检测速度,满足检测需求。