基于Yolov4的学生在线学习状态分析研究

(西安培华学院,陕西西安市,710000)万 卷

1 研究背景

中国互联网络信息中心2020年4月28日在最新的中国互联网络发展状况统计报告中说:截至今年3月,在线教育呈爆发性增长,用户规模达4.23亿,比2018年底增长110.2%,占网民整体的46.8%。2020年,突如其来的新冠肺炎疫情影响了全球大部分人的生活及行业发展,在停课不停学的号召下,在线教育用户激增。截至2020年6月,我国在线教育用户规模达3.81亿,占网民整体的40.5%;手机在线教育用户规模达3.77亿占手机网民的40.4%。由此可见,在线学习数量非常惊人,那么让学生学会高效率的学习相当重要,同时这也是教育界以及家长们最为关注的问题。

2 研究内容

2.1 系统流程

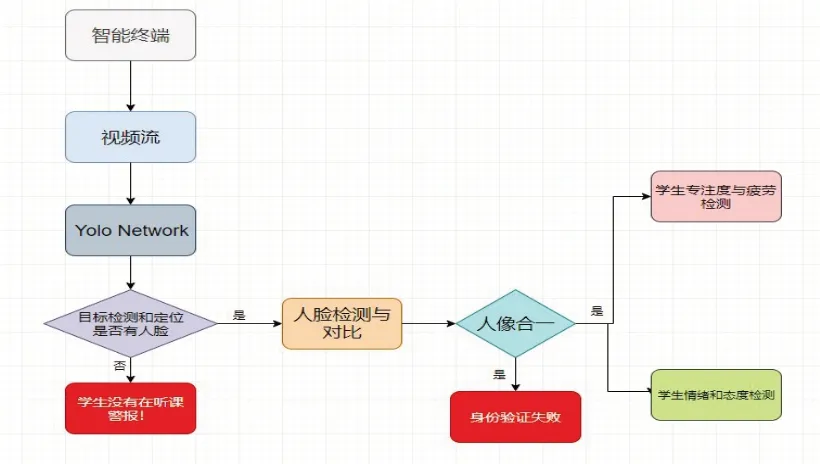

在本篇文章中,主要针对如何使用卷积神经网络模型提高学习效率展开了深入的探讨和研究,不仅探究了学生的眼部,还探究了学生的嘴部,除此之外,当然还有其他部位,通过判断这些部位,可以得知人们关于学生的疲劳以及学习情绪的判断是否准确和一致。在线学习状态的识别功能的设计从整体而言,可分为两个方面:①检测学生是否在移动设备前上课。②对学生进行疲劳度和学习情绪检测评估。流程如图1所示。

图1 目标检测与学情分析流程图

首先对学生进行目标检测与面部识别即对课堂上拍摄到的视频流进行人体目标检测。这里我们使用单阶段的基于改进的YOLOV4网络模型。YOLOV4优化了计算效率,使检测器在单个GPU上也能很好地完成训练。

2.2 模型介绍

YOLOV4分 为 Input,BackBone,Neck,Prediction。训练时对输入端的改进,主要包括Mosaic数据增强、cmBN、SAT自对抗训练。

骨干结构(BackBone)CSPDarknet53为了检测器MAP指标的提升,考虑选择一个图像特征提取能力较强的backbone,及兼顾了准确率又没有影响检测的速度。所以选择了具有CSP(Cross-stage partial connections)的darknet53。每个CSP模块前面的卷积核的大小都是3*3,stride=2,因此可以起到下采样的作用。因为Backbone有5个CSP模块,输入图像是608*608。经过5次CSP模块后得到19*19大小的特征图。同时使用的激活函数是Mish激活函数。

Neck:为了让输入头部的信息更丰富,在输入头部前,会将来自自底向上和自上而下的数据流按逐元素的方式相加或相连。所以说,头部的输入包含的信息还是蛮大的,该系统的这一部分即为颈部(Neck)。目标检测网络在BackBone和最后的输出层之间往往会插入一些层,主要用来融合不同尺寸特征图的特征信息,用SPP模块、FPN+PAN结构。在DC块之后引入3个最大池化层的SPP块,对多尺度池化提取和收敛的局部区域特征进行协整。池化前采用1×1卷积,将输入特征图的数量从1024个减少到512个。

将汇集的特征图和SPP块的输入特征图进行连接,得到sizefmap×sizefmap×2048个特征图作为SPP块的输出端。

网络的最后一部分是对象检测块,在这一部分中,将分辨率较高的DC块的输出特征图与分辨率较低的SPP块的输出特征图进行重建和并联。然后将上述特征图通过1×1×[K×(5+C)]卷积得到S×S×[K×(5+C)]特征图,用于对象检测。

训练时采用的损失函数是CIOU_Loss,预测框筛选为DIOU_nms。原因是提出一个好的检测边界回归的损失函数应该考虑三个重要的几何因素:重叠面积、中心点距离和长宽比。通过统一坐标,IoU损失考虑了检测框重叠面积,GIoU损失严重依赖IoU损失。DIoU loss旨在同时考虑检测边界框的重叠面积和中心点距离。然而,边界框的长宽比的一致性也是一个重要的几何因素。因此,在DIoU损耗的基础上,通过施加长宽比的一致性提出CIoU损耗。

通过该方法,重叠区域因素在回归中被赋予了更高的优先权,特别是对于非重叠的情况。

2.3 情绪检测

身份验证成功后对学生进行专注度及疲劳和情绪及态度检测评估。

通过使用ERT人脸特征点检测算法对人体的脸部各个部位进行检测,从而得出各个部位的坐标,然后找出坐标的中心点,从而更好的观察面部的状态,便于后期评估工作的进行,根据YawDD提供的数据,以此来作为依据,从而将数据集制作出来,目的就是为了更加彻底的判别人脸疲劳。

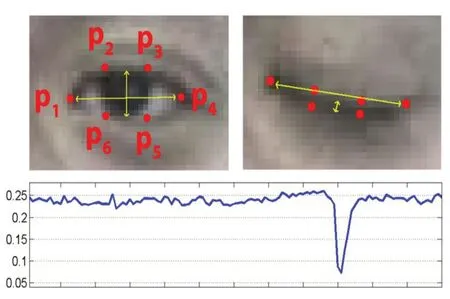

再判别面部专注度的时候,会使用到类似PERCLOS参数来进行判断,我们可以确定眼睛的开闭状态。首先,DHb库中的ERT算法检测到68个面部特征点,如图2所示。

图2 Dlib—68个人脸特征点

我们定义37->p1,38->p2,39->p3,40->p4,41->p5,42->p6,上图中的特征点p1,p2,p3,p4,p5和p6是面部特征点中相对应的表示眼睛的六个特征点。如图3所示。

图3 Dlib—68个人脸特征点

无论是睁开眼睛还是紧闭眼睛,如上图所示,就显示了眼睛再睁开和闭合的时候,眼睛部位各个点之间的关系,其呈一条直线的状态。由此可见,当睁开眼睛或者是闭上眼睛的时候,这些点的长宽比都是不一样的。在计算眼睛闭合程度的时候,可以采用EAR方程来进行计算。

在使用分子计算的时候,可以依据眼睛的特征部位进行计算,也就是说在眼部周围有一些特征点,根据这些特征点进行计算,这会更加容易计算出垂直方向上距离的大小,不同的是,在分式的分母中,主要用于眼睛周围部位水平距离的计算,当一组水平点与两组垂直点同时出现的时候,为了使得两组特征点有着一样的权重,那么此时分母应该再乘以2,从而达到这个目的。

利用眨眼状态进行疲劳检测,当EAR小于阈值时,接连多少帧发生眨眼动作,才认为当前眼睛是因为疲劳闭合的。现阶段主要的研究表明人出现疲劳时,每次眨眼时间占用1~2秒,假设视频30帧每秒,相当于占用连续的30~60帧。可以将眼睛持续闭合时间超过2.2s(连续帧数超过66帧)作为疲劳闭合判定的阈值。哈欠检测采用类似EAR的方法判断。嘴巴张开程度在打哈欠时比正常说话时大很多。

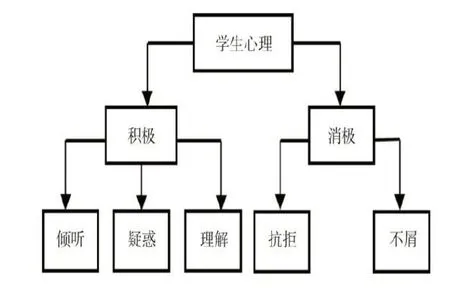

对于表情来说,可以展现出一个人情绪如何,是一个人情绪的外在体现,研究人员在研究人类情绪的时候,也会以此来做依据。对于面部表情来说,通常情况下,测量起来并不是件困难的事。通过调查研究大学课堂中学生的实际心理状态,并参考相关文献进行归纳和总结,我们重新定义了“倾听”、“疑惑”、“理解”、“抗拒”、“不屑”五种表情,如图4所示。

图4 根据学生心理重新定义的五种表情

在上面的结构图中,可以看出,“倾听”可以代表着学生在听课的时候很专心致志。“疑惑”代表着学生在听课的时候,会跟着老师的步伐,然后遇到不懂的地方就会产生疑问。“理解”代表着学生在上课的时候,经过认真听讲以后,能够领会课堂上所学习的内容。“抗拒”代表着学生对课堂上所学习的东西产生了厌恶心理。“不屑”代表着学生对课堂上学习的内容失去了兴趣。在上面的几种表情中,能够表现出学生在课堂上愿意学习的表情包括倾听,疑惑和理解。剩余的表情反映出了学生对课堂的厌恶。

3 结语

在当前主流检测方法中,检测率仍然处于较低的状态,并且对学生在线学习状态的判断还不够全面,本文使用深度学习中较为先进的YOLOV4作为目标检测算法,面部特征的检测越来越准确,通过在课堂上对学生的眼部、嘴部等区域进行采样与分析,使学生在线学习状态的测量和评价更具现实意义。