基于YOLOv4的胡瓜钝绥螨自动检测计数

李建兴, 刘振宇, 马 莹, 何栋炜, 郑小刚, 宋 江

(福建工程学院电子电气与物理学院,福建福州 350118)

目前,全世界在开展绿色防控技术方面的需求日趋急迫。我国是农业大国,也是农药使用大国,长期累积形成较大的环境和生态问题。生物防治是从根本上解决农药滥用和残留问题的有效途径,天敌驯化并形成产品是生物防治的重要基础。捕食螨的驯化与推广应用是天敌驯化的重要分支。近年来,我国已研发出具有自主知识产权的天敌捕食螨工厂化生产技术。胡瓜钝绥螨是捕食螨的一种,它广泛分布于世界各地,利用胡瓜钝绥螨能有效控制蓟马和叶螨等害虫,可在农业螨害绿色防治上发挥重要作用。目前胡瓜钝绥螨已经能够进行工业化养殖,在工业养殖过程中质量检测尤为重要,待出厂销售的产品需要对胡瓜钝绥螨数量进行计数检测。现阶段质量检测工作步骤为专业人员对养殖的胡瓜钝绥螨进行抽样检测,在显微镜下进行人工计数,这种方法效率低下。由于粉螨与胡瓜钝绥螨长相相似,肉眼长时间检测会提高检错概率。为了解决这一问题,本研究建立一种准确快速的捕食螨检测计数工具,以期对提升胡瓜钝绥螨工业化生产质量检测提供指导。

目标检测是当前计算机视觉领域的研究热点之一。近年来目标检测技术在昆虫防治检测、农业养殖领域的应用取得了较大进步。基于回归思想YOLO(you only look once)检测算法,经过单次检测可直接得到最终的检测结果,因此有着更快的检测速度,满足实时检测要求。YOLO算法经过不断改进,优化了对小目标类的检测性能,到目前的YOLOv4版本,针对螨虫类小目标的检测精度高。

为了解决胡瓜钝绥螨自动检测计数问题,本研究使用工业相机搭配电子显微镜制作螨虫数据集,构建YOLOv4检测模型对螨虫进行分类检测,利用该模型多尺度、高精度分类的特点,对胡瓜钝绥螨、粉螨进行准确区分计数。

1 材料与方法

1.1 试验设计

本研究通过工业相机搭配电子显微镜拍摄,拍摄样品是福建省农作物害虫天敌资源工程技术研究中心生产的合格罐装螨,罐装内包含麦麸(生长环境)、胡瓜钝绥螨、粉螨。罐装螨内含有大量麦麸,螨虫附着于麦麸表面。使用40目、孔径为 0.45 mm 标准筛将麦麸和螨虫进行初步过滤,可以将螨虫和面积较大的麦麸进行分离,有利于后期图像拍摄。

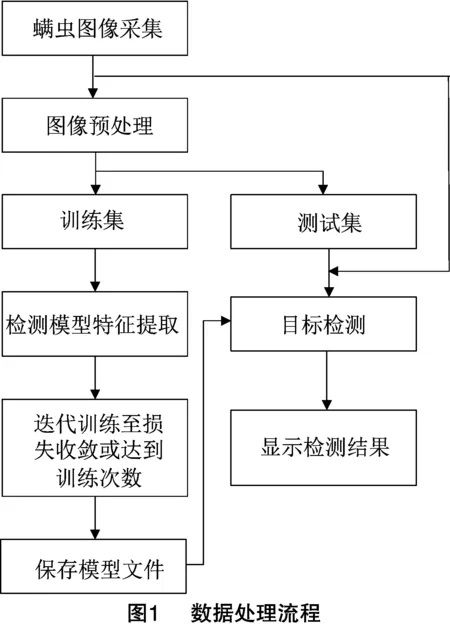

每次从样品罐中取0.1 g麦麸进行初步过滤分离后得到的麦麸碎片和螨虫放入定制凹槽载玻片(凹槽深度1 mm,长宽14 mm)中,胡瓜钝绥螨和粉螨具有活性会在凹槽载玻片中移动,每间隔 10~15 s 拍摄1幅照片,每拍摄30幅照片后更换凹槽载玻片重新取样拍摄。将所采集到的数据进行处理,整个数据处理流程见图1。

1.2 图像采集

本试验图像采集装置见图2。主要由调焦机构架、CMOS(互补金属氧化物半导体)工业相机(200万像素,型号为XG200S)、电子显微镜头(目镜0.5×,物镜0.8×)、定制凹槽载玻片、LED(发光二极管)背光源组成。将通过振动过滤后的螨虫放入载玻片凹槽内,垂直凹槽向下拍摄。采集图像总数量为1 030幅,拍摄图像放大倍数为40倍,图像分辨率为1 280×1 024像素,图像格式为jpg。

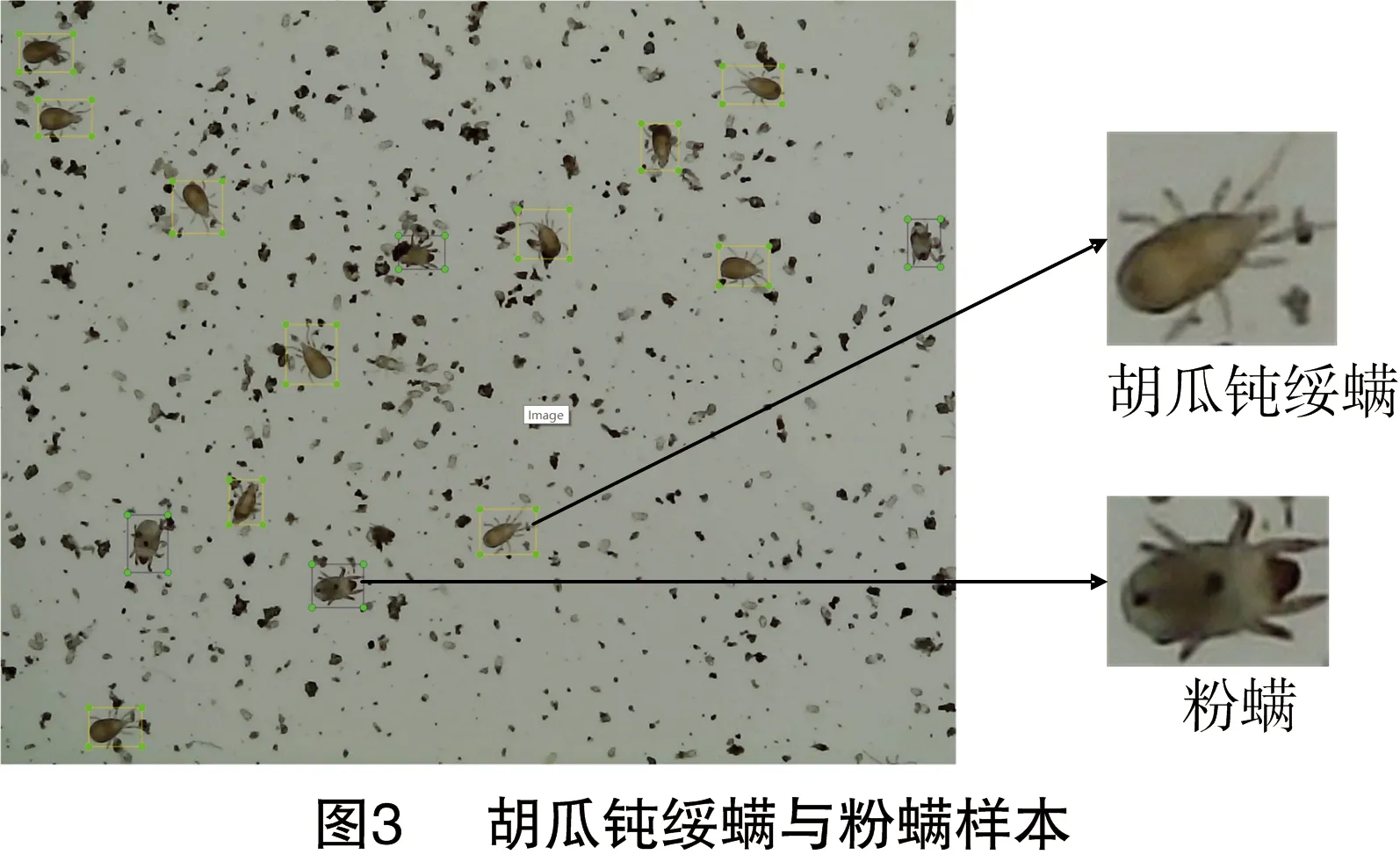

在载玻片上拍摄的图像中螨虫种类为2种,分别是胡瓜钝绥螨、粉螨,图像中存在少许幼虫,质量把控检测对象为胡瓜钝绥螨成虫(体长约0.20~0.50 mm)数量,粉螨幼虫体积不到胡瓜钝绥螨和粉螨成虫的1/10,对检测胡瓜钝绥螨成虫不影响,因此本试验标签主要分为2类:胡瓜钝绥螨成虫(hunt)、粉螨成虫(dust)。胡瓜钝绥螨和粉螨采集样本见图3,胡瓜钝绥螨形态呈椭圆型头部尖锐,在背光源照射下通体呈米黄色。粉螨形态圆润呈椭圆状,在背光源照射下通体呈灰色。

1.3 捕食螨品质检测人机界面设计

为了方便操作人员进行检测,设计了GUI(图形用户界面)品质监控界面,见图4,在监控界面中,点击打开相机,可以调用相机进行拍摄并且加载到界面中,点击捕食螨虫计数,即会调用模型进行检测计数,检测结果会显示至界面,分别将胡瓜钝绥螨与粉螨计数结果显示在左上角。

2 基于图像处理的捕食螨自动识别计数方法

2.1 数据集预处理

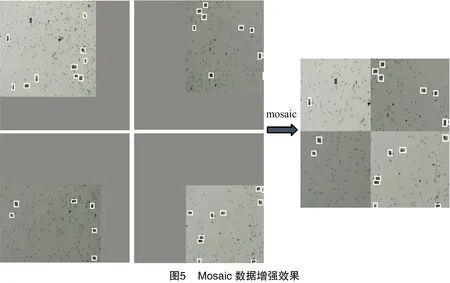

使用LabelImg图像标注工具对采集的螨虫图片进行标注,生成xml格式文件,文件中保存矩形框的长宽高和中心坐标以及标注类别等信息。每头螨虫使用一个矩形框标注,矩形框大小以螨虫最小外接矩形为最佳。在图片边缘存在拍摄不完整螨虫,人工进行判断标注。每标注完1幅图片上所有目标螨虫将保存文件,标注了1 030幅图片,共标注了10 590个胡瓜钝绥螨标签,3 038个粉螨标签。为了丰富所采集到的数据集背景,通过mosaic(马赛克)数据增强方法,每次将读取到的4幅图片进行水平翻转、缩放、色域变化、垂直翻转,并且4个方向按照一定比例进行截取后拼接出一幅新的训练图,数据组合效果见图5。网络输入端为了提高网络训练和减少运算量,将图片的尺寸大小统一调整至608×608像素。

将数据集中包含的图片和xml格式标签文件分别放入不同文件夹,图片与标签的文件名相对应。训练模型之前,将1 030幅数据集随机分为训练集、验证集、测试集,训练集和验证集占总数据集的90%,测试集占总数据集的10%,其中,训练集和验证集的比例为9 ∶1。

2.2 螨虫检测方法介绍

目标检测方法可以分为传统检测算法和深度学习检测算法。传统的检测方法通常分为区域选择、特征手工提取、分类回归3个步骤,其中区域选择耗时长且效果不好,特征手工提取所提取的语义特征信息少,该方法目前已经难以满足对复杂背景的高性能检测需求。随着深度学习发展,在实际检测过程中,表现出高精度、实时性、特征自动提取等优点,深度学习逐渐成为研究人员所青睐的检测方法。

目前,深度学习目标检测常用的主流算法分为两大类,第1类是两阶段检测算法,首先由算法生成一系列作为样本的候选框,再通过卷积神经网络进行样本分类,代表算法有Faster R-CNN(区域卷积神经网络)。第2类是一阶段检测算法,不需要产生候选框,直接将目标框定位的问题转化为回归问题处理,代表算法有YOLO模型、EfficientDet模型。

Faster R-CNN算法结构为主干特征提取网络、RPN (区域生成网络)、ROI(特征图上的框) Pooling层、分类与回归层,图像传入主干特征提取网络得到特征层,采用RPN对特征图上的每个网格进行滑窗处理,得到每个网格上锚框调整参数以及判断框内是否包含物体,获得候选框,完成第1阶段前景与背景的粗定位,再将获得的候选框传入至ROI Pooling层调整至相同大小,最后传入分类与回归层,判断是否包含目标且对候选框进行调整得到最后的预测结果,该两阶段算法经过前景背景粗筛选后再对物体进行精细调整,检测精度高,但由于特征图锚框尺度较大,对于小尺寸目标的检测效果不佳。

EfficientDet算法结构为EfficientNet主干特征提取网络、BiFPN特征融合层、类别与边界框预测层,图片传入主干特征提取网络,该网络利用残差神经网络结构增大神经网络的深度,通过更深的网络提取特征,获得5个有效特征层完成初步的特征提取,将所得到的5个有效特征层传入FPN结构的改进版BiFPN特征融合层,BiFPN模块对获得的特征层进行多次自顶向下、自底向上的双向路径特征加权融合,获得具有更高语义的有效特征层。最后对特征加以利用整合,输入类别与边界框预测层得到最后的检测结果。EfficientDet算法中具有多尺度特征融合结构,提升了对小尺寸目标的检测性能。

YOLO算法经过不断改进,相对比于YOLOv1、YOLOv2版本,YOLOv3、YOLOv4、YOLOv4-Tiny版本拥有多尺度预测结构,提高了对不同尺寸目标的检测性能,其中YOLOv3算法结构为Darknet53主干特征提取网络、FPN特征融合层、YOLOv3预测层。其中Darknet53主干特征提取网络利用残差网络结构,增大网络深度提取图像特征。图像经过主干特征提取网络后获得3个有效特征层,后传入FPN特征融合层通过融合高低层特征提升目标检测的效果,尤其可以提高小尺寸目标的检测性能,将所得到的特征最后输入YOLOv3多尺度预测层中得到分类结果以及边界框参数。YOLOv4算法在YOLOv3算法基础上结合了同时期几种优秀网络结构,在保证计算速度的情况下,针对小尺寸目标检测精度有进一步提升。YOLOv4-Tiny是 YOLOv4的简化版,在主干特征提取网络中卷积层数减少,在特征融合部分采用FPN特征融合结构,仅使用了2个特征层进行分类回归预测,提升了检测速度,但精度有所降低。

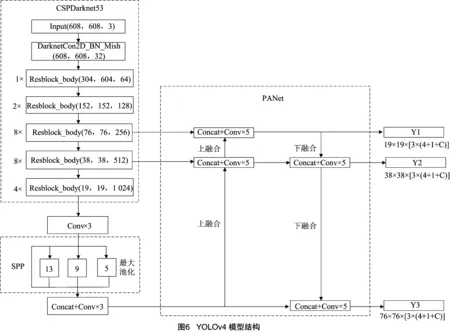

2.3 YOLOv4模型结构

YOLOv4模型结构见图6,主要包括CSPDarknet53主干特征提取网络、Neck模块、YOLOv3头部。特征提取网络结构采用CSPDarkNet53网络,输入的图像经过CSPDarkNet53网络中5个残差单元块,每个残差单元块个数为1、2、8、8、4,图像大小不断压缩,所提取的特征深度不断堆叠,提取图像中更深层的语义信息,最终获得3个有效特征层,特征层维度分别为中层(76,76,256)、中下层(38,38,512)、下层(19,19,1 024),中层特征图感受野较大,用于预测图片当中的较大目标物,中下层特征层用于预测中等大小目标物,下层特征图提取图像中更深层语义信息,细节信息表达能力更好,用于预测图像中较小目标物。

其中Neck模块中增加空间金字塔池化模块(spatial pyramid pooling,简称SPP)网络结构,对CSPdarknet53处理后的最后一个特征层分别利用4个不同尺度的最大池化进行特征融合,池化核大小分别为13×13、9×9、5×5、1×1,这样有助于极大地增加感受野,能将最显著的上下图特征分离出来。路径聚合网络(path aggregation network)结构为Neck模块的特征融合部分,对CSPDarkNet53处理后的特征层中层、中下层、下层进行PANet特征金字塔多通道融合,由图6可知,首先进行1次自底向上的多尺度特征融合,下层特征层进行多次上采样将所提取到的特征传递到中层,经过多层网络才能达到金字塔顶端,后继续进行1次自顶向下路径增强分支,尽可能多地保留特征信息,实现特征的反复提取,有效提取图像中有效的特征。

经过PANet网络结构处理后,最后将获得的特征进行回归预测处理,YOLOv4采用的是YOLOv3的预测头。首先会将整幅图像划分为S×S个小方格,在(19×19)、(38×38)、(76×76)3个特征图上进行回归预测,利用Anchor机制每个特征图的小方格都会预测3个大小不同的边界框,每个边界框会产生(4+1+C)维向量,其中4表示网格预测目标中心的偏移量(,)和边框尺寸相对于整幅图片的宽高尺寸(,),1表示目标边框置信度值,C为识别目标类别数。本研究的需求为检测胡瓜钝绥螨和粉螨2个类目,因此每个边界框的输出向量为(4+1+2)。

2.4 回归损失函数

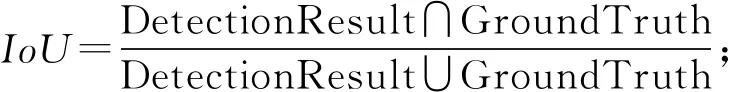

YOLOv4回归损失函数使用全局交并比(complete-intersection over union,简称CIoU),计算公式为式(1),利用该检测算法评价边界框是否存在目标物体以及检测准确度,CIoU考虑了检测框的重叠面积、中心点距离、长宽比,优化了训练过程中发散等问题且在矩形框回归预测问题中有速度与精度的提升。其中IoU为评价预测框与真实框的面积交并比,计算公式为式(2)。

(1)

(2)

(3)

(4)

式中:为2个框中心点欧式距离;、分别为预测框、真实框的中心点,可以反映出预测框与真实框的距离;表示2个中心点最小外接矩的对角线长度;为权重参数;DetectionResult、GroundTruth分别为预测框的面积和真实框的面积;(,)、(,)分别为预测框、真实框的宽、高;为长宽比的惩罚项,用来测量长宽比的一致性,该惩罚项作用就是迅速控制预测框的宽高能够尽可能快速地与真实框的宽高接近,使模型预测位置准确度提高。

3 试验结果与分析

3.1 试验环境与参数设置

本试验研究采用Pytorch深度学习开源框架,使用图像处理器加速训练过程。硬件配置:图形处理器为英伟达GeForce RTX 3090 (显存为24 GB),中央处理器为英特尔酷睿 i7-10700K @ 3.80 GHz,内存为16 GB。运行环境为Windows10,CUDA库版本为11.0,Python版本为3.7,Pytorch版本为1.7.1。

搭建好YOLOv4、YOLOv4-Tiny、YOLOv3、Faster R-CNN、EfficientDet共5种目标检测模型后,由于螨虫数据集较少,使用迁移学习的方法进行训练。网络权重由YOLOv4模型训练MicroSoft COCO数据集得到,该数据集是一个大型的、丰富的物体检测数据集,训练得到的网络参数可以作为检测模型预训练权重,这种训练方法是常用且高效的,使用该预训练权重能节省螨虫数据集训练时间,网络训练过程收敛更快、检测效果更好。

对胡瓜钝绥螨、粉螨2种试验样本图像分别标定好后生成对应xml文件放入待训练文件夹中,将搭建好的几种深度学习模型设置好训练参数,设置训练阶段批量大小batch_size=8,总训练轮数为100,初始学习率为0.001 0,学习率在50轮后下降至0.000 1。

3.2 评价指标

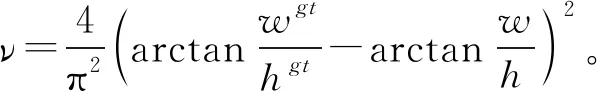

召回率(recall)也称作查全率,表示在所有真实目标(TP+FN)当中模型能够预测正确的目标比例,计算公式为式(5),本研究预设定的IoU阈值为0.5,TP(true positives)代表模型正确分配出的正样本个数,即预测框与标注框类别相同;FN表示错误分配成了负样本的个数。以胡瓜钝绥螨为例,模型能够正确找出图片中更多的胡瓜钝绥螨召回率越高,展示出模型识别目标的能力。

(5)

精确率(precision)也称作查准率,计算公式为式(6),表示模型检测出正确目标所占的比例,(TP+FP)是模型检测的所有正样本,精确率用来表示模型检测的准确性,精确率越高,表示模型检测的准确性越好。

(6)

由于精确率和召回率会随参数交并比的变化而改变,因此单单使用精确率和召回率作为模型的评价指标存在一定的局限性。

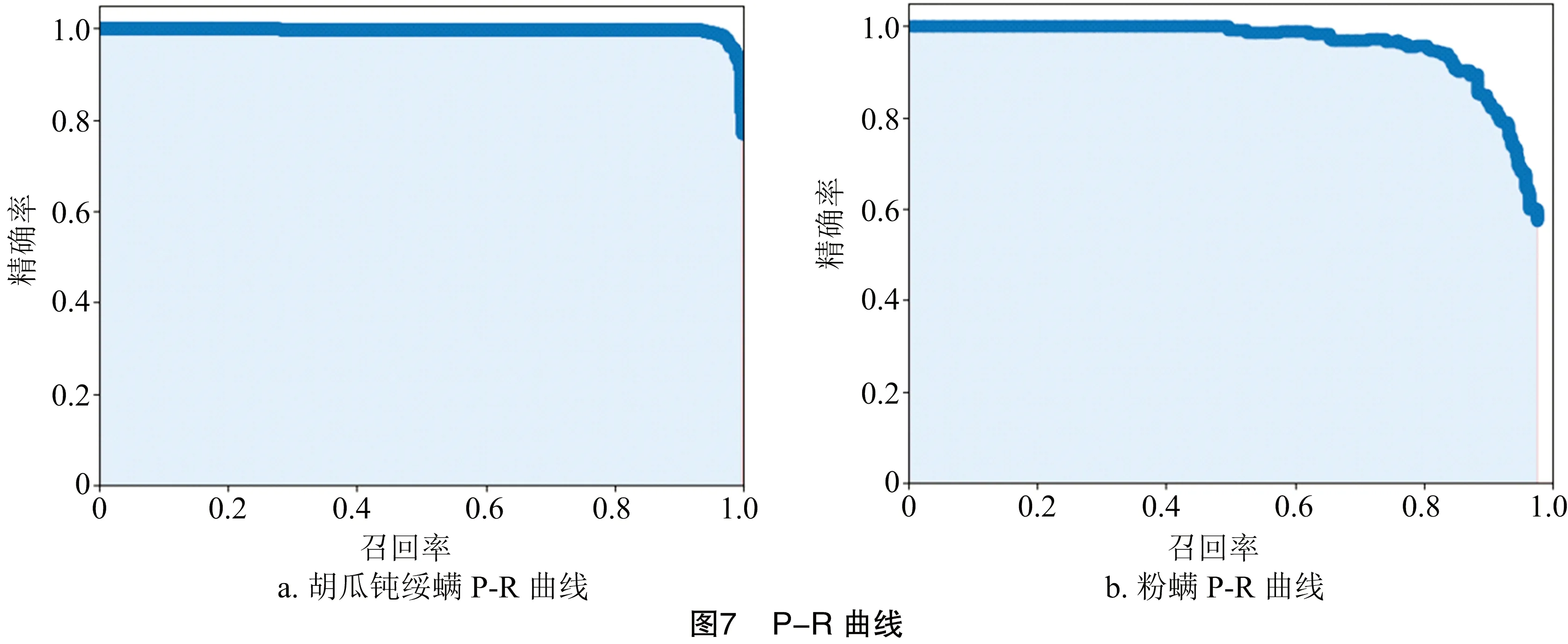

本研究以胡瓜钝绥螨检测精度(average precision,简称AP)、检测精度平均值(mean average precision,简称mAP)和检测时间作为模型性能评估指标。每一类别螨虫检测精度指的是P-R(precision-recall)曲线下区域面积,检测精度数值越大,表示算法针对该类别检测效果越好。检测精度均值(mAP)即为胡瓜钝绥螨、粉螨2个类别的检测精度均值,计算公式见式(7)。

(7)

式中:代表检测的总类别数量;为类别的序号数。检测精度均值数值越大,表示算法对所有类别整体检测性能越好。

3.3 YOLOv4检测结果

将103幅测试集使用YOLOv4模型进行目标检测,测试集图像中一共有1 213头胡瓜钝绥螨,280头粉螨,检测过程当中IoU阈值设置为0.5,可保留更多预测框,所计算的精度率会更准确。在对应置信度下得到、、值,根据公式(5)、(6)分别计算出2类螨虫在不同置信度下所得到的精确率和召回率,由精确率和召回率围成的P-R曲线见图7。胡瓜钝绥螨的检测精确率为99.45%,粉螨的检测精确率为93.94%,最后求得胡瓜钝绥螨、粉螨2个类别检测精度均值为96.69%。

3.4 多种算法对比分析

本研究使用相同的图片数据集和网络参数,分别使用YOLOv4、YOLOv4-Tiny、YOLOv3、Faster R-CNN和EfficientDet共5种检测模型进行试验对比。

在训练好以上5个模型后使用图像采集装置随即拍摄3幅图片a、b、c进行试验对照,图片中存在杂质和螨虫相接触的情况,检测效果见图8,5种模型的检测效果均有不同的差异。在图8-a中,YOLOv3模型所检测到的目标中存在漏检测1头胡瓜钝绥螨,将胡瓜钝绥螨和杂质误判断为粉螨的情况,Faster R-CNN模型所检测到的目标中存在将4个杂质误判断为粉螨,1头粉螨未被识别,EfficientDet模型检测结果中存在1头胡瓜钝绥螨未识别。在图8-b中,YOLOv3模型和EfficientDet模型检测结果中均存在漏检2头粉螨且将杂质误检测成粉螨的情况。在图8-c中,YOLOv4-Tiny模型检测结果中存在漏检测1头粉螨,且图片中2头胡瓜钝绥螨接触状态时误检测为1头且存在将胡瓜钝绥螨误分类为粉螨的情况,YOLOv3模型检测中存在漏检测胡瓜钝绥螨的情况,Faster R-CNN模型检测结果针对检测胡瓜钝绥螨接触状态时只能检测出单头且目标框定位不准确,EfficientDet模型检测结果存在漏检测粉螨情况。从这3幅图片中,可以看出YOLOv4检测效果最佳,在存在杂质和螨虫相接触的情况下,相接触螨虫能够较好地被分别检测出且不存在误检测情况,检测出的螨虫置信度值(预测类别是真实类别的概率)也是5个模型中最高的,YOLOv4模型针对螨虫小目标检测具有良好的鲁棒性。

使用相同测试集103幅图片,其中测试集共有1 213个胡瓜钝绥螨和280个粉螨标签,分别对5种模型进行评估。在相同IoU阈值下,由表1可知,YOLOv4模型针对胡瓜钝绥螨的平均检测精度比YOLOv4-Tiny模型高4.48百分点,比YOLOv3模型高0.11百分点,比Faster-RCNN模型高25.39百分点,比EfficientDet模型高7.91百分点,以上数据表明YOLOv4模型针对于胡瓜钝绥螨的检测能力更为优秀。

表1 不同算法在测试集检测结果

YOLOv4检测模型检测2类螨虫的检测精度均值高于YOLOv4-Tiny模型14.85百分点,高于YOLOv3模型2.12百分点,高于Faster-RCNN模型35.77百分点,高于EfficientDet模型27.18百分点。针对螨虫小目标数据集,YOLOv4模型的检测精度均高于其他检测模型。

对单幅图片检测时间进行测试,使用图像采集装置拍摄10幅螨虫照片,分别使用5个模型对采集的照片进行预测计时,平均检测时间为检测10幅照片所耗费的时间均值,其中YOLOv4-Tiny模型由于结构是YOLOv4的简化版,只使用2个预测特征层,网络参数少,预测时间最快,达到平均检测单幅图片时间为0.098 s,YOLOv3平均检测单幅图片时间为0.115 s,YOLOv4平均检测单幅图片时间为0.137 s,Faster-RCNN平均检测单幅图片时间为0.154 s,EfficientDet模型平均检测单幅图片时间最慢为0.164 s。YOLOv4在5个模型中检测时间为中等,平均检测时间为0.137 s,满足质量检测过程对速度的要求。

4 结论

本研究使用采集装置随机拍摄3幅螨虫图片进行试验,在图片中存在杂质且螨虫相接触的情况下,YOLOv4模型均能够准确检测胡瓜钝绥螨、粉螨,检测效果明显优于同系列的YOLOv4-Tiny、YOLOv3模型,及主流算法Faster R-CNN和EfficientDet模型。

通过现场随即拍摄图片对5种模型进行检测计时,结果表明YOLOv4模型检测单幅图片平均时间仅需0.137 s,检测速度达到现场应用要求。

本研究所构建的YOLOv4胡瓜钝绥螨检测模型与现有的几种流行检测模型进行比较,结果表明,YOLOv4模型对胡瓜钝绥螨检测精度分别比YOLOv4-Tiny模型高4.48百分点,比YOLOv3模型高0.11百分点,比Faster-RCNN模型高25.39百分点,比EfficientDet模型高7.91百分点,YOLOv4检测模型对胡瓜钝绥螨和粉螨检测精度均值均高于YOLOv4-Tiny、YOLOv3、Faster-RCNN、EfficientDet模型,能达到高准确率检测胡瓜钝绥螨。

通过测试集与实际拍摄图片测试表现,本研究提出基于YOLOv4检测算法应用于螨虫检测计数方案是可行的,达到目前工业化生产胡瓜钝绥螨质量检测自动精确计数的要求,具有很好的应用价值。