基于无人机遥感的盛花期薇甘菊监测技术

李岩舟 覃 锋,2 顾渝娟 韩阳春 田洪坤 乔 曦,2

(1.广西大学机械工程学院,南宁 530004;2.中国农业科学院(深圳)农业基因组研究所,深圳 518120;3.广州海关技术中心,广州 510623;4.江阴海关,江阴 214400;5.东北大学机械工程与自动化学院,沈阳 110819)

0 引言

近年来,生物入侵的危害日趋严重[1-2]。外来入侵植物薇甘菊(Mikaniamicrantha)为多年生草本[3-4],主要以攀援缠绕乔灌木植物,重压冠层顶部,阻碍附主植物的光合作用,争取水分与养分的方式造成乔灌木植物的死亡[5-7]。其自1910年蔓延到我国南方,对生态系统造成重大损害[8]。国内外学者对薇甘菊的入侵做了大量的研究,现有的薇甘菊的防治方法包括机械方法、化学方法和生物防治等,但都未能从根本上控制住其蔓延和危害[9-11]。提高薇甘菊监测精度,为薇甘菊防治提供高质量的空间分布信息,是防治薇甘菊的关键手段之一[5-6]。

目前对于薇甘菊的监测仍然采用以人工踏查为主的监测手段[11],人工踏查费时费力,在一些复杂的环境下难以开展监测工作,无法对薇甘菊的分布及危害进行准确的定量评测。随着卫星遥感分辨率提高至亚米级,卫星影像分类技术也开始应用于入侵物种识别[12-18]。无人机遥感系统具有运载便利、灵活性高、作业周期短、影像数据分辨率高等优点,以无人机遥感为工具的生态学研究在近几年呈现出爆发式的增长[19-22]。目前已有使用无人机对薇甘菊进行监测的案例[7,12]。在野外复杂背景下,无人机遥感相比于卫星遥感,更加有利于发现入侵早期的薇甘菊,对薇甘菊的进一步预警和防治更具实际意义。

在图像识别领域,传统的基于色彩空间的图像识别方法具有通用性佳、准确率高、鲁棒性强等优势,能够实现目标的快速识别[23]。聚类分析算法[24]是常用的无监督学习方法,通过迭代的执行,无需进行预先的标注训练,实现对数据分析和分类。深度学习[25-26]通过学习多层非线性网络结构,将原始数据的基本属性转化为更具鲁棒性的抽象特征,大大提高了在复杂环境中的分类精度。在野外复杂背景下,薇甘菊的繁殖多样性以及分布情况复杂,对其进行准确识别难度大。因此,通过对比基于RGB和HSV色彩空间识别算法、K-means聚类算法和MobileNetV3深度学习算法,进一步确定更加适宜薇甘菊识别的算法。

目前气候生态位模型GARP(Genetic algorithm rule-set production)和MaxEnt(Maximum entropy)是外来物种适生区预测研究中应用最为广泛的模型[27-28]。生态位模型通过研究环境因子对生物适生性的影响,得到物种的大尺度分布预测及适生性分析,对生物的防治具有指导意义,但是无法依靠其进行精准防治。在小范围内的环境因子基本相同,因此生态位模型并不适用于小尺度范围的监测预警。近年来,结合层次分析法和模糊理论的集定性分析与定量分析于一体的综合评估数学模型在环境冲突分析中取得了公认的潜力[29-33]。针对外来入侵植物薇甘菊的生态风险源和危害状况,以模糊层次分析法作为生态风险评价方法和综合评估模型有一定的研究意义。

基于以上研究,本文将以无人机搭载的高分辨率相机,获取薇甘菊遥感航拍图像,再用Otsu-K-means、RGB、HSV算法以及K-means-RGB、K-means-HSV、K-means-RGB-HSV融合算法和MobileNetV3深度学习算法对薇甘菊进行识别,以期实现快速、准确地获取薇甘菊所处区域以及分布情况;基于识别结果应用模糊层次分析法以及盖度公式,并针对薇甘菊的生态学特性,研究薇甘菊生态景观参数与危害等级关系模型,初步构建出适合于薇甘菊的评估预警方案,以期为薇甘菊及其他入侵植物监测和早期预警提供理论基础、技术支撑和科学依据。

1 材料和方法

1.1 材料获取与预处理

图像数据采集地点位于广东省广州市从化区海滨大道旁,地理坐标为(23°28′34″N,113°28′45″E)。图像数据采集区域主要为农业用地,该区域蔬菜与荔枝树相间种植,有大量的薇甘菊入侵,同时该区域内有鬼针草等入侵植物。在待监测区域采用大疆经纬600-Pro型无人机搭载尼康D850型套机组成“无人机+可见光相机”的低空遥感系统(表1),无人机摄影高度为30 m,采取等时间2 s间隔,垂直航线摄影,设置航向、旁向重叠度均为70%,获取连续的可见光影像数据,图像数据采集获取区域尺寸约为150 m×150 m。图像采集时间是2018年11月21日至22日11:00—13:00,天气多云。此时薇甘菊正值盛花期,已对该区域的植物生长以及农业生态环境造成明显的损害。

表1 无人机遥感系统参数

采集共获取高分辨率图像429幅,单幅图像分辨率8 256像素×5 504像素。通过Agisoft PhotoScan软件,对采集的原始高分辨率可见光图像进行拼接。对图像进行排列、生成密集点云、网络化和生成纹理4步处理获得待监测区域的数字正射影像,图像尺寸为30 548像素×32 023像素,如图1所示。

图1 研究区域整体图

1.2 薇甘菊的识别方法

1.2.1Otsu-K-means算法

1.2.1.1算法基本原理

K-means算法是基于质心进行,该算法以K为输入参数,把n个对象集合分为K个簇。各簇内的相似度非常高,簇之间的相似度非常低。K-means算法使用的聚类准则函数是误差平方和准则。为了使聚类结果优化,应该使准则JK最小化。JK计算公式为

(1)

式中JK——误差平方和准则

xk——第k个样本

nj——第j簇样本个数

Zj——第j簇对应的中心点

(1)给出n个混合样本,令迭代次数I=1,选取K个初始聚合中心Zj(I)。

(2)计算每个样本与聚合中心的距离:D[xk,Zj(I)](k=1,2,…,n)。

(5)判断:若Zj(I+1)≠Zj(I),则I=I+1,返回步骤(2),否则算法结束。

1.2.1.2识别方案

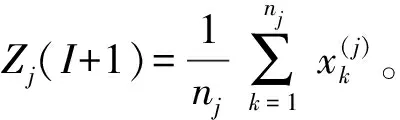

首先对拼接所得图像进行灰度处理,通过Otsu算法自主计算出最佳区域分割阈值T为0.670 6,Otsu算法的核心思想是选定的最佳分割阈值图像的前景与背景的平均灰度差值最大化,这种最大化的差异用各区域的方差来表示。根据所得分割阈值T进行阈值分割,最后执行K-means算法,Otsu-K-means算法执行过程如图2所示。

图2 Otsu-K-means算法执行过程

1.2.2基于RGB、HSV色彩空间识别算法

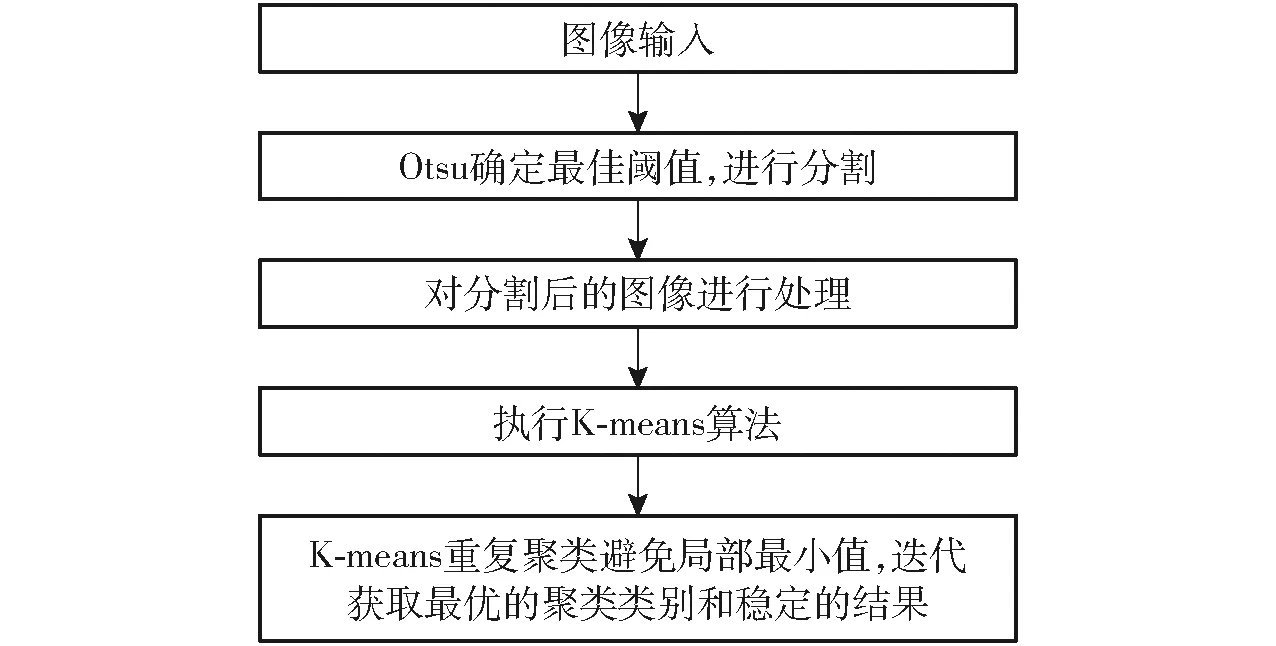

首先建立采样数据集,分别在RGB和HSV色彩空间下的图像中采集,随机抽取图像中的10个部分薇甘菊共计100个像素点对应的三通道值,同时还按相同方法采集了图中的绿色植物、地面、浅色植物各100个像素点,分别计算其对应的平均值、极值、方差、标准差,并进行相关的数值运算与分析。经过对比分析,各个通道的取值范围在平均值±2倍标准差这一范围内时薇甘菊与其他物体有较好的区分度且被遗漏的薇甘菊最少,以此作为对应通道的盛花期薇甘菊识别阈值,如图3所示。

图3 薇甘菊各通道数值分析

1.2.3融合算法

K-means算法和色彩空间阈值分割算法在实际应用中不仅能独立完成图像处理与识别任务,而且其融合算法也被广泛应用。文献[34]提出了一种结合模糊聚类和色彩空间的阴影检测算法,该算法充分结合了RGB和HSV两个色彩空间的特征通道的优势,实现了准确的检测。文献[35]采用无监督学习的方法,研究舌色与疾病的关系。基于K-means算法对舌色进行二维处理,在LAB颜色空间中保留了89.63%的原始信息,提高了可视化程度。文献[36]采用改进的K-means算法在图像颜色空间对其进行分类,以检测水稻叶片上的病斑,算法实现了较高的精度。文献[37]将LAB色彩空间和改进的自适应K-means算法结合,该方法分割效果更好,并能够较好地保留边缘轮廓。在实际应用中,基于K-means和色彩空间阈值分割算法的融合算法解决了更多的问题,相对于独立使用两种算法,融合后的算法更具有潜力和价值。因此本文采用基于K-means算法进行图像分割,再基于分割结果应用色彩空间阈值分割算法进行识别的方案,具体方案如下。

(1)基于K-means算法对整个监测区域图像的分割结果,应用1.2.2节在RGB、HSV色彩空间下设定的识别阈值,即盛花期薇甘菊在各个通道的平均值±2倍标准差,确定K-means-RGB算法和K-means-HSV算法。

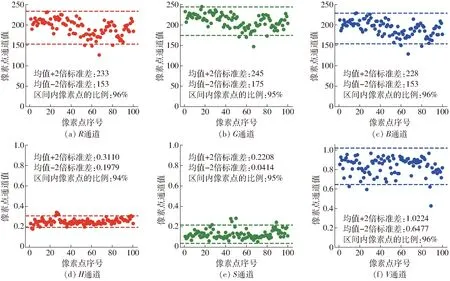

(2)根据K-means-RGB和K-means-HSV色彩空间识别算法的结果,确定K-means-RGB-HSV算法。K-means-RGB和K-means-HSV算法识别结果为二值图,即像素点为1是盛花期薇甘菊;像素点为0是非盛花期薇甘菊,对其分别进行且运算和或运算,确定融合算法。融合后K-means-RGB-HSV算法各个像素点的取值情况如表2所示,取值结果为1时即为盛花期薇甘菊。

表2 K-means-RGB-HSV算法取值

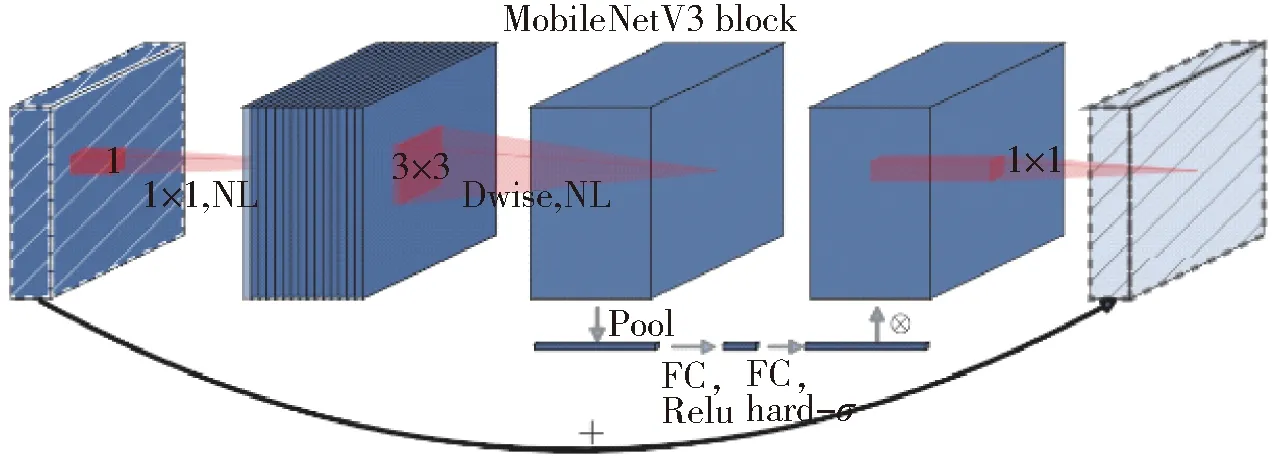

1.2.4基于深度学习的MobileNetV3算法

在基于深度学习的遥感图像处理任务中,选择高精度、计算量少和参数少的骨干网络有助于提高图像处理速度。MobileNetV3是一种轻量级神经网络,它充分结合了MobileNetV1的深度可分离卷积、MobileNetV2的具有线性瓶颈的倒残差结构的优势[38-40]。利用资源受限的平台感知NAS与NetAdapt来搜索网络的配置和参数,引入了轻量级注意力模型SE Block并提出一种在网络越深越能够有效地减少网络参数量的新激活函数h-swish(x),公式为

(2)

在网络最后部分先进行平均池化,再通过1×1卷积抽取用于训练最后分类器的特征,在保留高维特征的前提下进一步减小延时。MobileNetV3网络块结构如图4所示[40]。

图4 MobileNetV3网络块结构

本研究以MobileNetV3-Large模型为基础,根据二分类识别任务对网络最后部分进行修改,最后输出层使用Sigmoid激活函数,从而实现对盛花期的薇甘菊进行识别。首先将正射影像裁剪成128像素×128像素的小图,随机抽取7 000幅小图,挑选出包含薇甘菊的小图1 484幅和背景5 516幅,选取80%作为训练集和20%作为测试集。将数据集的图像尺寸改为224像素×224像素,再进行水平、垂直随机翻转和正则化处理,放入模型中进行训练。深度学习模型搭建平台选择Windows 10下Python 3.8和Pytorch1.8.1框架,设置迭代次数为50次,批次大小为128,初始学习率设置为0.000 5,每迭代10次学习率衰减2/3。经过50次迭代,模型在测试集上的准确率达到95.57%。再将训练好的模型,对研究区域的正射影像进行遍历识别,最终获得整个研究区域的薇甘菊分布图。

2 结果与分析

2.1 算法结果评价标准

为了评价识别算法的性能,应用Photoshop 2019软件对待检测图像人工分割出目标作为真实值,采用召回率R、精确率P和均衡平均数F1值共3个评价指标进行算法实验结果分析。

2.2 融合算法确定

为了确定最终的融合方案,根据1.2.3节中算法的识别结果,绘制混淆矩阵,如图5(图中TP为正确检测到的正类数量,FN为正类被检测成负类的数量,FP为负类被检测成正类的数量,TN为正确检测到的负类数量)所示。可以看出K-means-RGB-HSV-1的TP值大幅减少而TN值增加,说明被正确识别的薇甘菊减少,被正确识别的背景增多;K-means-RGB-HSV-2的TP值明显增多,TN值减少,说明该算法能够更多地识别出薇甘菊,符合实际需求,因而确定最终的融合算法为取或运算的K-means-RGB-HSV-2算法。

图5 模型识别结果混淆矩阵

2.3 算法识别结果对比分析

基于本文提出的算法,对整个监测区域自动识别,经过形态学计算,得到识别结果(图6)。各算法召回率、精确率以及F1值如图7所示。

图6 监测区域各识别结果

图7 各算法的召回率、精确率及F1值

Otsu-K-means算法对于盛花期薇甘菊辨识度强,但识别完整度较低。经过计算该算法召回率为38.73%,精确率为88.90%,F1值为53.95%。RGB(75.62%、72.59%、74.08%)和HSV(80.11%、81.82%、80.95%)算法的识别完整度较高,但识别辨识度较低,主要干扰为土地。基于MobileNetV3的识别算法(92.59%、61.62%、73.99%),因该算法是基于小图像的识别,其召回率较高而识别的精确率较低。K-means-RGB(89.68%、80.11%、84.63%)和K-means-HSV(81.40%、84.56%、82.95%)算法的召回率、精确率以及F1值均在80%以上,进一步提升了盛花期薇甘菊的识别效果。K-means-RGB-HSV算法的召回率为96.70%,相比于其他算法,大大提升了算法对盛花期薇甘菊识别的完整度。其F1值最高(85.29%),识别效果优于其他6种算法。能满足野外复杂环境下盛花期薇甘菊准确识别的要求,实现了在厘米分辨率精度下对盛花期薇甘菊的精准识别,也为进一步进行风险评估提供了保障和支撑。将识别结果标注于整个监测区域原图中,如图8所示。

图8 基于识别结果的标注图

3 薇甘菊监测与预警

3.1 薇甘菊风险评估指标体系构建

入侵物种危害等级评估对于预测和评价外来物种对环境、经济和社会等产生的影响有着重要意义。外来物种在不同生态系统的入侵危害状况有着巨大的差别[30],通过对入侵物种自身生物学特性、生态学特性以及环境因素和人为因素的研究分析,可以实现更加科学的评估。因此必须建立适应本区域的外来植物入侵性风险评估体系,为外来生物入侵的防范和生态安全提供保障[41]。现有的评估方法主要有专家打分法、途径分析法等定性分析方法以及数理统计法、主成分分析法等定量分析方法,然而针对外来入侵生物繁殖能力强、传播能力强以及生态适应能力强等[42]不确定性特点,集定性分析与定量分析于一体的多指标综合评判法显然会更加科学、全面,会更加有优势。文献[43]基于海南生物入侵防控及外来物种管理的需求等现状,构建了适应于海南实际情况的外来植物风险评估模型,该模型依托层次分析法,建立了3级指标体系。文献[44]研究了基于 Copula 模型的水电开发生态系统累积效应环境生态风险评价。从水环境、陆地生态系统和水生生态系统3方面,建立了定量与定性相结合的两阶段模糊综合评价模型,能够提高系统的整体性能。结合层次分析法和模糊理论的集定性分析与定量分析于一体的综合评估数学模型在环境冲突分析中取得了公认的潜力[33]。针对外来入侵植物薇甘菊的生态风险源和危害状况[45],以模糊层次分析法作为生态风险评价方法和综合评估模型有一定的研究意义。

3.1.1模糊评价法

模糊评价法可以将定性评价转化为定量评价,在生态风险评估中,往往存在一些不确定因素导致评估结果的失真,模糊理论可以提高评价结果的可靠性[32]。模糊评价法主要根据模糊数学隶属度理论,应用模糊关系合成的原理,通过多个系统的、全面的指标对评价目标进行科学的、综合的评判。

具体步骤如下:

(1)确定评价对象的因素U,U=(u1,u2,…,un)。

(2)确定评价的评语等级V,V=(v1,v2,…,vn)。

(3)评判单因素,构建模糊关系矩阵

(3)

式中xij——ui对于vj的隶属度

(4)确定评判因素权向量Y=(y1,y2,…,yn)。

(5)将Y与X合成得到B=(b1,b2,…,bm)。

(4)

(6)对B作分析处理,得到模糊综合评价结果。

3.1.2层次分析法

层次分析法(Analytic hierarchy process,AHP)是一种系统、灵活且实用的多准则决策方法。在层次分析法中,问题是由不同层次构成的,包括目标、标准、子标准和备选方案。给定层次结构级别上的元素成对比较,以评估它们相对于下一个更高级别上的每个元素的相对权重[46],通过对决定现象或过程结果的影响因素进行基于矩阵的两两比较,从而产生高质量和精确的决策。

具体步骤如下:

(1)层次结构的建立

在应用AHP决策问题时,构造出一个有层次的结构模型是重要的前提。这些层次可以分为目标层、准则层以及措施层3个层次,由于层次数是围绕着问题复杂度来设定的,在实际使用中层次数不受限制。

(2)判断矩阵的构造

(3)层次单排序及一致性检验

层次单排序是指同层次因素对于上一层某一因素相对重要性排序权值,判断矩阵A的特征值和特征向量。公式为

AW=λmaxW

(5)

式中W——特征向量

λmax——最大特征值

最大特征值λmax及其特征向量W所有分量均为正实数。判断矩阵的质量需要进行一致性检查,判断矩阵中各指标需要满足

(6)

计算一致性指标,检验判断矩阵的一致性。

一致性指标计算公式为

(7)

一致性比例计算公式为

(8)

式中RI——平均随机一致性指标

当CR<0.10时,判断矩阵的一致性检验通过。

(4)层次总排序及一致性检验

对于层次总排序需要进行一致性检验,设B层对上层(A层)中因素A(j)(j=1,2,…,m)的层次单排序一致性检验指标为CI(j),相应的平均随机一致性指标为RI(j),则B层的总排序随机一致性比例为

(9)

当CR<0.10时,层次总排序一致性通过,并接受该分析结果。

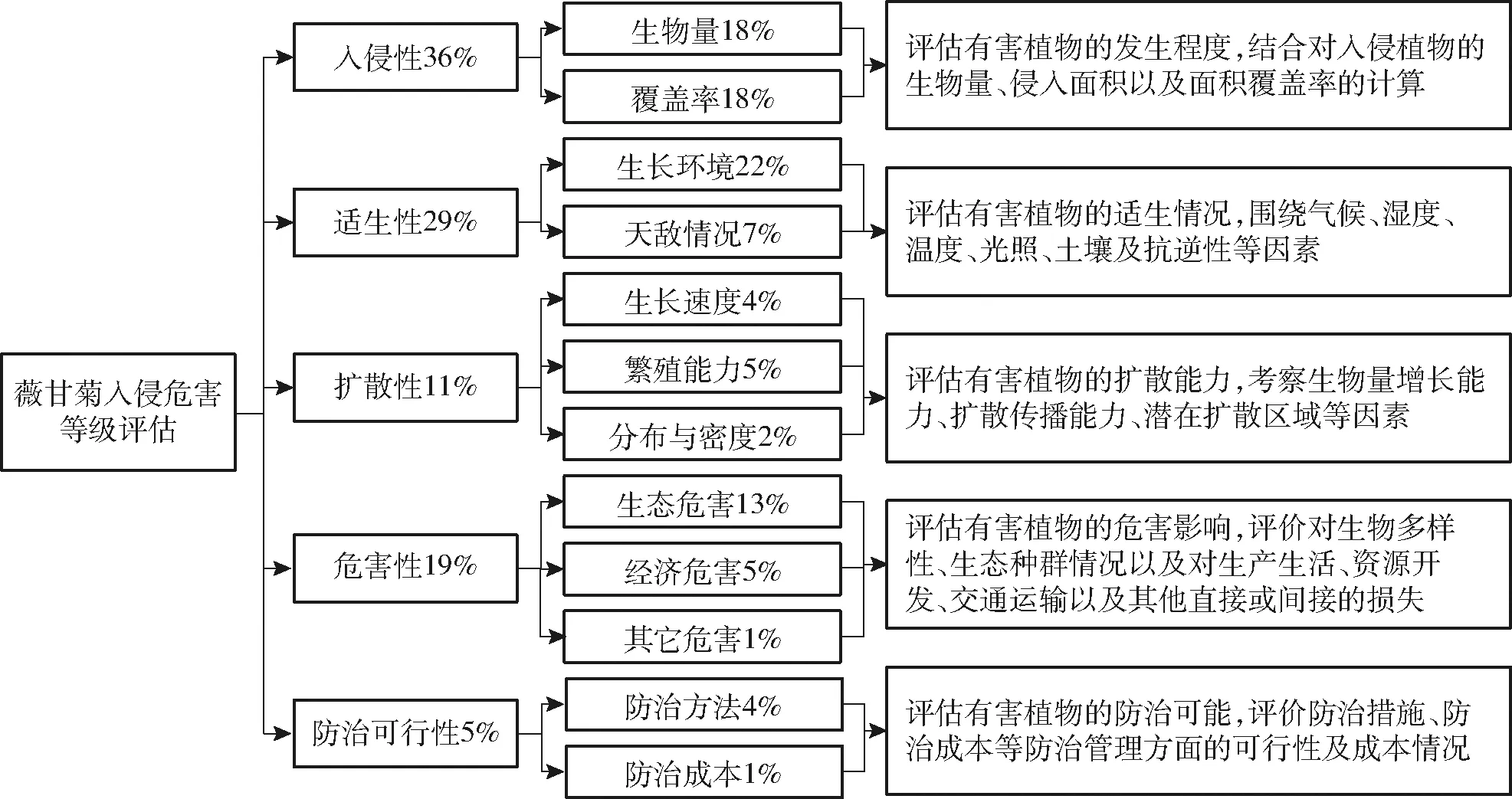

3.1.3风险评估指标体系构建

采用文献调查和专家咨询方法,构建薇甘菊风险评估指标体系。指标体系由5个二级指标和12个三级指标组成。运用模糊理论和层次分析法对各级指标赋予了一定的权重,确定薇甘菊风险评估指标体系以及权重,如图9所示。

图9 薇甘菊危害等级评价层次结构模型

评估体系的第1级指标,即目标层是薇甘菊入侵危害等级评估,是最终风险评级达到的目的;研究的第2级指标,即准则层是由5个主要评价因素构成,分别是入侵性、适生性、扩散性、危害性以及防治可行性,该评价因素是通过对薇甘菊的生物特性、生态环境及人文社会多因素综合考究设定的。研究的第3级指标,由隶属于准则层的12个具体的影响因子构成。这些影响因子是对准则中5项指标的细化,为整个模糊综合评价系统的实施提供支撑,不仅有助于定性模糊复杂问题,还可使定量数据化问题更加科学化、简单化以及可行化。

3.2 薇甘菊生物量估算

薇甘菊生物量的估算是薇甘菊危害等级定量评估模型的重要参考依据,其生物量的估算模型主要依托于薇甘菊的生物学、生态学特性,结合不同生境条件下对薇甘菊地上部生物积累量与其附主植物的数值关系来进行计算。

根据2014年云南省农业科学院农业环境资源研究所对异质环境下入侵植物薇甘菊的适生性与繁殖特性调查结果,引用了与本课题监测区域相近经纬度地区的农田用地薇甘菊实验结论。农田生境条件下薇甘菊地上部分生物量积累影响情况参照文献[47]计算,其中薇甘菊总生物量为(13.85±0.88)g,薇甘菊花生物量为(0.68±0.06)g。据此确定了监测区域图像单位像素点的面积为0.23 cm2,单位像素点对应的薇甘菊花生物量和总生物量分别为0.14~0.17 g和2.98~3.39 g。

3.3 薇甘菊盖度计算

薇甘菊主要以攀援缠绕乔灌木植物,重压冠层顶部,阻碍附主植物的光合作用,争取水分与养分的方式造成乔灌木植物的死亡。盖度是样地受侵害植物被薇甘菊藤叶覆盖(投影)面积占样地面积的百分比。由于薇甘菊是通过覆盖附主植物从而危害植物,在小范围内,薇甘菊的生长环境、天敌情况、生长速度等基本相同,所以盖度是衡量薇甘菊对附主植物危害程度的最主要的标度。

根据3.2节可知薇甘菊单位像素点总生物量和单位像素点花生物量,图像识别结果可得薇甘菊的花像素个数以及图像总像素个数,根据计算得出薇甘菊总生物量在图像上的像素值,从而得到薇甘菊的盖度C公式为

(10)

式中M1——薇甘菊单位像素点总生物量

M2——薇甘菊单位像素点花生物量

P1——图像总像素个数

P2——薇甘菊花像素个数

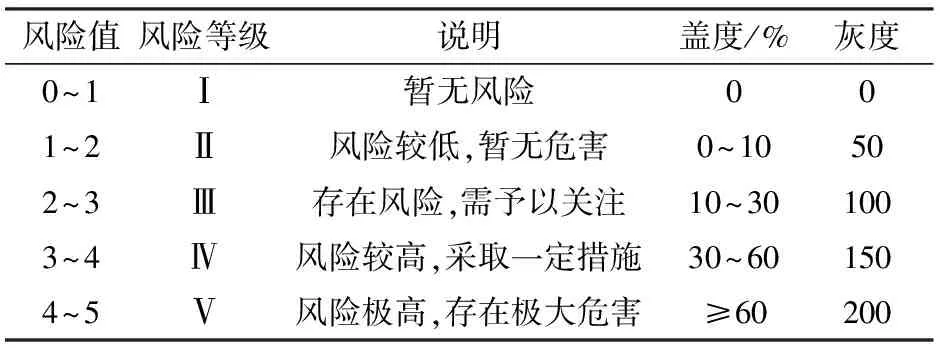

3.4 薇甘菊危害等级划分

参考国内外入侵植物风险分级方法和实际案例,建立薇甘菊入侵风险评测表,共建立5个风险值范围,如表3所示。基于K-means-RGB-HSV算法的识别结果,将整个监测区域划分为不同尺寸的网格,根据盖度计算公式以及5个风险值范围,得出不同危害等级各个网格内的花像素值范围。再计算每个网格内的花像素值,将所得单个网格作为一个像素,其值设置成相应的盖度范围内的灰度。

表3 薇甘菊入侵风险评测标准

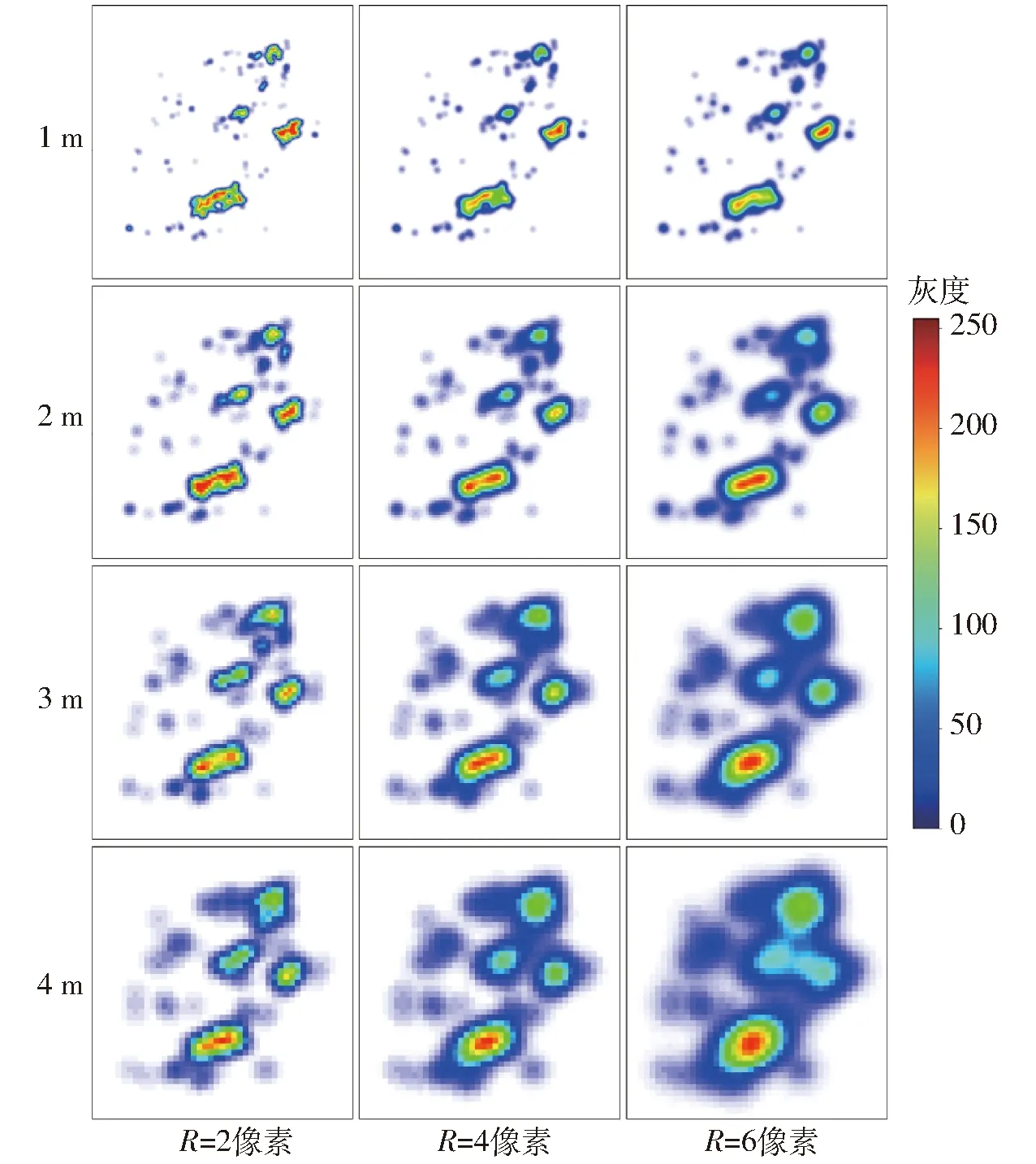

3.5 薇甘菊入侵预警可视化

取出每一个存在薇甘菊的像素点位于图像中的坐标,对各个坐标取辐射半径为R创建一个缓冲区,由中心(中心点灰度)到边界(灰度为0)渐进地填充灰度,对于有缓冲区交叉的区域,可以叠加灰度,绘制热力图。此处的半径是薇甘菊的辐射半径,即出现薇甘菊花的位置,其辐射半径R内都为危害区。选取网格尺寸为1、2、3、4 m,辐射半径R为2、4、6像素,绘制了在不同网格尺寸和辐射半径下的热力图。

从图10中可看出,在相同网格尺寸下,随着辐射半径R的增大,薇甘菊的分布面积迅速增大;在相同辐射半径R下,随着网格尺寸的增大,薇甘菊分布热力图的精度不断下降,同时分布面积也相应有所增加。网格尺寸和辐射半径R的选择,会对结果产生很大影响。网格过大以及半径过大,都会导致监测精度降低。而过小的网格划分以及过小的半径,会占用大量的算力资源,并且容易使得部分实际存在薇甘菊的区域未能得到体现。在实际应用中应综合考量所需精度,以及设备的算力资源,对网格尺寸、半径合理选择。

图10 预警热力图

4 讨论

本文主要基于无人机遥感高分辨率可见光图像,利用Otsu-K-means、RGB、HSV算法以及K-means-RGB、K-means-HSV、K-means-RGB-HSV融合算法和MobileNetV3算法对野外复杂环境下的盛花期薇甘菊精准识别做了初步研究,并对构建盛花期薇甘菊危害等级评估模型做了初步探索。

在识别算法方面,Otsu-K-means算法对薇甘菊的辨识度强,但召回率很低,造成漏识别多,识别效果差。RGB、HSV算法的识别完整度较高,但精确率较低,造成误识别多。从K-means-RGB、K-means-HSV和K-means-RGB-HSV算法的结果可以看出,融合后的算法相较于融合之前均是在精确率稍微降低的前提下,召回率及F1值有较为明显的提升,原因是K-means算法的融入,可以有效减少土地对RGB和HSV算法的干扰,从而提升算法的识别效果。MobileNetV3算法的召回率高,但由于其是针对小图的识别,识别为薇甘菊的小图中,会存在并未充满薇甘菊的情况,因此识别的精确率较低。在本文中识别的对象是入侵物种薇甘菊,防控的需求是在保证一定的识别精度下,尽可能全面地发现薇甘菊,从而降低因漏识别而造成的薇甘菊再次爆发的风险,召回率和精确率都不能单独评估模型的好坏,因此选择综合指标F1值作为最终的评价指标。其中基于K-means-RGB-HSV融合算法的F1值最高,能够满足对盛花期薇甘菊的识别监测需求。

在生态评估方面,基于本文实际监测区域环境状况、监测面积以及监测图像像素,构建了薇甘菊风险评估指标体系,对整个监测区域的薇甘菊生物量和盖度进行了评估计算并划分了不同的危害等级。基于计算结果绘制了不同尺寸网格、不同辐射半径的热力图,建立了在小尺度范围内精准的薇甘菊危害分布热力图。国内外的文献中,对生物入侵的评估方法中,多为大尺度范围内的评估,如生态位模型是对某一国家或地区的层面,利用环境因子对某种生物在该区域的适生性进行预测;层次分析法也是针对某一市级单位,在较大尺度范围内,对各个评估因子进行综合评估,其所使用的评估因子,在小尺度范围内,很难量化,所以并不适用于小尺度范围的预警。本文所建立的小尺度范围的薇甘菊风险评估指标体系,不仅可以清晰地体现薇甘菊的危害情况,而且可以准确地定位薇甘菊入侵的高危区域,实现薇甘菊精准识别监测及风险评估管理的监测机制。

5 结论

(1)Otsu-K-means算法对于盛花期薇甘菊辨识度强,但识别完整度较低,最佳分割阈值T为0.670 6,在进行聚类时,K值取2及以上时可以有效区分盛花期薇甘菊。RGB和HSV算法的识别完整度较高,但识别辨识度较低,设定各个通道的取值范围在取样平均值±2倍标准差作为阈值,可以使薇甘菊与其他物体有较好的区分度且被遗漏的薇甘菊最少。本文深度学习算法是基于小图的分类识别,算法的召回率为92.59%,而识别的精确率低。

(2)K-means-RGB和K-means-HSV算法的召回率、精确率以及F1值均在80%以上,进一步提升了盛花期薇甘菊的识别效果。K-means-RGB-HSV算法的的召回率为96.70%,相比于其他算法,大大提升了算法对盛花期薇甘菊识别的完整度。其F1值最高(85.29%),识别效果优于其他6种算法,能满足野外复杂环境下盛花期薇甘菊准确识别的要求,实现了在厘米分辨率精度下对盛花期薇甘菊的精准识别,也可为进一步进行风险评估提供保障和支撑。

(3)基于本课题实际监测区域环境状况、监测面积以及监测图像像素,构建了薇甘菊生物量估算模型,确定了研究区域图像单位像素点对应的薇甘菊花生物量为0.14~0.17 g,单位像素点对应的薇甘菊总生物量为2.98~3.39 g。薇甘菊入侵预警的可视化,选择过大的网格尺寸和辐射半径,会导致薇甘菊的监测精度降低。过小的网格尺寸和辐射半径会占用大量计算资源,在实际应用中应根据所需精度、算力支持综合选取。绘制所得热力图边缘过渡平滑,形成了闭合的危害区域,能更好地定位薇甘菊入侵的高危区域。