一种基于深度神经网络的腕臂底座开口销缺失检测算法

李 健,王政彤

0 引言

接触网系统部件种类数量多且复杂,若发生故障会对铁路安全运行造成巨大威胁。在“接触网悬挂状态检测监测装置(4C)”系统中,安装在车顶的高清摄像机对接触网设备进行图像采集,并根据相机安装角度的不同将拍摄到的平腕臂、斜腕臂、承力索座、定位线夹、定位器、吊柱座、附加悬挂设备等特定部件图像及全景图像存储到硬盘中,数据分析人员可通过查看图像分析缺陷[1]。接触网故障检测工作耗时费力,若单纯依靠人工查看分析,检测周期长、工作量大,且存在漏检风险[2]。近几年,随着深度学习技术的快速发展,智能识别已逐渐应用于接触网缺陷检测,研究4C智能识别对接触网缺陷分析具有重要意义。

1 检测算法流程

目前,许多图像处理方法已应用于接触网悬挂 状态的自动检测。文献[3]阐述利用LBP(Local Binary Pattern,局部二值模式)与HOG(Histogram of Oriented Gradient,方向梯度直方图)作为融合特征,通过训练SVM(Support Vector Machine,支持向量机)分类器对接触网旋转双耳开口销缺失进行检测;文献[4]主要探讨利用HOG特征和SVM分类器对线夹部件缺陷进行检测。传统图像处理方式对接触网缺陷具备一定的检测能力,但准确率仍有待提高。随着深度学习技术的不断发展,一些基于深度学习的检测方法已开始应用于接触网缺陷识别检测中。文献[5]阐述利用目标检测算法SSD(Single Shot MultiBox Detector)和特征提取网络Mobile Net,首先对接触网关键区域进行初定位,然后采用Mask R-CNN(Region-CNN)目标分割方法对螺母部件进行精确定位,最后利用精确定位图中的螺母与开口销面积比例判断螺母开口销是否缺失,该方法可对关键部位螺母开口销缺失进行检测,但通用性有待提高。

YOLO(You Only Look Once)检测算法由Joseph Redmon等人于2015年提出[6],是一种one stage(一级)的目标检测算法,其仅仅使用一个CNN网络直接预测不同目标的类别与位置。YOLOv3[7]是该系列目标检测算法中的第3版,相比之前的YOLOv1和YOLOv2[8],其检测精度有显著提升,尤其是针对小目标。YOLO网络是基于回归的目标检测网络,YOLO的CNN网格将输入图像分割成S×S网格,每个单元格负责检测中心点落在该网格内的目标。YOLO使用全连接层得到预测值,每个单元格会预测B个边界框(bounding box)及边界框的置信度,边界框的准确度用预测框与实际框的IOU(Intersection Over Union,交并比)来表征,IOU越大,预测框的准确度越高。

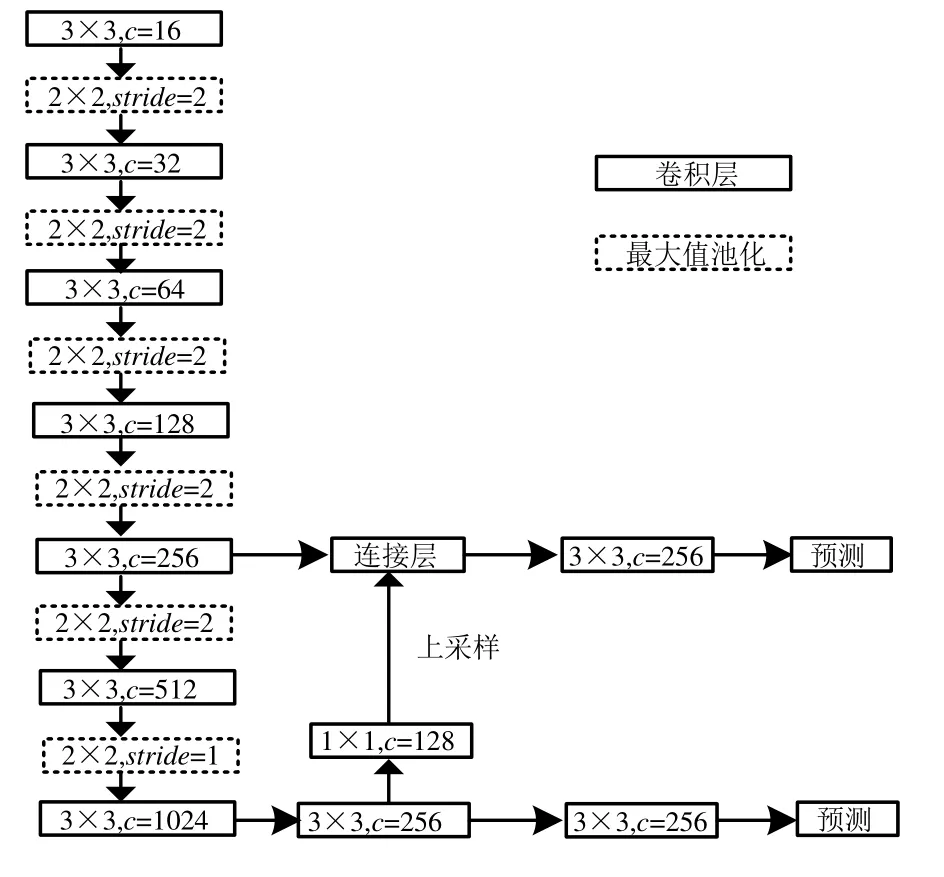

考虑到算法的实时性,本文使用tiny-yolov3网络结构,该网络结构具有网络简单、计算量较小的特点。tiny-yolov3未使用残差层(Residual layer),只使用2个不同尺度的YOLO输出层,其网络结构如图1所示。

图1 tiny-yolov3网络结构

其中,c代表通道(channel),stride表示步长。主干网络采用一个7层卷积网络+最大池化网络提取特征,还具有2个融合(route)层,第1个route层获取YOLO层的输出,然后对这些输出的特征抽取中间层进行多尺度预测处理,第2个route层再进行多尺度融合处理,最终预测得到检测结果。YOLO-tiny引入了Faster R-CNN中的anchor boxes(先验框)的思想,利用先验框来确定bounding box(边界框)的预测方法见图2。

图2 YOLO算法预测原理

YOLO引入了基于置信度的预测方法,其计算式为

其中:bx、by、bw、bh分别代表bounding box中框的中心坐标及相对宽高;cx、cy表示该网格左上角距离整体图像左上角的相对位置;pw与ph表示先验框的宽高;tx、ty、tw、th是需要通过学习得到的参数,用于预测边框的中心坐标和宽高;σ函数为sigmoid函数,其计算式为

卷积神经网络(Convolutional Neural Network,CNN)避免了对图像的复杂前期预处理,可以直接输入原始图像,目前已在图像分类、目标识别、图像分割等领域广泛应用[9]。在应用YOLO算法经过两级定位得到腕臂底座开口销小图后,可以再应用CNN对小图进行分类识别,判断定位到的开口销小图是否存在缺失,最终输出识别结果。完整的腕臂底座开口销缺失检测流程如图3所示。

图3 腕臂底座开口销缺失检测算法流程

收集嘉峪关供电段4C检测车采集的兰新线上行、兰新高铁下行4C数据,腕臂底座开口销区域一级定位标记区域如图4所示。

图4 平腕臂和斜腕臂底座开口销区域 一级定位标注示意图

采用LabelImg工具标注图像,得到已标记的图像2 000张作为一级定位训练样本,如图5所示。

图5 腕臂底座一级定位训练样本

YOLO是基于Darknet框架的实时目标检测系统,Darknet是一个轻型的完全基于C语言与CUDA平台的开源深度学习框架。使用Darknet开源框架进行模型的训练,训练模型使用的硬件和操作系统平台信息如表1所示。Tiny_YOLOv3网络的训练配置信息如表2所示。

表1 训练模型硬件和操作系统平台信息

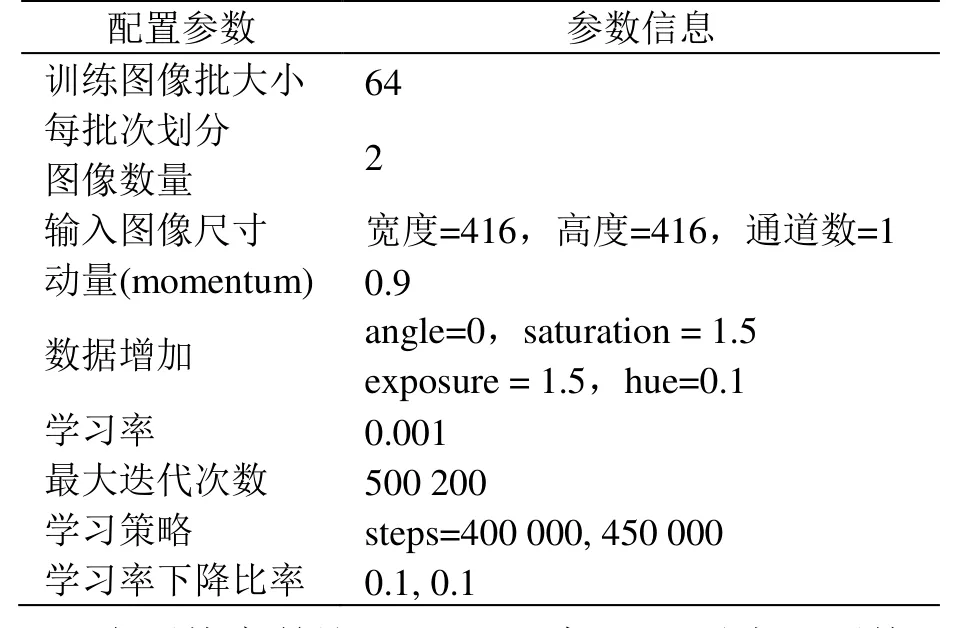

表2 Tiny_YOLOv3网络的训练配置信息

当平均交并比Avg_IOU在0.85以上且平均召回率(Avg_Recall)在0.98以上时,说明训练得到的模型较好。Avg_Recall定义如下:

其中,TruePositive代表正类被判定为正类的数量,FalseNegative代表正类被判定为负类的数量。

Avg_IOU定义如下:

其中:AreaofOverlap代表真实框(truth ground box)与预测框(bounding box)的区域交集,AreaofUnion代表truth ground box与bounding box的区域并集。

训练后得到的.weight文件作为YOLO定位模型,然后加载此模型得到一级定位区域及二级标注图(图6)。

图6 平腕臂和斜腕臂底座一级定位和二级标注区域

训练二级定位YOLO模型,用二级定位模型定位得到了横向和垂直方向开口销如图7所示。

图7 定位得到腕臂底座横向和垂直方向开口销

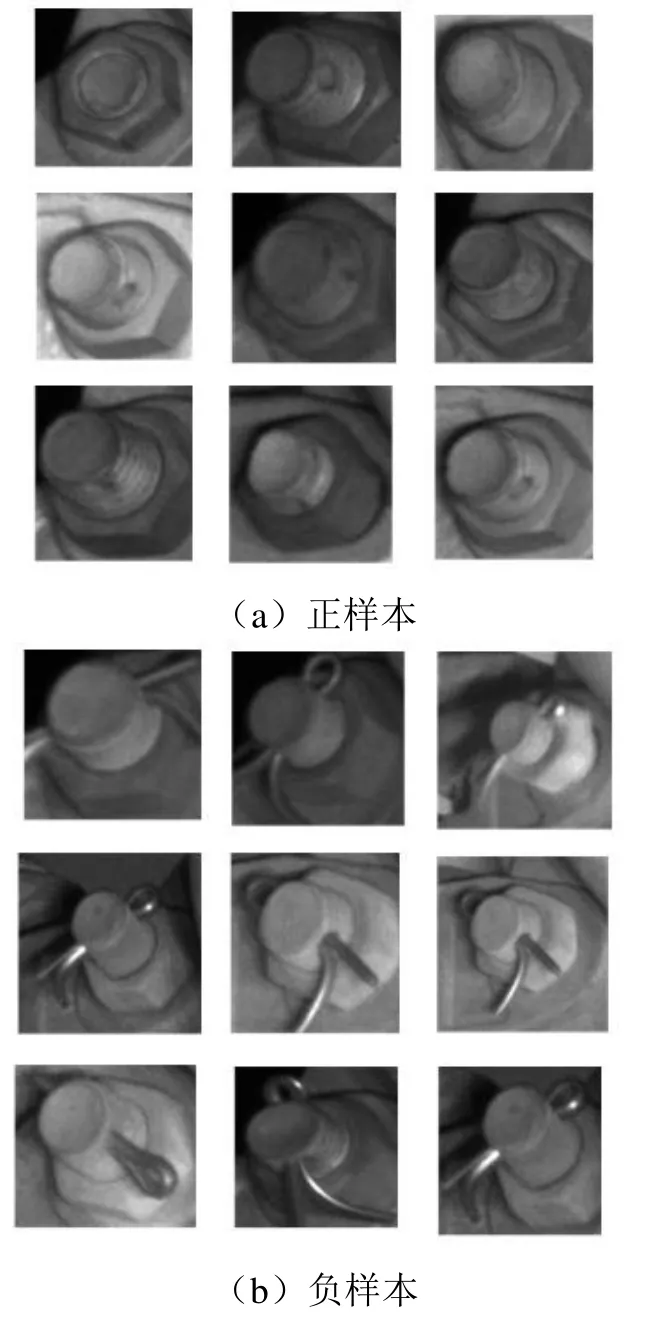

由于平腕臂底座和斜腕臂底座横向开口销以及垂直开口销小图相似,只需要将平腕臂底座和斜腕臂底座开口销小图收集在一起作为训练样本即可。收集腕臂底座横向开口销缺失正负样本,其中正样本3 600张,负样本6 000张,如图8所示。

图8 腕臂底座横向开口销缺失样本

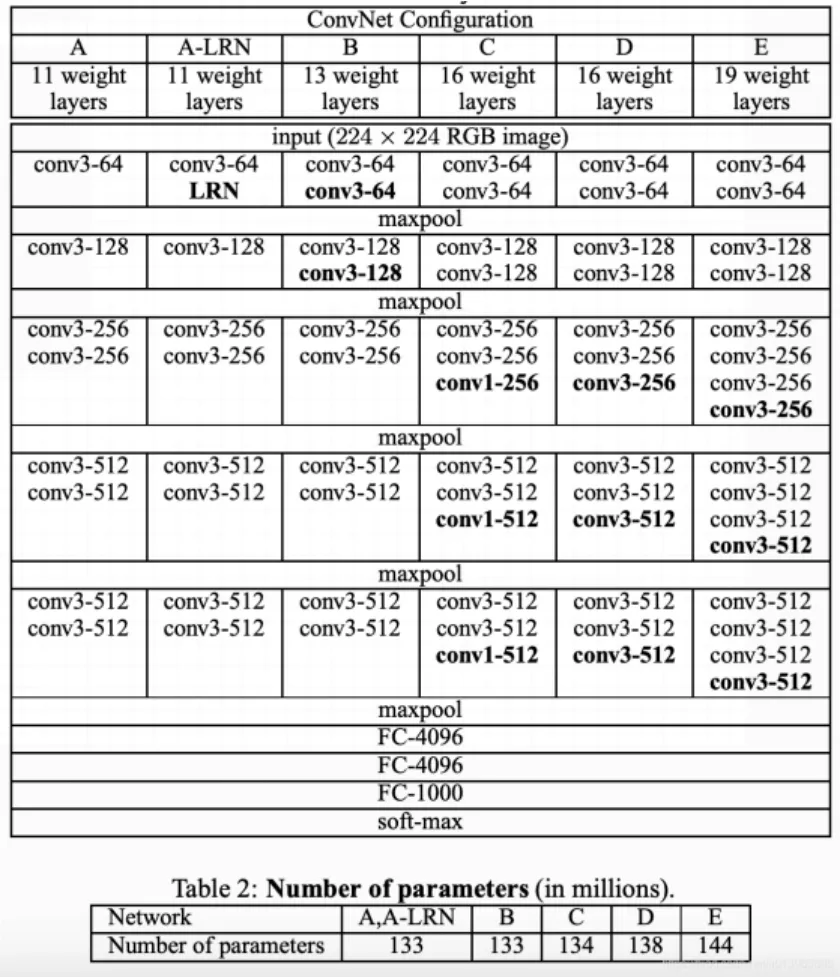

按照2类训练CNN识别模型,采用的网络为VGGNet网络结构[10],如图9所示。

图9 VGGNet网络结构

VGGNet使用多个较小卷积核(3×3)的卷积层代替一个卷积核较大的卷积层,网络拟合能力增强,且结构简洁、层次更深、特征图更宽。

收集腕臂底座垂直开口销缺失正负样本,其中,负样本6 000张,正样本由于实际缺陷较少,经过样本增强拓展样本至3 000张组成正负样本集,如图10所示。

图10 腕臂底座垂直开口销缺失样本

按照2类训练腕臂底座垂直开口销缺失CNN识别模型。这样,在输入一张原始大图时,在加载一二级YOLO定位模型和CNN分类模型后,可以完成对腕臂底座开口销缺失的缺陷检测。

2 实验测试分析

实验过程中先使用6C数据判别分析软件加载嘉峪关供电段分析人员已分析完毕的各线路4C数据,然后打开腕臂底座开口销缺失检测算法,测试算法对线路实际腕臂底座(包含平腕臂底座和斜腕臂底座)横向销钉缺失开口销、垂直销钉缺失开口销两种缺陷进行识别,最后统计算法识别准确率和漏检率,并对算法误识别数量进行统计。其中,腕臂底座开口销缺失的总缺陷数量已知,准确率定义如下:

智能识别中漏检率定义式如下:

其中:Num1表示算法找到缺陷数量,Num_all表示总缺陷数量,Num2表示漏检数量。

腕臂底座横向销钉缺失开口销识别结果统计如表3所示,腕臂底座垂直销钉缺失开口销识别结果统计如表4所示。

表3 腕臂底座横向销钉缺失开口销识别结果

表4 腕臂底座垂直销钉缺失开口销识别结果

此外,算法测试结果中3条线路腕臂底座横向销钉缺失开口销一共识别出缺陷图片74张,其中25张为误识别。腕臂底座垂直销钉缺失开口销一共识别出缺陷图片23张,其中11张为误识别。其中,软件得到的斜腕臂底座开口销缺失误识别多为开口销颜色与其背景色相差较小且背景模糊导致。但总体来看误识别数量较少,在6C判别软件中查看分析时可以快速完成,提高了工作效率。

3 结语

从测试结果可以看出,本文提出的基于深度神经网络的腕臂底座开口销缺失检测算法检测准确率高、漏检率低,且误识别数量较少,说明该算法对腕臂底座开口销缺失具有较好的检测性能。后续可采用超分辨率算法对较模糊的小图进行处理,使小图变清晰后再进行CNN识别,且结合腕臂底座开口销其他图像特征滤除误识别小图,进一步优化腕臂底座开口销识别算法。