基于图推理的人脸遮挡检测方法研究

司春晖,张丽红

(山西大学 物理电子工程学院,山西 太原 030006)

0 引 言

人脸识别具有图像获取途径简单、成本较低、身份鉴定的过程中完全不需要接触目标等优点,应用范围越来越广.但实际人脸识别系统的图像采集过程中往往存在光照、姿态、遮挡等不确定性因素,其中,遮挡因素占比重很大,而传统的人脸识别方法对其识别效果不佳,如何有效地处理遮挡问题并提高识别效率仍是人脸识别系统中的难点之一.

为了解决人脸遮挡的问题,Wu等人[1]提出一种基于自适应无监督学习模型和注意力学习模型的遮挡人脸识别算法,对深度人脸特征进行自适应学习,在遮挡面部的无监督学习领域取得了优良的识别率和准确率;为充分考虑遮挡的空间局部连续性,Wei等人[2]提出一种基于有监督遮挡字典的遮挡结构稀疏性人脸识别方法;Zhu等人[3]提出一种自适应的稳定人脸特征检测,用于遮挡人脸识别,利用几何注意知识蒸馏的方法进行低秩学习,在野外具备良好的鲁棒性.但是这些方法均需要建立字典,并且需要庞大的数据支撑,而且在识别时并不能完全排除遮挡物的影响,由此会使识别率降低.

目前,国内外在解决人脸遮挡问题方面,大都基于卷积神经网络(Convolutional Neural Networks, CNN)方法[4],通过不断卷积提取高层次信息,在识别过程中尽可能忽略掉遮挡的影响[4].但是随着遮挡场景越来越复杂,卷积层数越来越多,对研究人员以及设备的要求越来越高,单靠卷积神经网络已经不能满足遮挡人脸的高识别率要求.

本文受到文献[5]中非局部神经网络以及文献[6]中图网络用于计算机视觉的启发,提出一种应用图推理和局部分割方法对人脸遮挡位置进行检测的网络,并在相关数据集上得到了优良的实验结果.

1 系统框架

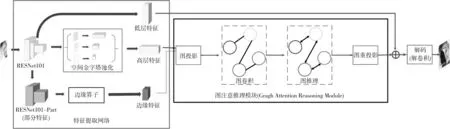

基于图推理的人脸遮挡检测网络的整体架构如图1所示,整个框架分为特征提取网络和图注意推理模块两个部分.特征提取网络利用残差网络ResNet101模型进行初步特征提取,得到低层特征,取第1,第2,第4卷积层的输出作为边缘特征,利用空间金字塔池化进行高层特征的映射,最终得到人脸低层特征、含有遮挡信息的高层特征和边缘特征;图注意推理模块运用非局部操作对高层特征和边缘特征进行投影计算,通过图卷积推理各节点之间的关系,最终确定遮挡特征,并将其映射回原来的特征与低层特征进行相加,得到含有遮挡部分的人脸特征向量,利用解卷积输出,最终得到的含有遮挡部分掩膜的人脸图片并检测出遮挡部分.

图 1 基于图推理的人脸遮挡检测网络模型结构

2 特征提取网络

检测人脸遮挡,首先需要获得人脸的低层特征和高层特征,利用残差网络和空间金字塔池化来进行高低层以及边缘特征的提取.残差网络能够较好地防止过拟合等问题,并且可以在训练过程中提取边缘特征;空间金字塔池化可以提取出高层特征信息.所以本文将两种方法结合应用于特征提取网络.

2.1 残差神经网络

残差网络(Residual Network,Resnet)是何凯明等人在2015年提出的卷积神经网络[7],解决了3个主要问题:①计算资源的消耗问题②神经网络训练过拟合问题③梯度消失以及梯度爆炸问题.

残差块的具体结构如图 2 所示.在残差网络中,残差块应用于卷积神经网络的每一层,增加网络深度的同时使网络收敛速度加快,残差块可以表示为

xl+1=xl+F(xl,Wl),

(1)

式中:xl是输入;xl+1是输出;F是残差部分函数;Wl是卷积的权重.

残差表示为预测值与实际值之间的差值,在残差网络中,主要体现在残差块中输入和输出的恒等映射,输入x经过卷积运算和激活函数得到残差,通过训练得到的残差不仅能够增加网络深度还可以使网络不产生梯度爆炸,增加了整个网络的稳定性.

图 2 残差块的结构

本文利用残差网络Resnet101提取人脸的低层特征信息和边缘特征信息,网络的第1,第2,第4卷积层主要提取图像梯度变化率高的特征信息,所以,用于提取边缘信息特征,对提取出来的部分特征进行边缘算子的运算,结果作为输入图像的边缘特征.

2.2 空间金字塔池化

在一般的CNN结构中,卷积层后面通常连接着全连接层.而全连接层的特征数是固定的,所以,在网络输入的时候,要求输入图像为固定尺寸.但在实际中,图像尺寸不能总是满足网络的输入要求.一般采用裁剪和拉伸的方法进行预处理,但是会丢失部分原始图像信息,使最后结果受到影响.

空间金字塔池化(Spatial Pyramid Pooling,SPP)较好地解决了上述问题[8]:首先,无论输入图像尺寸多大,SPP都可以产生固定大小的输出,这样提高图像尺度不变性的同时有效地降低了过拟合;再者,SPP支持不同尺寸的图片以及窗口,本文所用的SPP 3个窗口分别为1*1,2*2和 4*4,尺寸最小的窗口提取的信息量最小,反之则信息量最大.实验表明训练图像尺寸的多样性比单一尺寸的训练图像更容易使网络收敛,SPP在提取高层信息特征的同时,大大提高了网络的训练速度以及图像检测的准确性.空间金字塔池化网络结构如图 3 所示.

图 3 空间金字塔池化网络

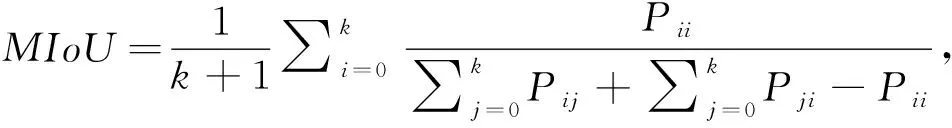

3 图注意推理模块

图注意推理模块(Graph Attention Reasoning Module, GARM)应用非局部操作的方法将图片的高层特征映射到图节点上,通过图卷积的方法推理图节点位置特征之间的关系,最后利用图重投影将节点位置特征映射回高层特征,以确定遮挡的具体位置.GARM的整体网络结构如图 4 所示.

图 4 GARM网络结构

3.1 图投影

图投影是将输入的特征X映射到图特征空间G(V)中,V为节点.具体来说,图投影部分将具有相似特征的像素分配给同一节点,其中就包含遮挡部分的高层像素特征,利用非局部操作将像素投影到节点,非局部操作具体可以表示为

(2)

式中:y是输出信号,尺寸和x相同;f用于计算输入信号x中所有位置的成对关系,f值越小,代表j对i位置影响越小;g(xj)用于计算输入信号在j处的特征值;C(x)是归一化参数.

在g是线性的情况下,f近似为高斯函数.

f(xi,xj)=eθ(xi)Τφ(xj),

(3)

式中:θ(xi)=Wθxi;φ(xj)=Wφxj;Wθ,Wφ均为权重向量.

若给定i,即变成计算所有j位置的softmax函数

(4)

类似地,如图 4 中图投影部分,提出一种融入边缘注意力机制的图投影方法,先对高层特征进行平均池化(卷积核尺寸为6*6)并计算其与边缘的关系,将高层特征X通过非局部操作映射到以边缘特征Y为先验的节点特征,将其作为最终投影矩阵H

H=softmax(P(φ(X)·Y)·φ(X)T),

(5)

式中:P为平均池化操作;φ为1*1卷积操作.

3.2 图推理

(6)

式中:d为输入特征数;V为节点数量,zk∈Z,ωk∈W,σk∈∑.

计算邻接矩阵和总的节点特征分别作为节点特征的位置关系权重和总的特征关系

Δ=ZTZ,HG=Hθ(x),

(7)

式中:Δ为邻接矩阵;HG为总的节点特征,θ为 1*1卷积操作.

将图卷积网络(Graph Convolutional Network, GCN)与图推理相结合,如图 4 的图推理部分,通过图卷积建立节点之间联通性关系,对遮挡位置与其他位置的关系进行推理,采用RELU激活函数进行推理表示

(8)

3.3 图重投影

将投影矩阵转置与推理模块的输出相乘,将推理到的遮挡部分特征映射回原特征

(9)

式中:τ是1*1卷积运算;A是带有表征遮挡部分的人脸特征向量.

4 实验与结果分析

4.1 数据集

实验采用Helen数据集和LaPa数据集.Helen 数据集是用于人脸分割的数据集[9],用于训练图推理网络,其中包括2 330幅人脸图像,11类人脸特征标签:背景、皮肤、左/右眉、左/右眼、上/下唇、内口和头发,其中训练和测试样本的数量分别为 2 000和330.LaPa数据集是一个新发布的具有挑战性的人脸分割数据集[10],主要用其进行测试,LaPa数据集和Helen数据集一样,包含11个人脸标签,涵盖了面部姿态和遮挡的变化.由18 176张训练图像、2 000张验证图像和2 000张测试图像组成.

4.2 评价指标

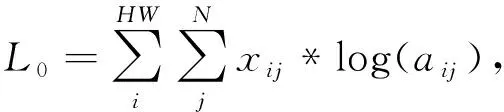

训练网络采用端到端的训练方法,由于网络包含3类网络,在进行回归分类时,预测值和真值总有偏差.所以我们的损失函数包含3个部分:①残差网络的回归交叉熵损失L0;②边缘注意损失Le;③图卷积产生的节点回归损失LG,表达式为

L=L0+Le+LG,

(10)

(11)

(12)

(13)

式(11)中,HW是输入图片的尺寸;i是像素的索引;j是类别的索引;N是类别的数目;xij是i像素j类别对应的神经元真值;aij是预测的值.式(12)中,vij是i像素j类别对应的边缘真值;yij是预测的边缘值.式(13)中,[]是艾弗森括号,如果方括号内的条件满足则为1,不满足则为0;ei是边缘标签;zij是真实的标签;pij是预测的标签.

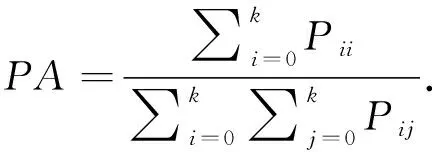

最终实验结果用像素精度(Pixel Accuracy,PA)、平均像素准确率(Mean Pixel Accuracy,MPA)以及平均交并比(Mean Intersection over Union,MIoU) 3个指标衡量.

像素精度是被分类正确的像素占总像素的比例,表达式为

(14)

平均像素准确率是计算每个类内被正确分类像素数比例后,求所有类的平均,表达式为

(15)

平均交并比是计算真实值和预测值两个集合的交集和并集之比,表达式为

(16)

式中:Pij表示真实值为i,被预测为j的像素数量;k+1是类别个数(包含空类);Pii是真实的像素数量.

4.3 实验结果与分析

对特征提取-图卷积推理网络(ResNet101+GARM)进行了训练和测试,实验测试时输入图片均为尺寸为473*473的有遮挡人脸图片,批量处理的尺寸为4,迭代次数为80次,初始学习率为0.01,权重衰减为0.000 5.本文设计的基于图卷积推理网络的人脸遮挡位置检测网络运行的部分结果如图5所示;与其它先进模型的综合结果对比如表 1 所示.

图 5 遮挡检测网络运行结果展示图

由图5的实验结果可以看出,对于输入只含有遮挡类型噪声的图片,本文网络可以精确对遮挡区域分配像素并绘制掩膜,遮挡像素已知图片的人脸检测效率会大幅度提高.

和国内外其他先进模型相比,本文所设计的Resnet101+GARM准确率与IoU评分显著提升,像素精度达到97.11%,与CNN+RNN模型相比提高6.11%,与CNN+RoI Tanh-warping模型相比提高0.31%,其他人脸位置遮挡检测效果也优于其他模型.

表 1 本文方法与其他模型的评价指标比较

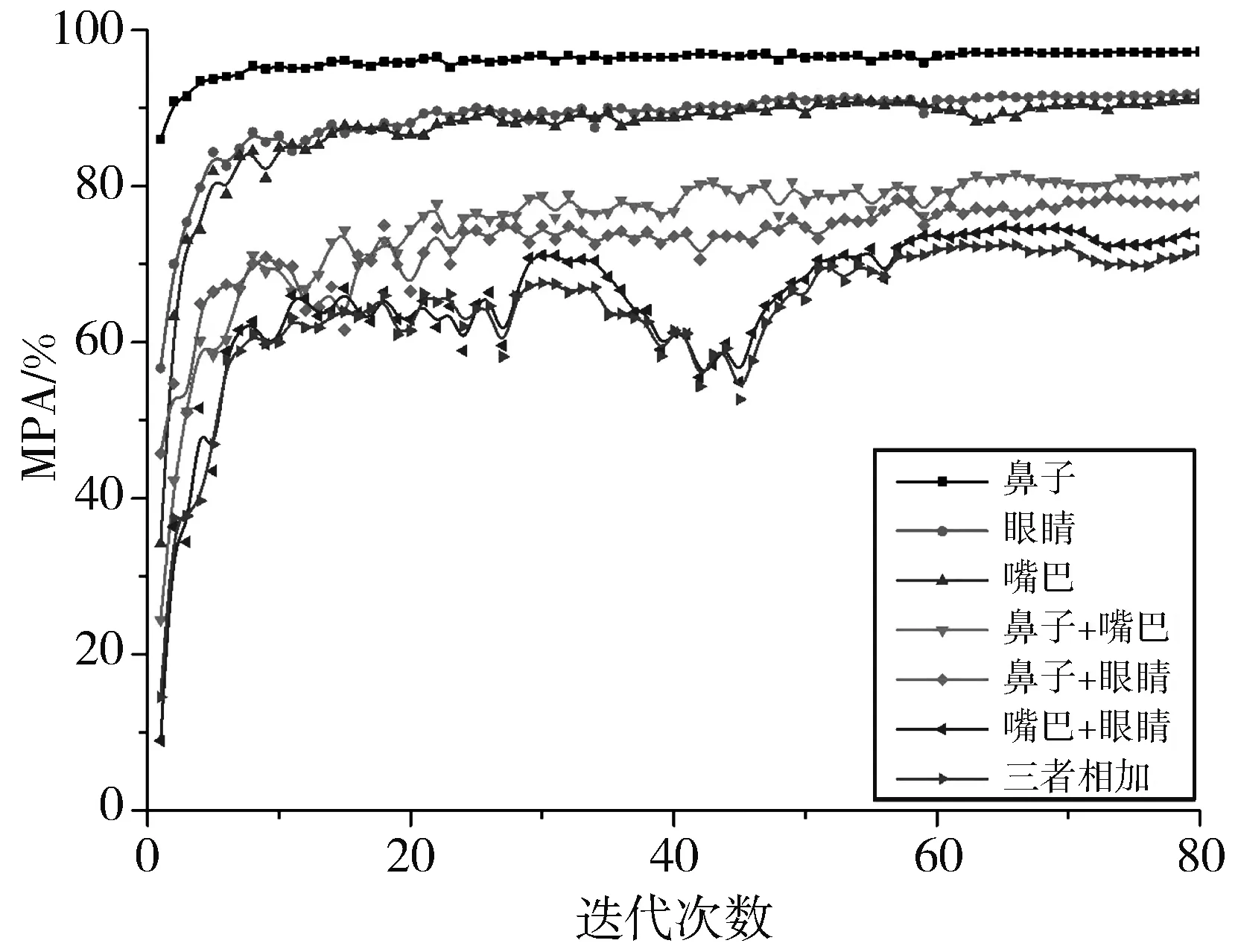

本文设计的网络对人脸各部位遮挡检测的训练准确率如图 6 所示.

图 6 本文模型在各种人脸遮挡类型上的MPA

图 6 结果表明,对于复杂的遮挡情况,模型的准确率会下降10%左右,对于极端的遮挡,分割检测精度最低为71.82%,图推理网络结构和残差网络部分还有很大的优化空间.

PA,MPA,MIoU在训练迭代过程中的变化如图 7 所示.由图 7 可以看到,在训练迭代大约60次之后,分割检测精度逐渐趋于稳定.训练好的网络准确率基本稳定在97%左右,模型具有良好的学习性能.

图 7 各评价指标在训练过程中的变化

网络训练时的损失函数曲线如图 8 所示.损失函数随迭代次数的增加而下降为3.5,此时学习率为4.78e-5,网络收敛.

图 8 网络训练时的损失函数曲线

5 结束语

本文设计了一种基于图卷积推理网络的人脸遮挡位置检测网络,首先经过特征提取网络进行高低层特征以及边缘特征的提取,然后通过图推理网络分析可能遮挡的区域,并为可能遮挡区域分配像素并进行检测,最终确定人脸遮挡位置.实验结果表明,基于图卷积推理网络的人脸遮挡位置检测网络的分割精度和检测精度均优于其他遮挡检测网络.