一种自我正则映射的弱光图像增强方法

张华成,刘朝倩,胡建斌

(1.桂林电子科技大学 计算机与信息安全学院,广西 桂林 541004;2.广西中烟工业有限责任公司,南宁 530001)

0 引 言

在弱光条件下拍摄的图像通常会出现对比度低、 能见度差和ISO噪点高等问题。这些问题不仅严重影响了图像的实用性, 也降低了众多计算机视觉算法的可靠性。为了解决这些问题, 从直方图均衡化[1]到基于学习的方法[2], 已经提出了大量的算法。在早期的弱光图像的增强方法中, 往往会出现颜色失真、 细节丢失等问题。Iqbal等[3]虽然保留了图像的对比度, 但还是会出现上述问题, 并且Wang等[4]和Fu等[5]提出的方法无法增强图像中的暗区, 视觉效果较差。

基于深度学习的大多数方法都严重依赖成对图像训练网络模型, 比如多曝光序列图像[6]、 超分辨率[7]、 去噪[8]和去模糊[9]。当它们在没有成对的训练集的情况下就失去了原本的优势。到目前为止, 有几种低亮度和正常亮度的成对图像数据集, 然而它们都不是最真实的, 也不容易被扩展。Wei等[10]在亮度正常减少相机曝光时间获取的数据集以及Chen等[11]在亮度差条件下增加曝光时间获得的图像对数据集都不是最真实的。LOL数据集是唯一一个从真实场景中获取的低亮度和正常亮度图像对的数据集, 但它仍然可能偏离自然的低亮度和正常亮度图像之间的真实映射, 也可能会因局部区域曝光过度或不足而出现伪影[10]。

在实际中获取成对的训练图像是非常困难的, 尤其是涉及不受控制的场景, 例如除雾、 弱光增强等场景。一方面在同一场景同一时刻拍摄弱光/正常亮度的图像对是不切实际的; 另一方面从多曝光序列图像中合成高质量的图像的方法是可行的, 但合成的结果通常都会失真, 会出现各种伪影和噪声。

虽然Jiang等[12]提出了一种无监督的、 无需成对图像的弱光图像增强方法(EnlightenGAN), 但还是会出现整体和局部过度增强的情况。针对上述问题, 在无法使用成对的训练数据的情况下, 可以利用原始弱光图像的光照条件和灰度图增强过暗区域, 同时也可以抑制亮区域的过度曝光。

因此, 本文基于生成对抗网络(GAN)提出了一种无监督的弱光图像增强方法, 称为SAMGAN。它可以在弱光图像和正常亮度图像之间学习不成对的映射关系, 而无需依赖成对的图像集。它具有成对的生成器和判别器, 但是不像Zhu等[2]的方法使用循环一致性损失。

由于缺乏成对的训练数据, 本文使用了许多创新技术。首先提出一种双重生成器和判别器, 以平衡增强图像中局部和整体的亮度。其次, 由于缺少真实成对的数据监督学习, 使用特征自我保留损失(SFPLoss)限制弱光图像与其增强图像之间的特征空间距离, 同时在彩色图像和灰度图之间使用该损失。最后, 为了实现正则化无监督学习, 在每个深度特征中将弱光图像的照明信息作为自我正则映射。由于无监督的设置, 证明SAMGAN可以增强来自不同领域的真实世界的弱光图像。

SMAGAN具有以下显著的特点:

(1)SAMGAN能够在没有成对数据的情况下训练模型。这种训练方式消除了对成对的训练数据的依赖, 使其适应来自不同领域的弱光图像。

(2)SAMGAN使用双层亮度增强保证机制, 能够平衡局部和整体亮度; 使用自我调节的思想, 既可以通过SFPLoss又可以通过自我正则映射来实现。由于没有成对数据的设置, 没有强大的外部监督的作用, 因此自我规范的机制在模型SAMGAN中起到至关重要的作用。

(3)通过全面的实验, 将SAMGAN与几种具有代表性的方法进行比较。视觉质量、 无参考图像质量评估对比的结果证明了SAMGAN的优越性。 此外, 与现有的成对训练的方法相比, SAMGAN具有简单和灵活的特性, 可用于增强来自不同域的真实世界的弱光图像。

1 SAMGAN

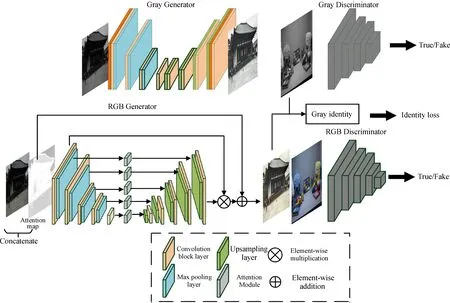

如图1所示, 本文的方法使用带自我正则映射的U-Net[13]作为RGB生成器, 利用双判别器——RGB判别器和灰度判别器矫正图像的亮度信息。此外, 使用自我保留损失来保留和维护原始图像的纹理和结构, 以及灰度一致性函数保证增强图像的局部和整体亮度的协调性。

图1 SMGAN的网络结构Fig.1 Network structure of SMGAN

1.1 带自我映射的U-Net生成器

U-Net[13]是比较早的使用全卷积网络进行语义分割的算法之一, 在语义分割、 图像恢复和增强方面具有很大的影响力。U-Net从不同深度提取不同的特征图, 从而保留了丰富的纹理信息, 并使用多尺度上下文信息合成了高质量的图像。

本文设计了一种易于使用的自我正则映射机制(自我正则映射是一种自我调节的形式, 是一种可以持续改善视觉质量的方法)的生成器, 它能够在空间变化的光照条件下, 增强图像暗区域的同时抑制亮区域的过度曝光。首先提取输入RGB图像的灰度通道I, 将其标准化为[0, 1]; 然后使用1-I (逐元素差)作为自我正则映射; 最后调整自我正则映射的大小以适合每个特征图, 并相乘。

U-Net生成器包含8个卷积块, 每个卷积块都是由2个3×3的卷积层、 LeakyReLu激活层和批归一化层3部分组成。在升采样阶段, 将标准反卷积层替换为一个双线性升采样层加一个卷积层, 以减轻矩形伪像的影响。为了增加生成样本的真实度和质量, SAMGAN参考了LSGAN[14]的对抗损失函数。因此RGB生成器GX和RGB判别器DX的损失函数分别如下:

G(G,D,X,Y)=x~Pdata(x)[(D(G(x)))2];

(1)

D(G,D,X,Y)=y~Pdata(y)[(D(y)-1)2]+

x~Pdata(x)[(D(G(x)))2]。

(2)

1.2 灰度生成器和灰度判别器

使用对抗损失来最小化弱光图像和正常亮度图像之间的空间距离, 也就是实际亮度的分布和正态亮度分布之间的距离。 但是, 仅仅用一个RGB判别器还不能处理空间亮度的变化关系。如果一张弱光图像不仅有暗区域, 还有曝光度强的亮区域, 那么一个RGB判别器也不能很好地处理这种情况。

在同一张弱光图像中, 为了增强暗区域的同时避免亮区域的过度曝光, 本文提出了一个新的双亮度保障机制。在使用RGB生成器、 RGB判别器的同时, 用灰度生成器、 灰度判别器来平衡局部和全局的亮度, 并使用PatchGAN[15]的判别器网络结构作为DX和Dgray主要的网络结构。在DX和Dgray中, 删除所有的批归一化层。为了避免增强的灰度图出现眩晕、 矩阵噪声等现象,Dgray比DX少了特征数为512的卷积层。因此, 灰度生成器Ggray和灰度判别器Dgray的损失函数分别如下

Ggray(Ggray,Dgray,Xgray,Ygray)

=xgray~Pdata(xgray)[(Dgray(Ggray(xgray)))2];

(3)

Dgray(Ggray,Dgray,Xgray,Ygray)

=ygray~Pdata(ygray)[(Dgray(ygray)-1)2]+

xgray~Pdata(xgray)[(Dgray(G(xgray)))2]。

(4)

1.3 灰度一致性损失函数

分别使用RGB生成器和灰度生成器增强RGB图像和灰度图, 因此很容易使得增强的灰度图不一样。如果RGB生成器增强的灰度图质量很好, 而灰度生成器增强的灰度图质量很差, 模型就失去了意义, 无法达到预期的效果。因此, 为了防止出现这种情况, 需要灰度一致性损失函数保证增强的灰度图一致性。将两个增强后的灰度图相减来计算它们的差距, 差距越小, 这两个灰度图就越相似, 这就是灰度一致性损失。

idt(GX,Ggray)=x~Pdata(x)[‖GX(x)gray-Ggray(xgray)‖1]。

(5)

1.4 特征自我保留损失——SFPLoss

在EnlightenGAN[12]中, 特征自我保留损失能够在增强后的图像中保留原始弱光图像的纹理和结构。因此, 为了限制GX(X)与X、Ggray(Xgray)与Xgray之间的VGG特征空间距离, 从EnlightenGAN[12]中引入SFPLoss

(6)

其中:I表示输入的弱光图像;G(I)表示生成器生成的图像;φi, j表示从预训练好的模型VGG-16中提取的特征映射;i表示第i层最大池化层;j表示在第i层最大池化层后的第j层卷积层;Wi, j和Hi, j表示所提取的特征的维度大小。i和j分别默认取5和1。

因此, SAMGAN的整体损失函数为

Loss=GX(GX,DX,X,Y)+Ggray(Ggray,Dgray,Xgray,Ygray)+

λSFPSFP(GX,X)+λSFPSFP(Ggray,Xgray)+

λidt(GX,Ggray),

(7)

其中,λ控制着灰度一致性损失对整体损失函数的影响程度, 而λSFP控制着SFPLoss对整体损失函数的影响程度。 根据经验值,λ取值5,λSFP取值1。

2 实 验

2.1 数据集和实验细节

因为SAMGAN使用的是未配对的低/正常亮度的图像进行训练的独特能力,所以使用Jiang等[12]所使用的测试集和训练集。 其中测试集包含LIME[16]、 NPE[17]、 MEF[18]、 DICM[19]、 VV(https://sites.google.com/site/vonikakis/datasets)等的测试集。

首先以2e-4的学习率训练SAMGAN 100个epoch, 随着学习率线性递减到0, 再训练100个epoch。使用Adam优化器, 批大小为32。

2.2 消融实验

为验证设计模型SAMGAN的可行性, 设计了几个消融实验来验证, 分别是只使用GX和DX的实验(即NoGrayandIdt), 使用GX、DX和Ggray、Dgray但不使用idt的实验(即NoIdt), 以及完整的SAMGAN实验。 一共3个实验,结果如图2所示: 第1列为输入图像, 第2~4列分别是对应NoGrayandIdt、 NoIdt和完整的SAMGAN实验结果。

图2 SAMGAN、NoGrayandIdt和NoIdt的消融实验结果比较Fig.2 Comparison of visual effects of ablation experiments among SAMGAN,NoGrayandIdt and NoIdt

在第2列的NoGrayandIdt实验结果中的第1行中, 栅栏上出现部分区域的亮度过度增强, 使得整幅图像的亮度很不协调; 在第2行中, NoGrayandIdt使得汽车旁边的草地和树木更加泛黄, 而原本的颜色是绿色的; 在第3行中, 原本绿色的桌面更加泛白, 原本黑色衣服也被加上了一层白色的噪声; 在第4行中, 也同样出现部分区域的亮度过度增强的情况。NoGrayandIdt出现的问题也同样出现在NoIdt实验中, 只是程度比较轻。相比之下, 完整的SAMGAN不仅能够很好地避免前两个实验出现的问题, 而且还能很好地增强暗区域, 图像的亮度更加均匀。这证明了本文设计的模型SAMGAN是可行的, 能够取得令人愉悦的视觉效果, 产生的图像质量也比较高。

2.3 对比实验

将SAMGAN的性能与当前具有代表性的方法进行一系列比较实验, 包括视觉质量比较和无参考图像质量评估(IQA)。

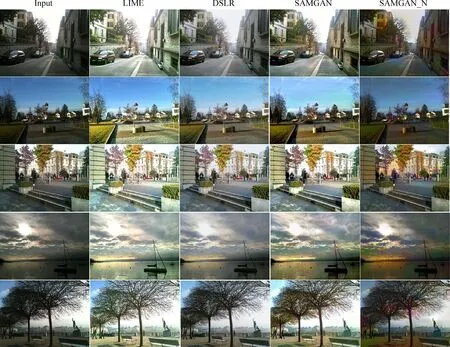

2.3.1 图像的视觉质量比较 使用SAMGAN与具有代表性的方法在视觉质量上进行对比, 分别是EnlightenGAN[12]、RetinexNet[10]、LIME、SRIE和NPE。结果如图3所示, 第1~7列分别是原始的弱光图像、 RetinexNet、 LIME、 NPE、 SRIE、 EnlightenGAN和SAMGAN的增强结果。为了方便观察, 在方框中放大了一些能够容易区分的细节。

图3 SAMGAN与其他算法的效果比较Fig.3 Comparison of SAMGAN with other state-of-the-art methods

在第1行中, RetinexNet出现严重影响图像真实度的噪声, 而LIME出现多个过度增强的区域, NPE和SRIE虽然避免了过度增强, 但是亮度比较暗, EnlightenGAN也出现与LIME一样的问题, 而SAMGAN避免了前四种方法出现的问题。在第2行中, RetinexNet、 LIME、 NPE和SRIE出现了颜色失真的情况, 并且NPE和SRIE的比较暗, 而EnlightenGAN和SAMGAN能够在增强暗区域的同时也能够保留原始的颜色。在第3行中, LIME和EnlightenGAN过度增强整张图像, 其他几种方法则很好地避免了这种情况。在第4行中, 除了SAMGAN, 其他几种方法都使得原始图像的紫色过度加深, 并且NPE和SRIE的结果比较暗, 在RetinexNet中出现较多的噪声。相比之下, SAMGAN不仅增强了暗区域, 还保留了细节的颜色和纹理, 避免了整体和局部过度曝光, 具有更令人满意的视觉效果。

2.3.2 无参考的图像质量对比 盲/无参考图像空间质量评估器(BRISQUE)[20], 是一种被广泛使用的无参考的空间域图像质量评估算法, 用于评估没有真实图像对照的增强图像恢复的情况, 以提供定量比较。表1列出了5个公开图像集(MEF、 NPE、 LIME、 VV和DICM)以及总测试集的BRISQUE分数, 较低的BRISQUE值表示视觉质量更优, 字体加黑的表示结果最好。

表1 BRISQUE在总和子数据集(MEF、 NPE、 LIME、 VV和DICM)上的得分Table 1 BRISQUE scores on the whole testing set and each subset(MEF,NPE,LIME,VV,DICM) respectively

SAMGAN不管是在总的测试集还是子测试集中得到的分数基本上都是最低的。在NPE的数据集上, NPE融合多曝光图像序列能够产生很好的效果, 获取最低的BRISQUE分数, 但是视觉效果比SAMGAN的差, 也会丢失部分细节。SAMGAN不仅在彩色图中保留原始图像的特征和内容, 同样在灰度图中保留, 而且还保证了生成的灰度图的一致性。这进一步证明了SAMGAN增强弱光图像的质量比当前很多技术更好。

2.4 现实世界的图像

域自适应是实现现实世界可泛化图像增强的一个必不可少的因素。SAMGAN可以在没有成对的弱光/正常亮度的弱光图像训练数据集下训练模型, 因此SAMGAN可以直接增强来自不同领域真实的弱光图像。在这些领域中可以没有成对的训练图像, 甚至可以没有相同领域的正常亮度的图像。为了验证SFPGAN增强现实世界的弱光图像的有效性, 本文使用来自真实驾驶数据集Berkeley Deep Driving (BDD100K)[21]和DPED数据集[22](DSLR Photo Enhancement Dataset, DPED)中的弱光图像进行实验, 以显示SAMGAN在实际中的这一独特优势。

在数据集BDD100K中, 随机选择了900多张弱光图像, 每一张弱光图像的像素强度平均值都小于45, 再随机选择50多张弱光图像作为测试集。这些弱光图像具有严重的伪影和高ISO噪声, 并且训练集和测试集没有交集。然后使用两个不一样的训练集训练得到的模型作对比, 包含: 1)使用2.1节中的训练集并且是没有包含BDD100K中任何一张图像的训练集训练得到的模型SAMGAN; 2)SAMGAN_N: SAMGAN的一个域适应版本, 它使用BDD100K数据集的弱光图像进行训练, 而正常亮度的图像仍然来自2.1节中非成对数据集中的高质量的图像。在此使用另外的两个方法作对比, 自适应直方图均衡化(AHE)和LIME。结果如图4所示: 第1列为弱光图像, 第2~5列分别为LIME、 AHE、 SAMGAN和SAMGAN_N的增强的结果, 其中SAMGAN_N是SAMGAN的域适应版本。

图4 在BDD100K数据集上直观比较结果Fig.4 Visual comparison of the result on the BDD100K dataset

LIME的结果受到严重的噪声放大和过度伪影的影响, 而AHE不能够充分增强弱光图像的亮度。相比于LIME和AHE的结果, SAMGAN出现的噪声更少、 更清晰。虽然SAMGAN_N的结果更清晰, 但是出现很明显的噪声, 影响图像的实用性。使用2.3.2节的无参考图像质量评价方法依次对第1~5行增强的结果进行评价, 所得到的分数依次是45.951 9、 42.955 9、 45.906 8、 40.907 3、 41.613 0, 进一步证明SAMGAN能够适用于车载夜间图像。

为了验证SAMGAN能够将质量差的手机拍摄照片转换为高质量的图像, 在DPED中分为测试集和训练集, 选择测试集中使用iPhone 3GS拍摄的照片作为测试集, 共50张; 随机选择训练集中使用iPhone 3GS拍摄的照片作为弱光图像的训练集, 共960张。实验过程类似前面的实验过程。此外, 还与Ignatov等[22]提出的DSLR增强方法作了比较, 结果如图5所示。

图5 在DPED数据集上直观比较结果Fig.5 Visual comparison of the result on the DPED dataset

LIME出现整体过度增强的情况; 而SAMGAN_N出现颜色失真的问题, 亮度也不够; DSLR在增强亮度的时候, 能够避免颜色失真; 对于SAMGAN而言, 不仅能够避免颜色失真, 而且能够使得亮度更温和一点, 但不会过度增强。使用无参考图像质量评价方法依次对第1~5行增强的结果进行评价, 所得到的分数依次是16.908 6、 18.119 2、 15.194 7、 14.304 7、 14.896 2, 证明SAMGAN能够增强实际的弱光图像。

由于在BDD100K和DPED数据集中选择的是无成对的弱光/正常亮度的图像训练集, 因此SAMGAN能够轻松地适应SAMGAN_N, 而无需在新域中进行任何受监督的数据重新训练模型, 这极大地促进了其在现实世界中的推广。

3 结 论

本文使用新颖且灵活的无监督框架解决了在无成对低亮度和正常亮度图像集的弱光增强问题, 提出的SAMGAN在各种弱光数据集上的实验结果表明, 在主观和客观指标下, 它均优于多种具有代表性的方法。此外, SMAGAN可以适应真实、 嘈杂的弱光图像, 增强的图像在视觉上令人非常满意。