基于DS 证据理论多特征融合模型的说话人分割聚类研究

项 羽,令晓明,2,郭亚龙

( 1.兰州交通大学 光电技术与智能控制教育部重点实验室,兰州 730070;2.兰州交通大学 国家绿色镀膜技术与装备工程技术研究中心,兰州 730070)

说话人分割聚类( Speaker Diarization)是语音处理的一个研究方向, 主要是作为一种前端处理技术在语音处理领域使用。 是将一段连续的语音数据按不同说话人分割成片段, 并给每段语音片段标注上说话人的身份信息,以解决“ 谁在什么时候说”的问题[1]。 说话人分割聚类在众多领域都有着广泛的应用,如在录音软件中,可以通过说话人分割聚类技术将录音音频的说话人及其说话时长标注出来, 将其作为特征可以快速从众多音频中找到特定音频;在会议场景中,结合说话人分割聚类技术和语音识别技术可以生成一份包含发言人身份信息的会议记录,便于参会人员回顾会议内容;作为语音领域的前端处理技术,还可以提升后续语音处理系统的性能,如语音识别系统在说话人发生变化的时间点重置语音识别模型可以提高语音识别的准确率。

最初的说话人分割方法是基于能量的[2],这种方法是假设在两人对话话语之间存在一个静默区域, 通过设定能量阈值检测说话人转换点, 但是实际场景存在抢话现象导致分割结果并不理想。 目前比较主流的分割方法有2 种,分别是基于距离和基于模型的分割方法。 基于距离的分割方法不需要说话人的先验信息,但需划定门限,鲁棒性较差。 常用的距离度量有贝叶斯信息准则( Bayesian Information Criterion,BIC)、 归一化交叉似然比( Normalized Cross Likelihood Ratio,NCLR)、T-Test度量距离等[3]。 常用的说话人聚类方法是层次聚类,进行层次聚类有2 种方法, 分别是自下而上和自上而下的方法[4],其中自下而上的方法鲁棒性较差,而自上而下的方法区分性较差, 在分割聚类系统中自下而上的方法得到了更为广泛的使用。

本文提出基于DS 证据理论多特征融合模型, 提取说话人的嵌入特征用于说话人分割聚类。 该模型相较于传统单一特征或单一神经网络, 说话人分割聚类系统性能得以提升。

1 说话人分割聚类系统

完整的说话人分割聚类系统由预处理、有效语音检测、说话人转换点检测、说话人聚类和二次分割几部分组成,其示意图如图1 所示。

图1 说话人分割聚类系统框图

1.1 预处理

音频信号如果直接输入说话人分割聚类系统,系统的性能会不理想。 因此在此之前需要对音频信号进行预加重、分帧、加窗等预处理,由此消除发声器官本身和采集设备采集音频所带来的混叠、高次谐波失真、高频等因素对音频信号质量的影响。

1.2 有效语音检测

有效语音检测的目的是将输入的音频信号中的语音与非语音分离,只保留说话人的语音信号用于后续的分割聚类,这里的非语音指的是静音区域、环境噪音、背景音乐音效等。 有效语音检测模块的存在有助于后续模块专注于处理音频信号的语音部分,由此而提高系统的性能。

1.3 说话人转换点检测

说话人转换点检测的目的是检测出说话人变化的时间点,再根据这个时间点将语音信号分割成片段,使其成为只包含一个说话人的音频片段。 目前主流的分割方法有2 种,分别是基于距离和基于模型的方法。基于距离的方法是选取大小相同相邻的2 个滑动窗,计算2 个窗内的特征分布之间的距离作为说话人分割的依据,通过与预先设定的阈值或惩罚因子来进行比较判断2 个窗内的语音是否来自同一说话人[5]。基于模型的方法是对语音建立起说话人模型,将语音分割成等长的短语音片段,使用建立的说话人模型对这些语音片段进行分类,模型之间的边界就是说话人的转换点。 除此之外还有基于深度神经网络的方法,其基本思想是通过深度神经网络来确定当前语音帧和说话人转换点的相对位置,然后在所有语音帧中找到和理想的转换点最匹配的语音帧作为说话人转换点。 基于深度神经网络的方法相较于前2 种方法准确率会更高,但是计算量会更大。

1.4 说话人聚类

说话人聚类是将分割得到的语音片段按说话人的身份信息进行聚类,类别的数量就是说话人的数量。常用层次聚类的方法进行说话人聚类, 进行层次聚类有自下而上和自上而下2 种方法。 自下而上的方法是将每段语音片段都当作一类,然后计算所有类别之间的相似度,接着合并2 个相似度最高的2 个类别, 合并后重新计算新类之间的相似度, 重复迭代这一过程直到完成聚类输出结果[6]。自上而下的方法是将所有语音片段当成一个整体类别,然后增加类别并重新分配语音片段,不断重复迭代直至达到目标类别数。 除了层次聚类之外还可以使用谱聚类等聚类方法进行说话人聚类, 谱聚类是通过距离矩阵和相似矩阵将聚类问题转化为平面上的带权无向图的切分问题,使得切分得到的子图之间的权重和最小,而每个子图内的权重和最大。

1.5 二次分割

说话人聚类完成后就得到了说话人分割聚类的初步结果,但是得到的结果可能不够理想。二次分割就是对片段的边界及聚类结果进行进一步处理, 得到更佳的聚类结果。二次分割会带来额外的计算量,而且只能用于离线的说话人分割聚类系统,因此二次分割不是必须的。

2 基于DS 融合理论的说话人嵌入特征提取

2.1 DS 证据理论

DS 证据理论是由Dempster 提出并由Shafer 完善的不确定性推理计算方法[7],是一种广泛应用于决策融合和信息融合上的多数据融合方法,在多分类器融合、不确定性推理、多准则决策等领域都得到了广泛的应用。

在DS 证据理论中识别框架是不确定性问题所有可能发生事件的集合[8],用Θ={A1,A2,…,An}来表示,Ai为识别框架Θ 的一个子集。 识别框架内的子集两两之间相互排斥,其幂集用2Θ表示,表示的是所有可能的问题组合。

基本概率分布是DS 证据理论对识别框架中的每一种可能发生事件的结果都分配了概率。 基本概率分布配置函数称为mass 函数,常用m 来表示。对于2Θ中的任何命题A,mass 函数在识别框架的幂集2Θ满足以下条件

式中:Ø 为空集,表示不可能发生的命题;m( A)为A 的基本概率分配函数,反映了证据对命题A 的支持程度。

组合规则是DS 证据理论的核心,DS 证据理论的融合基本策略就是将多个独立证据函数m1,m2,…,mi进行正交运算,用⊕表示组合运算,则

2 个证据体Ai和Bi的合成公式可以表示为

同理,多证据体的情况计算公式为

式中:1/( 1-k) 为归一化因子;n 为发生事件的个数;k 反映了证据体之间冲突程度的大小,值越大,冲突程度越大,取值范围为[0,1]。

2.2 组合特征

原始的语音信号中有着大量的冗余信息,空间特征也较为复杂。 如果将原始的语音信号直接送入神经网络会导致网络模型承担额外的计算量,导致网络训练的效果并不理想。 因此对原始语音信号进行特征提取选取出具有代表的数据用于表征语音信号能减少包含的冗余信息,减轻网络的负担,提高训练的效果。

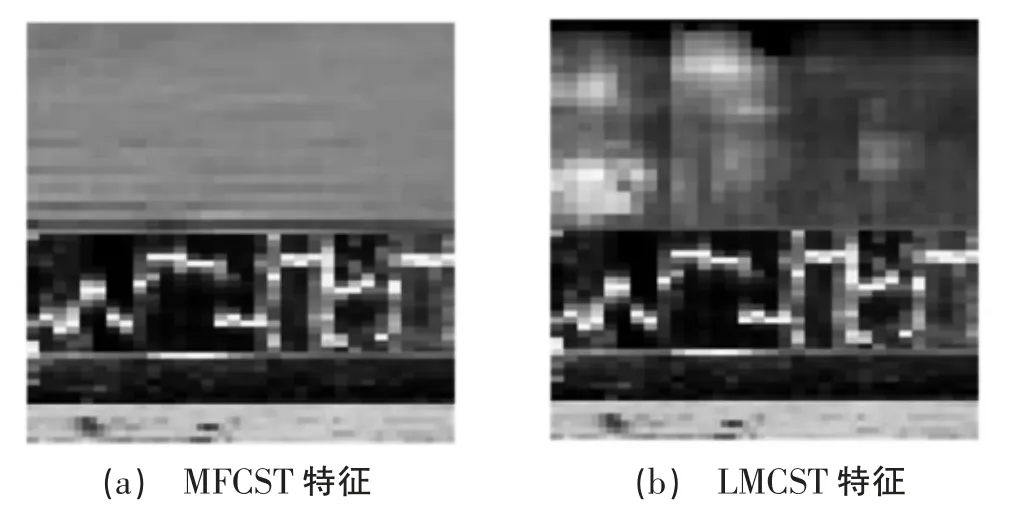

本文选取了5 种声学特征进行组合,相较于单一特征能够更加全面有效地表征语音信号。 这5 种特征分别是梅尔倒谱系数( Mel-scale Frequency Cepstral Coefficients,MFCC)、 对数梅尔频谱( Logarithmic Mel Spectrum,Log-Mel)、 色度特征( Chroma)、 光谱对比度特征( Spectral Contrast)和调性网络特征( Tonnetz)。 分别将MFCC 和Log-Mel 与其他3 种特征的谱图垂直拼接得到MFCST 特征和LMCST 特征。 2 种组合特征的语谱图如图2 所示。

图2 MFCST 与LMCST 语谱图

2.3 密集卷积网络

在卷积神经网络中,随着网络层数的加深,提取的像素特征就越准确。但是网络层数并不是越多越好,过多的网络层数会带来训练过程中前传信号和梯度信号的消失问题。 残差网络( ResNet)的出现解决了这一问题,ResNet 的核心是通过建立前层与后层之间的连接,可以实现训练过程中梯度的反向传播,可以训练出更深的卷积神经网络。密集卷积网络( DenseNet)是基于ResNet 思想提出的一种网络结构,与ResNet 相比是一种更密集的连接方式,将所有层都相互连接起来。 DenseNet 的这种连接方式会使得当前层的输入来自于前面所有层的输出,而不是仅仅只有前一层的输出。这样的方式充分利用了可用的特征信息,并对特征进行重用,大大减少了训练模型所需的参数量,同时还减轻了网络加深梯度消失的问题。

2.4 多分类器DS 融合

由于在现实环境中存在各种外界因素的干扰,采用单一神经网络进行模型训练效果并不理想, 而基于DS证据理论的决策融合算法可以利用数据集训练不同的分类器进行融合。 本文选取的网络为DenseNet-121,将从语音数据提取到的2 种组合特征MFCST 和LMCST 分别作为2 个网络的输入, 从2 个网络提取到softmax 层的输出后,利用DS 证据理论进行融合。 DS-DenseNet 网络结构如图3 所示。

图3 基于DS 证据理论的网络结构

3 实验分析

为了验证本文提出的基于DS 证据理论多特征融合模型的有效性,从SAM 语料库[9]中抽取了18 000 个语音片段作为训练集,模型在AVA 数据集上进行测试。 对声音片段进行分帧处理,重叠率为87.5%。 利用Python 的librosa 库 提 取MFCC、Log-Mel、Chroma、Spectral Contrast 和Tonnetz 特征。 为了研究特征维数的影响,组合特征分别使用了24 维、32 维和64 维的MFCC、Log-Mel 与8 维的Chroma、16 维的Tonnetz 和8 维的Spectral Con trast 进行拼接,将拼接组合特征MFCST 和LMCST 输入到网络中,用于提取说话人的嵌入特征,提取到说话人的特征序列之后进行层次聚类得到说话人分割聚类的结果。

为了评估系统的性能,采用说话人分割聚类错误率( Diarization Error Rate,DER) 作为系统的评价指标,其定义如下

DER=MSR+FASR+Speaker Error,

式中:MSR 为漏警, 表示有效语音部分被误判为非语音部分的比例;FASR 为虚警,表示非语音的部分被误判为有效语音部分;Speaker Error 表示说话人分类错误,表示原来属于某个说话人的语音被误判为另一说话人语音的比例。这3 种错误来源于说话人分割聚类的不同步骤,MSR 和FASR 是有效语音检测模块产生的错误,而Speaker Error 是说话人转换点检测和说话人聚类产生的错误。

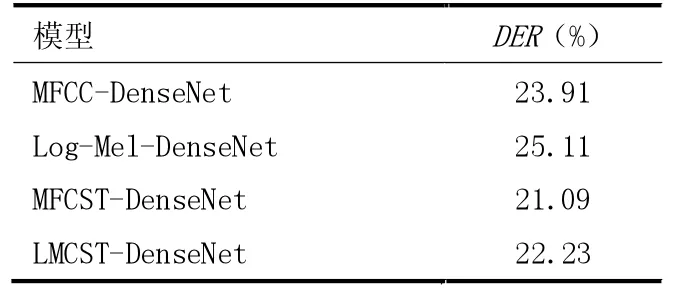

为了将组合特征与单特征进行性能比较,首先使用了24 维的MFCC、Log-Mel 与其他3 种特征的组合,将单MFCC、Log-Mel 与2 种组合特征输入DenseNet 网络进行实验( 表1)。

表1 单特征与组合特征的DER

由表1 可知,组合特征相较于单特征用作网络的输入,在相同条件下能够得到更为准确的结果。为了测试进行DS 理论融合结果及特征维度的影响, 分别将24 维、32 维和64 维的MFCC、Log-Mel 与其他3 种特征进行组合,用于DS-DenseNet 的输入进行实验( 表2)。

表2 DS-DenseNet 下不同维度特征的DER

通过与表1 对比, 可以发现进行DS 融合后系统的性能得到了提升,并且在本文选用的3 种特征维度中,32维的特征维度取得了最好的结果。

4 结束语

本文提出基于DS 证据理论多特征融合模型的说话人分割聚类提高了分割聚类系统的性能。 与单一特征相比,2 种组合特征的系统准确率得到了提升,将2 种组合特征使用DS 证据理论进行融合后再作为分割聚类系统的输入能进一步提升系统的精度。 特征维度也对系统性能有一定影响, 其中在本文选取的3 种特征维度中,32维取得了最高的精度。