基于语义分割的无人机图像西瓜果实提取研究

邱金凯 许秀英 康烨 臧浩 马锴 郭志鹏

摘要:无人机图像中的西瓜果实精准分割是进行西瓜计数和产量预估的前提。针对无人机西瓜图像因存在田间背景复杂、光照不均匀、特征不显著等情况容易导致误分割和细节边缘分割不精确的问题,提出一種改进U-Net网络的西瓜果实分割模型。首先采集西瓜成熟前期的无人机可见光图像,构建西瓜果实语义分割数据集;其次在下采样阶段引入高效通道注意力机制,增强果实区域的特征权重,并在跳跃连接部分增加双注意力机制,基于局部特征建立丰富的上下文依赖关系,提高对目标区域的特征提取能力;最后使用特征图和类别激活映射图对模型预测过程进行可视化解释。结果表明,该模型的准确率、精确率、召回率、F1-Score值和交并比分别为99.03%、92.67%、90.55%、91.21%和84.71%,单幅图像分割时间为0.145 s。该模型能够有效捕获成熟前期的无人机西瓜图像中的果实特征,准确识别自然环境中复杂背景的果实区域,具有良好的分割效果和泛化能力。为利用无人机遥感技术统计大田西瓜数量和成熟前期产量预估提供理论依据和技术支持。

关键词:西瓜果实;深度学习;无人机图像;语义分割;注意力机制

中图分类号:S24: TP391.4 文献标识码:A 文章编号:2095-5553 (2024) 03-0182-07

Research on watermelon fruit extraction from UAV images based on semantic segmentation

Qiu Jinkai1, Xu Xiuying1, 2, Kang Ye1, Zang Hao1, Ma Kai1, Guo Zhipeng1

(1. College of Engineering, Heilongjiang Bayi Agricultural University, Daqing, 163319, China;2. Heilongjiang Province Conservation Tillage Engineering Technology Research Center, Daqing, 163319, China)

Abstract:

The accurate segmentation of watermelon fruit in UAV(unmanned aerial vehicle) image is the premise of watermelon counting and yield estimation. This paper proposed a segmentation model of watermelon fruit based on an improved U-Net network to address the problems of false segmentation and inaccurate detail edge segmentation of UAV watermelon images due to complex field background, uneven illumination, and insignificant features. The visible light image of the UAV in the early ripening stage of watermelon was collected to construct the semantic segmentation dataset of watermelon fruit. An efficient channel attention mechanism was introduced in the downsampling process to enhance the feature weight of the fruit region, and a dual attention mechanism was added in the skip connection part to establish rich context dependency based on local features, so as to improve the feature extraction ability of the target region. Then, the feature map and class activation map were used to visually explain the prediction process of the model. Experimental results showed that the Accuracy, Precision, Recall, F1-Score and Intersection over Union(IoU) of the model were 99.03%, 92.67%, 90.55%, 91.21% and 84.71%, respectively, and the processing time of an individual image was 0.145 s. This model can effectively capture the fruit features in the UAV watermelon image in the early maturity stage, accurately identify the fruit regions with complex background under natural environment, and has good segmentation effect and generalization ability. It can provide theoretical basis and technical support for the use of UAV remote sensing technology to count the number of watermelon in the field and estimate the yield at the early maturity stage.

Keywords:watermelon fruit; deep learning; UAV image; semantic segmentation; attention mechanism

0 引言

遥感技术在农业领域的应用越来越广泛[1, 2],利用无人机可见光图像进行西瓜果实识别,提供与产量相关的视觉信息具有重要的应用价值。在果实成熟前期,准确的果实计数管理和产量预估,不仅可以帮助种植者在销售作物时做出更具成本效益的决策,还可以为未来的作物营养和水分管理提供必要的田间变化信息[3, 4]。应用图像识别技术从无人机图像中提取西瓜果实,能够高效观察和分析西瓜田间信息,极大减轻瓜农的负担。

国内外已有研究提出采用图像处理和机器学习方法对无人机西瓜图像进行分割,官大文等[5]基于HSV颜色模型,采用形态学运算、二值化处理对由无人机拍摄的西瓜图像进行成熟西瓜侦测,可以侦测到大部分成熟西瓜,但被西瓜根茎叶遮蔽的西瓜难以被识别出。Ekiz等[6]使用灰度共生矩阵提取灰度图像的纹理特征,结合贝叶斯线性判别分析和K-means聚类算法对无人机图像中的西瓜进行分类与分割,能够检测到图像中的西瓜,但无法准确识别并提取西瓜果实区域。上述方法均为浅层特征提取,对田间背景复杂、不同光照条件的情况分割效果较差,存在误分割现象,尤其是叶片遮挡和杂草干扰时,细节区域提取不完整。

近年来,深度学习的迅速兴起为植物果实分割增添了新的活力[7],其具有在复杂背景下准确可靠地提取果实特征的潜力,能够为产量预测和计数管理提供数据支撑。Zhao等[8]通过小型无人机采集高分辨率田间甜瓜图像,基于ZF网络构建Faster R-CNN检测模型,能够从图像中识别并检测出甜瓜,但无法准确提取果实区域。Kalantar等[9]基于RetinaNet深度卷积神经网络检测到无人机图像中甜瓜的位置,使用Chan-Vese主动轮廓模型估计目标形态的轮廓,成功从图像背景分割出果实。但传统深度学习模型缺乏关注图像中不显著特征,没有充分利用全局视野中果实间的像素级关系,以致上下文语义信息联系不紧密,对相似度高的瓜秧和果实进行分割时误判率较高。薛君蕊等[10]采用基于改进FCN-8s的灵武长枣图像分割方法,结合多尺度特征提取模块,实现对不同成熟度灵武长枣目标的分割。Qian等[11]提出基于递归交叉注意力机制的U-Net改进模型来分割甜瓜果皮和种腔特征,模型的分割效果较好。

以成熟前期获取的无人机可见光西瓜图像为研究对象,提出一种基于改进U-Net网络的西瓜果实语义分割模型。为实现田间西瓜果实的精确提取,采用深度学习方法,以U-Net网络为基本框架,对模型的下采样、跳跃连接部分进行改进,突出图像中各个通道的重要特征,从位置和通道两个维度提升网络对果实特征的关注度,充分考虑各像素间的关系,提高西瓜果实分割的特征表示。使用特征图和类别激活映射图对模型预测过程进行可视化解释,验证改进网络的合理性。

1 材料和方法

1.1 图像采集

无人机图像数据采集试验于2021年7月20日(西瓜成熟前期)在黑龙江省大庆市大同区大同镇西瓜试验田(东经124°56′,北纬45°59′)进行。大疆精灵4 RTK无人机,最大飞行速度16 m/s,最大飞行时间30 min,搭载DJI FC6310R相机,成像分辨率为5 472像素×3 648像素,可见光图像的数据格式为.JPG。试验时天气晴朗,拍摄时间为下午14:00左右,航拍时无人机飞行高度设置为5 m左右,相机镜头设置为-90°俯仰角正拍,采用航点悬停拍照模式,获得原始图像80幅。

1.2 数据集构建

考虑到无人机西瓜图像分辨率较高且语义分割算法的运算量较大,对原始图像进行了裁剪,将其裁剪成小块再进行标注。数据集构建的具体过程如下。

1) 图像裁剪。为加快网络模型的推理速度,将图像分辨率调整为512像素×512像素,以.png格式保存裁剪后的图像,共得到600张图像。

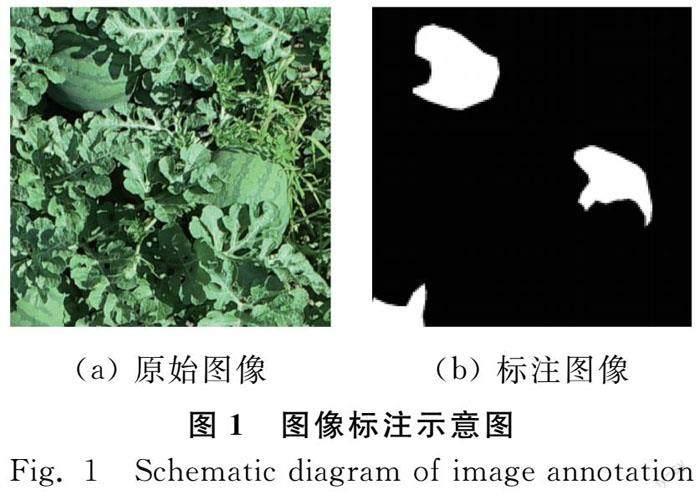

2) 数据标注。为满足网络模型训练、参数调优和相关性能评估的需求,利用Adobe Photoshop CC 2019多邊形套索工具对上述图像进行人工精确标注,将西瓜图像中的果实区域像素标记为255即白色,其余背景像素标记为0即黑色,标签以.png格式保存,图像标注如图1所示。

3) 数据集划分。按照6∶2∶2的比例将数据集划分为训练集、验证集和测试集,其中训练集共360幅图像,验证集共120幅图像,测试集共120幅图像。利用训练集训练网络模型,利用验证集调整超参数,利用测试集评估模型性能。

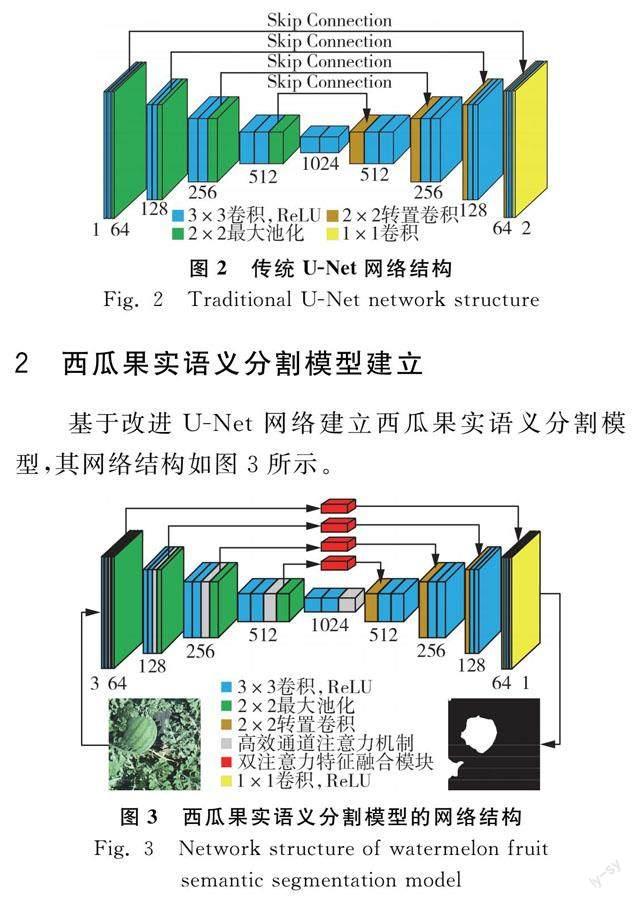

1.3 传统U-Net模型

U-Net网络[12]是Ronneberger等在FCN(Fully Convolutional Networks)网络[13]的基础上进行优化得到的一种基于小数据集的网络,具有小样本学习的优势,能够更快速、更有效地实现分割。该网络由编码器、跳跃连接和解码器组成。编码器位于模型的左侧,包括两个3×3卷积块和最大池化,通过下采样捕获图像的上下文信息,实现逐层提取图像中的目标特征。解码器位于模型的右侧,采用2×2转置卷积上采样特征图,将尺寸扩大两倍,通道维度缩小一半,再执行两个3×3卷积,恢复目标细节和特征图分辨率,实现精准的定位。最后执行1×1卷积实现特征图中每个像素点的分类,生成预测图。主要特点是引入跳跃连接,将编码器特征图与上采样特征图在通道维度上实现特征融合。传统U-Net网络结构如图2所示。

2 西瓜果实语义分割模型建立

基于改进U-Net网络建立西瓜果实语义分割模型,其网络结构如图3所示。

主要改进之处:(1)在网络下采样过程中加入高效通道注意力机制,位于由两组3×3卷积、ReLU激活函数组成的标准卷积块之后,经过通道注意力模块更新后的特征逐层传递,使网络在训练过程中全程关注目标特征。(2)在下采样和上采样之间的跳跃连接部分加入双注意力机制,基于线性注意力和通道注意力的整合来捕获编码器输出特征之间的相互依赖性,丰富特征表示,抑制图像中不相关区域的特征激活,减少噪声对果实分割的影响。

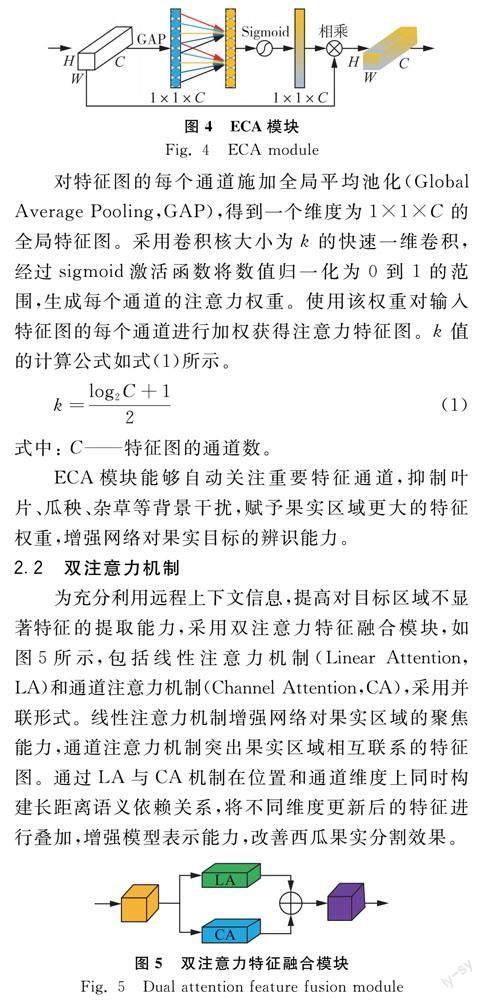

2.1 高效通道注意力机制

U-Net网络中浅层特征图偏向于对果实、瓜秧和背景的纹理、形状信息的表征,深层特征图更抽象,偏向于对西瓜图像中果实区域类别的表征。当针对相似度高的瓜秧和果实进行分割时,U-Net模型无法学习到其重要程度,误判率较高。增加高效通道注意力机制(Efficient Channel Attention,ECA)[14],其网络结构如图4所示。ECA模块是基于SENet改进的,能够在通道维度上分配的重要程度,有助于提高模型的特征表示能力。

对特征图的每个通道施加全局平均池化(Global Average Pooling,GAP),得到一个维度为1×1×C的全局特征图。采用卷积核大小为k的快速一维卷积,经过sigmoid激活函数将数值归一化为0到1的范围,生成每个通道的注意力权重。使用该权重对输入特征图的每个通道进行加权获得注意力特征图。k值的计算公式如式(1)所示。

k=log2C+12(1)

式中:C——特征图的通道数。

ECA模块能够自动关注重要特征通道,抑制叶片、瓜秧、杂草等背景干扰,赋予果实区域更大的特征权重,增强网络对果实目标的辨识能力。

2.2 双注意力机制

为充分利用远程上下文信息,提高对目标区域不显著特征的提取能力,采用双注意力特征融合模块,如图5所示,包括线性注意力机制(Linear Attention,LA)和通道注意力机制(Channel Attention,CA),采用并联形式。线性注意力机制增强网络对果实区域的聚焦能力,通道注意力机制突出果实区域相互联系的特征图。通过LA与CA机制在位置和通道维度上同时构建长距离语义依赖关系,将不同维度更新后的特征进行叠加,增强模型表示能力,改善西瓜果实分割效果。

2.2.1 线性注意力机制

针对传统深度学习模型没有充分考虑全局视野中果实间的像素级关系,引入线性注意力机制[15],在局部特征上建立丰富的像素间关系,加强对空间维度的特征提取能力。假设N为输入序列的长度,C为输入通道的数量,N=H×W,其中H和W分别为输入图像的高和宽。给定一个特征X=[x1,…,xN]∈RN×C,缩放点积注意力利用三个投影矩阵Wq∈RDx×Dq,Wk∈RDx×Dk,Wv∈RDx×Dv生成对应的查询矩阵Q、键矩阵K和值矩阵V,基于Transformer模型[16],其计算公式如式(2)所示。

D(Q,K,V)=softmaxQKTdkV(2)

式中:dk——比例因子。Q∈RN×Dk和KT∈RDk×N,所以QKT∈RN×N,时间和内存复杂度为O(N2)。

根据softmax归一化函数的定义,通过式(2)生成的第i行结果矩阵可写为

D(Q,K,V)i=∑Nj=1eqiTkjvj∑Nj=1eqiTkj(3)

为缓解点积注意力计算复杂度大的问题,采用一阶泰勒展开近似eqiTkj,实现线性注意力机制。

eqiTkj≈1+qiTkj(4)

为保证上述近似的非负性,即确保qiTkj≥-1,利用L2范数对qi和kj进行归一化处理,则方程可写为

D(Q,K,V)=∑jVi,j+Q‖Q‖2K‖K‖2TVN+Q‖Q‖2∑jK‖K‖2Ti,j(5)

由于∑Nj=1kj‖kj‖2vjT和∑Nj=1kj‖kj‖2可以对每个查询进行计算和重用,该线性注意力机制的时间和内存复杂度为O(N)。在降低模型计算复杂度的同时,通过考虑所有数据样本不同位置之间的相关性来捕获长距离依赖关系,使相似的语义特征相互促进,突出重点特征区域,提高分割精度。

2.2.2 通道注意力机制

不同类别的语义属性体现在不同通道的特征上,给不同通道赋予不同的权重,表示该通道与相关语义信息的关联程度。利用果实区域通道特征间的相互关联性,使不显著语义特征得到促进,有助于增强特定语义的特征表示。因此,引入通道注意力机制[17],其网络结构如图6所示。

特征图A被重构成RC×N,将A和A的转置进行矩阵乘法,经过softmax函数输出通道注意力图X∈RC×C。

xji=exp(Ai·Aj)∑Ci=1exp(Ai·Aj)(6)

式中:Ai——矩阵A中第i个位置元素;Aj——矩阵A中第j个位置元素;xji——第i个通道对第j个通道的响应。

将注意力图X和A的转置执行矩阵乘法,其结果被重构为RC×H×W,再乘以比例系数β,并与特征图A执行元素求和运算,得到最终输出E∈RC×H×W。该过程表示如式(7)所示。

Ej=β∑Ci=1(xjiAi)+Aj(7)

式中:β——可学习参数。

由式(7)可知,每个通道的特征E是所有通道与原始通道的加权和,这有利于提高特征的可辨别性,从而提升分割结果的完整度。

3 試验及结果分析

3.1 模型训练

3.1.1 试验环境

操作系统为Windows 10 64位版本,采用Python 3.6编程语言,试验硬件环境为Intel(R) Core(TM) i5-10400 CPU @ 2.9 GHz处理器,16 GB运行内存, NVIDIA GeForce RTX 2060显卡。基于CUDA 10.0和cudnn 7.4.2,使用PyTorch 1.2.0深度学习框架构建网络模型。

3.1.2 损失函数

试验中选取合适的损失函数对于训练网络正常工作及优化网络参数尤为重要[18]。由于西瓜果实语义分割是一个二分类问题,只有果实和背景两个类别,其本质是将西瓜图像转换成二值图像,故采用二分类交叉熵(binary cross entropy,BCE)损失函数。BCE损失函数的数学表达式如式(8)所示。

LBCE=-1N∑Ni=1[yilogpi+(1-yi)log(1-pi)](8)

式中:N——西瓜图像中的总像素点数量;yi——第i个像素点的真实值,若此像素点为果实,则定义为1,否则为0;pi——第i个像素点的预测值。

3.1.3 试验参数设置

为保证模型训练试验的可重复性,采用固定随机种子策略[19],使每次试验都能产生相同的输入数据,保证每次运行时都能得到相同的结果。为避免产生过学习的情况,设置最大训练轮数为10个epoch[20],训练每轮迭代的批量大小设为1,则360个训练样本每轮迭代360次,共计迭代3 600次。模型权重采用kaiming正态分布随机初始化策略,基于动量的随机梯度下降(Stochastic Gradient Descent,SGD)算法[21]进行网络更新,动量因子、初始学习率和权重衰减系数分别为0.99、0.01和0.000 01。采用动态学习率衰减训练策略,即在每个epoch训练完成后,就在验证集上进行测试,记录其F1-Score值。当检测到3个epoch下验证集的F1-Score值未发生上升时,将学习率调整为原来的10%,迭代轮数达到最大值后停止训练。

3.1.4 模型评价指标

为量化分析西瓜果实分割模型的性能,采用语义分割的标准化评价指标衡量模型在验证集与测试集的表现,主要包括准确率(Accuracy)、精确率(Precision)、召回率(Recall)、F1-Score值(F1)和交并比(Intersection over Union,IoU),具体计算公式如式(9)~式(13)所示。

Accuracy=TP+TNTP+TN+FP+FN(9)

Precision=TPTP+FP(10)

Recall=TPTP+FN(11)

F1=2×Precision×RecallPrecision+Recall(12)

IoU=TPTP+FP+FN(13)

式中:TP——分类正确的果实像素数;TN——分类正确的背景像素数;FP——背景像素被错误分类为果实像素的个数;FN——果实像素被错误分类为背景像素的个数。

在实际评估分割方法性能时,模型分割时间也是一个不可或缺的指标,所以使用单幅图像分割时间t作为评估标准。

3.2 模型性能评估

经过10 epoch训练后,验证阶段的模型分割性能指标如表1所示。由表1可知,改进U-Net模型的精确率和召回率分别为94.37%和91.01%,综合评价指标F1-Score值和交并比分别达到92.66%和86.32%,验证损失值为0.022,表明该模型具有较高的分割精度。

3.3 不同分割方法对比

为进一步验证所提方法对无人机西瓜图像果实分割的有效性,选择传统FCN8s网络模型和传统U-Net网络模型作对比测试。以测试集中的120幅图像作为输入,采用模型评价指标分别对不同分割方法进行定量分析,各方法在120幅测试集图像上评价指标的平均值如表2所示。

表2中的试验结果表明,传统U-Net模型的召回率较高,但精确率较低,这表明U-Net模型的西瓜果实提取不够准确。改进U-Net模型在保证召回率适中的情况下将精确率提升了3.63个百分点,较好地实现了精确率与召回率的平衡,因此,改进U-Net在综合评估指标F1-Score值和交并比上也有较明显的提升,相较于传统FCN8s模型以及传统U-Net模型,F1-Score值分别提高2.45个百分点和1.83个百分点,交并比分别提高3.23个百分点和2.15个百分点。综合五种精度评估结果,改进模型的误分割情况减少,整体分割性能优于其他算法,进一步证明该模型解决无人机图像西瓜果实分割问题的有效性。改进U-Net模型的单幅图像分割时间为0.145 s,与传统U-Net模型相差不大,总体耗时有较小增加,这是由于注意力模块的引入,计算注意力权重存在一定的耗时。

为更直观比较传统FCN8s模型、传统U-Net模型及改进U-Net模型的提取效果,采用不同方法在测试集西瓜图像上进行分割结果比较,如图7所示。

由图7可以看出,FCN8s模型能够粗糙地将西瓜果实从背景中提取出来,但分割的效果不是很好。由于光照阴影、叶片遮挡和杂草干扰的影响,存在一定程度的误分割现象,果实区域也存在较小的孔洞。U-Net模型分割出的果实区域与实际果实区域基本一致,果实边缘分割也较为平滑,但分割结果仍然不够准确,仍存在少量的区域识别错误现象,将背景区域识别为果实区域。改进U-Net模型基本能把不同目标区域划分开,且具有更少的噪声点。对西瓜果实提取的错误较少,分割的结果在目标的边界和形状上相比传统U-Net模型要更加精细。这是因为图像的背景是分散的,改进U-Net模型通过增加双注意力机制,学习与背景相对应的像素之间的长期依赖关系可以帮助网络降低误分率。同时,通过增加高效通道注意力机制,使得模型能够学习到更多较为细节的特征信息,从而提高西瓜果实分割任务的准确性。总体来说,改进U-Net模型能够有效捕获西瓜图像中的果实特征,较好解决了误分割和细节边缘分割不精确的问题,具有良好的分割效果和泛化能力。

3.4 不同模型特征图与热力图可视化效果对比

为更加直观呈现模型所学习到的特征及图像中某个区域的重要程度,更好地理解改進U-Net模型,在预测过程中分别对传统U-Net模型及改进U-Net模型的最后一层卷积层进行特征图、热力图可视化。热力图中的某个区域颜色越亮,表示网络模型对该区域的关注度越强。以成熟前期的无人机图像西瓜果实分割为例,得到如图8所示的结果。

观察模型的特征图、热力图,发现两种模型对西瓜果实的学习效果及关注区域不同。从图8(a)和图8(b)中观察到传统U-Net模型对目标的局部细节区域学习效果存在明显缺陷,关注的区域包含西瓜果实的部分区域和背景区域,存在关注区域错误的问题。具体表现在相似度高的瓜秧被识别成果实区域。从图8(c)和图8(d)中观察到改进U-Net模型对目标的主体区域学习效果更好,对目标位置边缘的判断更加准确,且热力图呈现更加集中,说明对目标位置的关注程度更高,充分解释了改进网络的合理性。具体表现在模型定位到图像中重要目标的位置,增强了对图像深层信息的提取能力;引入注意力机制,使得网络模型更关注于西瓜果实区域,有效抑制了光照不均匀、特征不显著等因素干扰。

4 结论

为解决无人机西瓜图像因存在田间背景复杂、光照不均匀、特征不显著等情况容易导致误分割和细节边缘分割不精确的问题,提出一种基于深度学习的西瓜果实语义分割模型。

1) 采用U-Net模型作为基础网络,分别在下采样和跳跃连接部分进行了改进,并在自建西瓜分割数据集上进行了训练、验证和测试,进一步提升模型的分割性能。

2) 在测试集上的结果表明,改进U-Net模型的准确率、精确率、召回率、F1-Score值和交并比分别为99.03%、92.67%、90.55%、91.21%和84.71%,单幅图像分割时间为0.145 s。与FCN8s模型和U-Net模型相比,该模型的分割精度有所提升。

3) 采用特征图和热力图从模型学习效果及关注区域的位置和强度进行可视化解释,进一步验证了改进网络的合理性。

4) 与其他两种模型相比,改进U-Net模型能较好解决误分割和细节边缘分割不精确的问题,分割结果中的噪声点较少,具有良好的分割效果和泛化能力,为利用无人机遥感技术进行田间西瓜果实计数管理和产量预估提供理论基础和技术支撑。

参 考 文 献

[1]Midtiby H S, Pastucha E. Pumpkin yield estimation using images from a UAV [J]. Agronomy, 2022, 12(4): 964.

[2]Zou K, Chen X, Zhang F, et al. A field weed density evaluation method based on UAV imaging and modified U-Net [J]. Remote Sensing, 2021, 13(2): 310.

[3]朱启兵, 张梦, 刘振方, 等. 基于点云配准的盆栽金桔果实识别与计数方法 [J]. 农业机械学报, 2022, 53(5): 209-216.Zhu Qibing, Zhang Meng, Liu Zhenfang, et al. Identification and counting method of potted kumquat fruits based on point cloud registration [J]. Transactions of the Chinese Society for Agricultural Machinery, 2022, 53(5): 209-216.

[4]He L, Fang W, Zhao G, et al. Fruit yield prediction and estimation in orchards: A state-of-the-art comprehensive review for both direct and indirect methods [J]. Computers and Electronics in Agriculture, 2022, 195: 106812.

[5]官大文, 王春源, 王駿发. 基于无人机机器视觉的西瓜侦测创新农场管理模式[J]. 海峡科学, 2020(11): 62-68.Guan Dawen, Wang Chunyuan, Wang Junfa. Watermelon detection and innovative farm management mode based on UAV machine vision [J]. Straits Science, 2020(11): 62-68.

[6]Ekiz A, Arca S, Bozdogan A M. Classification and segmentation of watermelon in images obtained by unmanned aerial vehicle [C]. 2019 11th International Conference on Electrical and Electronics Engineering (ELECO), 2019: 619-622.

[7]Li Q, Jia W, Sun M, et al. A novel green apple segmentation algorithm based on ensemble U-Net under complex orchard environment [J]. Computers and Electronics in Agriculture, 2021, 180: 105900.

[8]Zhao T, Wang Z, Yang Q, et al. Melon yield prediction using small unmanned aerial vehicles [C]. Autonomous Air and Ground Sensing Systems for Agricultural Optimization and Phenotyping Ⅱ. SPIE, 2017, 10218: 53-58.

[9]Kalantar A, Edan Y, Gur A, et al. A deep learning system for single and overall weight estimation of melons using unmanned aerial vehicle images [J]. Computers and Electronics in Agriculture, 2020, 178: 105748.

[10]薛君蕊, 王昱潭, 曲爱丽, 等. 基于改进FCN-8s的灵武长枣图像分割方法[J]. 农业工程学报, 2021, 37(5): 191-197.Xue Junrui, Wang Yutan, Qu Aili, et al. Image segmentation method for Lingwu long jujubes based on improved FCN-8s [J]. Transactions of the Chinese Society of Agricultural Engineering, 2021, 37(5): 191-197.

[11]Qian C, Liu H, Du T, et al. An improved U-Net network-based quantitative analysis of melon fruit phenotypic characteristics [J]. Journal of Food Measurement and Characterization, 2022, 16(5): 4198-4207.

[12]Ronneberger O, Fischer P, Brox T. U-Net: Convolutional networks for biomedical image segmentation [C]. International Conference on Medical Image Computing and Computer-Assisted Intervention, Springer, Cham, 2015: 234-241.

[13]Long J, Shelhamer E, Darrell T. Fully convolutional networks for semantic segmentation [J]. Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2015: 3431-3440.

[14]Wang Q, Wu B, Zhu P, et al. ECA-Net: Efficient channel attention for deep convolutional neural networks [C]. Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, 2020: 11531-11539.

[15]Li R, Zheng S, Duan C, et al. Multistage attention ResU-Net for semantic segmentation of fine-resolution remote sensing images [J]. IEEE Geoscience and Remote Sensing Letters, 2022, 19: 1-5.

[16]Vaswani A, Shazeer N, Parmar N, et al. Attention is all you need [C]. Advances in Neural Information Processing Systems, 2017, 30.

[17]Fu J, Liu J, Tian H, et al. Dual attention network for scene segmentation [C]. Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2019: 3146-3154.

[18]黃林林, 李世雄, 谭彧, 等. 基于改进卷积神经网络算法的路径导航研究[J]. 中国农机化学报, 2022, 43(4): 146-152,159.

Huang Linlin, Li Shixiong, Tan Yu, et al. Research on farmland route navigation based on an improved convolutional neural network algorithm [J]. Journal of Chinese Agricultural Mechanization, 2022, 43(4): 146-152, 159.

[19]王涛. 基于光谱技术的土壤理化信息检测方法研究[D]. 杭州: 浙江大学, 2020.Wang Tao. Study on soil physical and chemical information detection methods based on spectral technology [D]. Hangzhou: Zhejiang University, 2020.

[20]王翔宇, 李海生, 吕丽君, 等. 基于U-net和可见光谱图像的黄瓜褐斑病分割[J]. 光谱学与光谱分析, 2021, 41(5): 1499-1504.Wang Xiangyu, Li Haisheng, Lü Lijun, et al. Segmentation of cucumber target leaf spot based on U-Net and visible spectral images [J]. Spectroscopy and Spectral Analysis, 2021, 41(5): 1499-1504.

[21]Rakhlin A, Shamir O, Sridharan K. Making gradient descent optimal for strongly convex stochastic optimization [J].arXiv Preprint arXiv: 1109.5647, 2012.

基金项目:黑龙江省大学生创新创业训练计划项目(202010223007);黑龙江八一农垦大学校内培育课题(XZR2017—10)

第一作者:邱金凯,男,1998年生,河北沧州人,硕士研究生;研究方向为植物表型、计算机视觉和深度学习。E-mail: jinkai2020_2023@163.com

通讯作者:许秀英,女,1978年生,吉林永吉人,硕士,副教授;研究方向为农业机器人。E-mail: xxy_byau@163.com